Anthropic控告美國政府:AI安全紅線引發憲法之爭

AI公司Anthropic因拒絕軍事監控與自主武器用途,遭美國政府列為供應鏈風險,隨即提起訴訟。這場法律戰折射出AI治理的核心矛盾,對亞洲科技格局影響深遠。

一家AI公司對美國政府說「不」,然後被懲罰了。

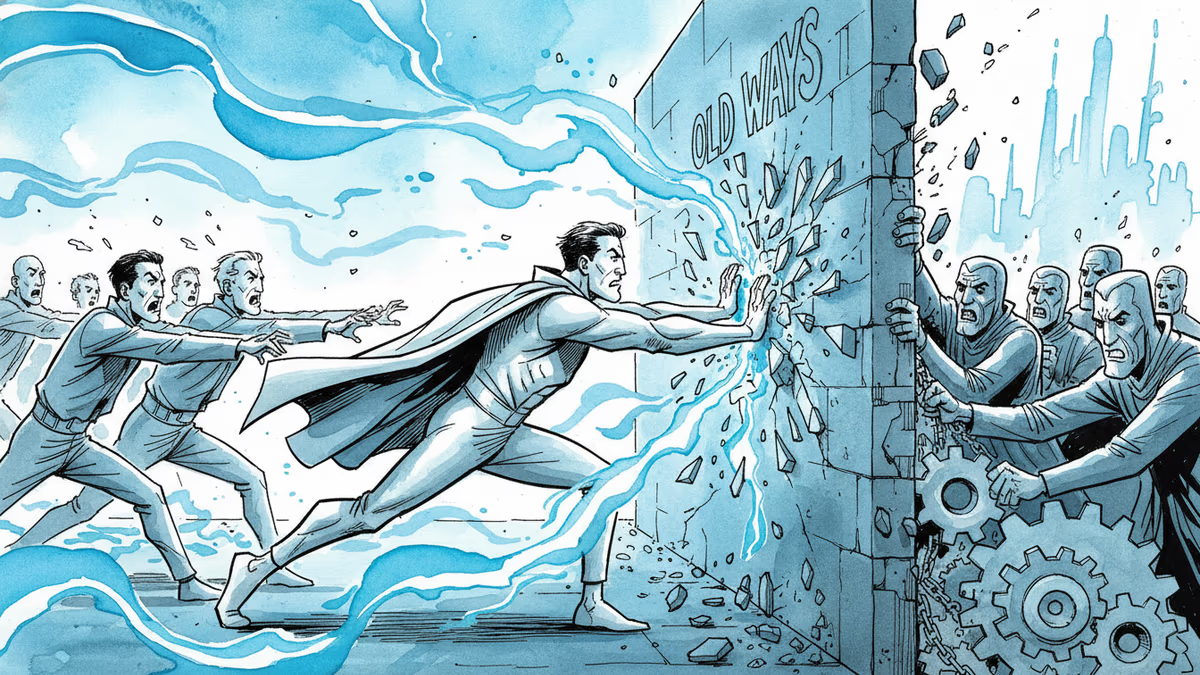

2026年3月,Anthropic在加州聯邦地方法院對美國政府提起訴訟。起因直接:這家以「負責任AI」為旗幟的公司,因為拒絕讓自家模型用於大規模國內監控和完全自主武器,被川普政府列為「供應鏈風險」。Anthropic的回應是走上法庭,指控政府違憲報復。

事件始末:一場持續數週的對峙

這場衝突並非突然爆發。過去數週,Anthropic與美國國防部之間的緊張關係持續升溫,核心爭議在於:Anthropic的AI技術,究竟可以被用來做什麼?

Anthropic劃出了明確的「紅線」——拒絕讓其AI模型Claude用於大規模監控本國公民,以及完全由AI自主決策的武器系統。這些限制,是該公司AI安全哲學的核心組成部分。

川普政府的回應是將其列為供應鏈風險,這個標籤在實際操作中意味著:在政府採購、軍事合約等領域,Anthropic將面臨系統性的排除或刁難。Anthropic在訴狀中寫道:「聯邦政府因為一家頂尖前沿AI開發商堅守其受憲法保護的立場——關於AI安全及自家模型的限制——而對其進行報復,違反了憲法。」

為何此刻格外重要

這不只是一場企業與政府的合約糾紛。它觸碰到一個更深層的問題:在AI技術快速軍事化的時代,誰有權決定AI的倫理邊界?

從時間節點來看,這場訴訟發生在全球AI軍備競賽白熱化的背景下。美國、中國、歐洲各國都在加速將AI整合進國防體系。在這個脈絡下,Anthropic的舉動——一家私人企業公開拒絕政府的軍事需求,並訴諸司法——是相當罕見的。

更值得關注的是:Anthropic並非反政府的邊緣公司。它是目前全球最重要的大型語言模型開發商之一,獲得了包括Google在內的大量投資。它的立場代表的,是主流AI產業中一部分人的真實想法。

華人世界的視角:這面鏡子照出了什麼

對於關注中美科技角力的讀者而言,這個事件提供了一個罕見的觀察角度。

長期以來,西方輿論批評中國AI企業缺乏對政府要求的抵抗能力,認為中國公司在國家安全需求面前幾乎沒有自主空間。而現在,美國最頂尖的AI公司之一,正在用法律手段抵抗本國政府的類似壓力——這種對比,值得細細品味。

這並不意味著兩種體制是等同的,但它確實說明:AI倫理與國家安全之間的張力,並非某一種政治體制的專屬難題。

對台灣、香港及東南亞的科技從業者而言,這場訴訟也有現實意義。許多企業同時使用美國和中國的AI工具,夾在兩套截然不同的監管邏輯之間。當美國AI企業開始以「倫理紅線」為由限制政府用途,這些工具的可用性和穩定性,可能比以往更難預測。

反方的聲音

政府的立場並非沒有道理。從國家安全的角度,要求本國最先進的AI技術為國防服務,是許多國家的慣常做法。批評者也指出,Anthropic的「紅線」在某種程度上是模糊的——「完全自主武器」的定義本身就存在爭議,而「大規模監控」的邊界也並不清晰。

此外,也有人質疑:一家私人公司是否有權單方面決定某些軍事技術不可使用?這種決策權,難道不應該由民主程序來決定?

這些問題沒有簡單的答案,但它們正是這場訴訟真正的核心所在。

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

美國數據分析巨頭Palantir的員工,因公司深度參與移民驅逐行動及疑似涉及伊朗學校空襲,開始在內部公開質疑公司的道德立場。這場企業內部的倫理風暴,對科技業意味著什麼?

川普在就職前發行個人迷因幣,家族據報獲利逾2.8億美元,但幣值已大幅崩跌。若民主黨秋季奪回國會,禁止總統家族從加密貨幣獲利的法案可能成真。政治與金融的邊界正在哪裡?

Anthropic專為企業安全設計的AI工具Mythos,在公開發布當日遭不明人士透過第三方廠商取得存取權限。這起事件揭示了AI供應鏈管理的根本性漏洞。

被美國國防部列為供應鏈風險的Anthropic,卻與白宮高層展開對話。這場美國AI政策的內部分裂,對全球科技格局意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论