AI巨頭拒絕五角大廈:人工智慧的道德界線

Anthropic拒絕國防部無限制AI存取要求,堅持不參與大規模監控與自主殺戮武器,引發科技倫理與國安需求的激烈辯論

24小時。這是五角大廈給Anthropic的最後通牒期限。但這家AI公司選擇了拒絕。

昨天深夜,就在國防部長Pete Hegseth設定的期限前不到一天,Anthropic正式回絕了五角大廈對其AI系統「無限制存取」的要求。這場公開對峙的核心爭議:AI公司是否應該為了國家安全,放棄自己設定的道德界線?

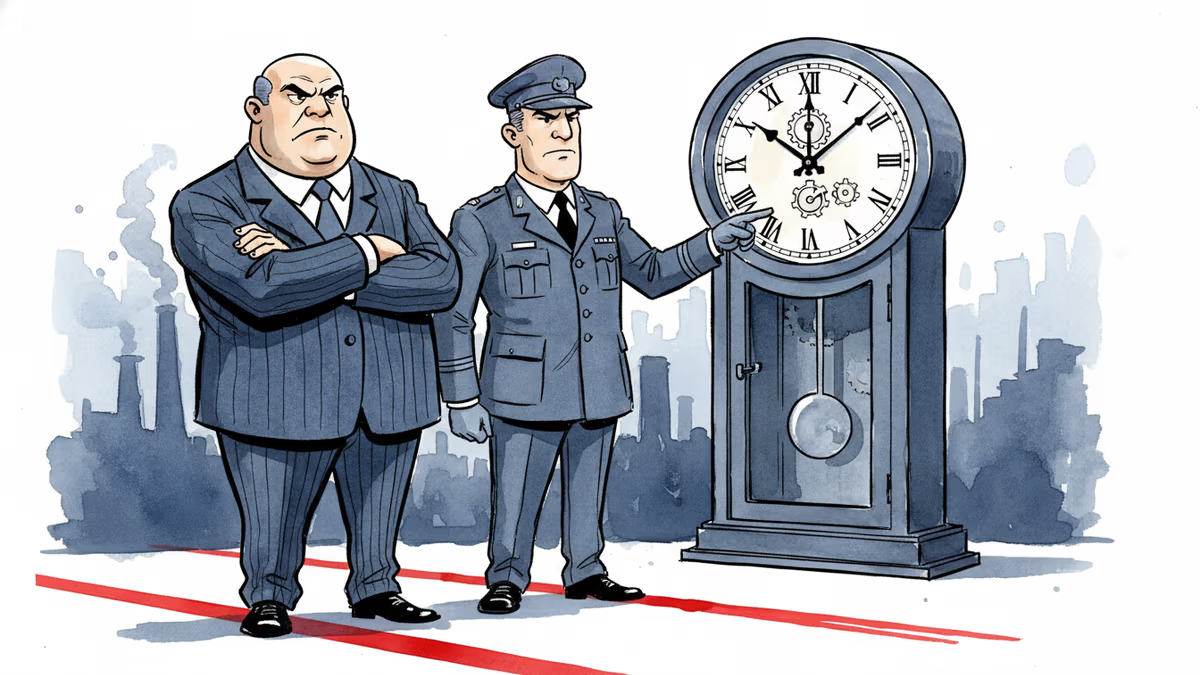

兩條不可跨越的紅線

Anthropic的立場很明確:有兩條紅線絕對不能跨越。第一,拒絕參與對美國公民的大規模監控。第二,拒絕開發完全自主的殺戮武器——那些可以在沒有人類監督下自行決定攻擊目標的系統。

這並非突如其來的對抗。Hegseth上任後,便開始重新審視所有AI實驗室與軍方的合作合約。他的邏輯很簡單:既然政府資助了這些技術的發展,就應該擁有完全的使用權限。但Anthropic認為,技術發展不能沒有倫理邊界。

相比之下,OpenAI的態度則顯得更加曖昧。雖然該公司尚未公開表態,但業界普遍認為OpenAI可能會選擇妥協,以維持與政府的合作關係。

國安與倫理的平衡點

這場對峙反映了一個更深層的問題:在國家安全需求與科技倫理之間,界線應該劃在哪裡?

支持五角大廈立場的人士認為,面對中國在AI軍事應用上的快速發展,美國不能因為道德顧慮而束縛自己的手腳。他們指出,Anthropic的「道德堅持」可能會讓美國在關鍵技術競爭中落後。

但批評者警告,一旦開了先例,允許軍方無限制使用AI技術,可能會導致監控國家的出現。史丹佛大學AI倫理研究中心的專家表示:「今天我們妥協的界線,明天就會成為新的起點。」

全球視角下的選擇

從華人世界的角度來看,這場爭議具有特殊意義。中國大陸在AI軍事應用上相對較少公開討論倫理限制,更多強調技術實力與國家安全。相對地,台灣與香港的科技界則更關注如何在技術發展與民主價值之間找到平衡。

歐盟已經通過了《AI法案》,明確禁止某些AI應用,包括社會信用評分系統和情感識別技術。這為其他地區提供了參考框架,但也引發了關於創新與管制平衡的討論。

對東南亞華人科技社群而言,這場爭議提醒我們:技術不是中性的,每一個選擇都會影響社會的未來走向。

未來的十字路口

Anthropic的拒絕可能會產生連鎖反應。如果其他AI公司跟進,五角大廈可能會考慮更強硬的措施,包括限制政府資金流向這些公司,或是尋求其他合作夥伴。

但也有可能,這次對抗會促成一個更平衡的解決方案:在滿足國家安全需求的同時,保留必要的倫理界線。關鍵在於,雙方是否願意坐下來,重新定義「合作」的含義。

相关文章

YouTube推出AI自訂動態消息功能,用戶輸入文字描述即可生成個人化影片清單。這項改變對內容創作者、廣告主與亞洲市場意味著什麼?

Meta宣布在全球推出Instagram、Facebook、WhatsApp付費訂閱方案,並測試Meta AI訂閱服務。這對亞洲用戶、華人社群與數位廣告產業意味著什麼?

SpaceX要求美軍為每架自爆無人機支付25,000美元的Starshield衛星連線費,較原本的5,000美元暴漲五倍。五角大廈最終妥協。當民間企業掌控軍事通訊基礎設施,國家安全的籌碼在誰手中?

教宗良十四世最新通諭《人類的壯麗》疑似部分由AI撰寫,AI檢測工具顯示第一章62%為AI生成。這不只是宗教問題,更是所有「權威文件」共同面對的挑戰。

观点

分享你对这篇文章的看法

登录加入讨论