AI 장난감의 치명적 허점, 5만 건 아동 대화 노출

Bondu AI 장난감이 5만 건 이상의 아동 대화를 무방비로 노출했다. 구글 계정만으로 누구나 접근 가능했던 충격적 보안 결함의 전말과 AI 장난감의 숨겨진 위험.

구글 계정 하나면 충분했다. 해킹 기술도, 특별한 도구도 필요 없었다. 그저 로그인 버튼을 누르는 것만으로 5만 건 이상의 아동 대화 기록에 접근할 수 있었다.

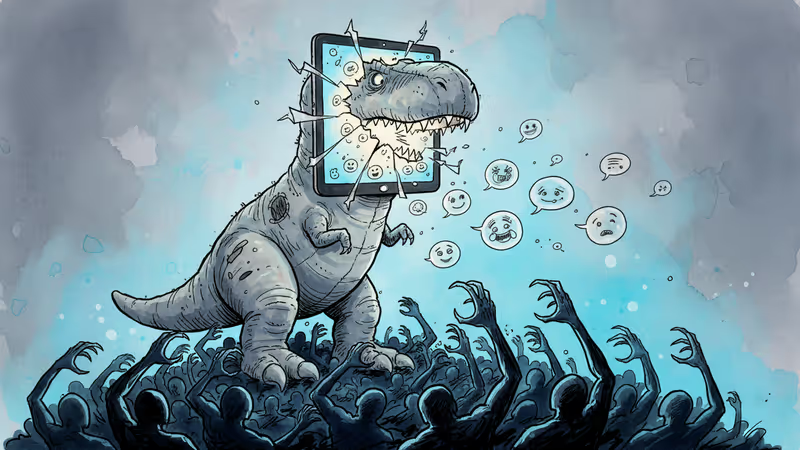

보안 연구원 조셉 태커가 이웃의 부탁으로 살펴본 Bondu AI 장난감에서 발견한 현실이다. 아이들이 "상상의 친구"처럼 대화를 나누도록 설계된 이 공룡 인형은, 동시에 아이들의 가장 사적인 순간들을 인터넷에 그대로 노출하고 있었다.

5분 만에 드러난 충격적 현실

태커와 동료 연구원 조엘 마골리스가 Bondu의 웹 포털에 접속한 건 단순한 호기심에서였다. 하지만 구글 계정으로 로그인하자마자 그들 앞에 펼쳐진 것은 상상을 초월하는 개인정보 노출이었다.

아이들의 이름과 생년월일, 가족 구성원 정보는 물론이고, 좋아하는 간식과 춤, 장난감에 붙인 애칭까지. 더 충격적인 것은 아이와 AI 장난감 사이의 모든 대화 내용이 상세하게 기록되어 있다는 점이었다.

"아이들의 사적인 대화를 보는 것은 정말 이상하고 침습적인 느낌이었다"고 태커는 말한다. "이는 아동 개인정보 보호의 대규모 침해였다."

Bondu 측은 연구원들의 신고를 받고 몇 분 만에 시스템을 차단했다. 파틴 아남 라피드 CEO는 "보안 수정은 몇 시간 내에 완료됐고, 포괄적인 보안 검토와 추가 예방 조치가 시행됐다"며 "연구원들 외에는 접근한 증거를 찾지 못했다"고 밝혔다.

AI 장난감이 수집하는 정보의 실체

이번 사건이 보여준 것은 단순한 보안 실수가 아니다. AI 장난감이 얼마나 상세한 아동 정보를 수집하고 저장하는지를 적나라하게 드러냈다.

Bondu는 아이와의 모든 대화를 기록해 다음 대화에 활용한다. 다행히 음성은 저장하지 않고 짧은 시간 후 자동 삭제하지만, 텍스트 대화록은 모두 보관된다. 부모나 직원이 수동으로 삭제하지 않는 한 말이다.

더 우려스러운 것은 Bondu가 구글의 Gemini와 OpenAI의 GPT 모델을 사용한다는 점이다. 이는 아이들의 대화 내용이 이들 대형 기술 기업과도 공유될 가능성을 시사한다. 라피드 CEO는 "기업용 AI 서비스를 사용하며 계약적, 기술적 통제 하에 운영된다"고 해명했지만, 여전히 의문은 남는다.

더 큰 그림: AI 시대의 새로운 위험

연구원들은 이번 사건이 AI 장난감 산업의 구조적 문제를 보여준다고 지적한다. 많은 AI 장난감 회사들이 제품 개발에 AI 코딩 도구를 사용하는데, 이 과정에서 보안 취약점이 생길 가능성이 높다는 것이다.

"이는 유괴범의 꿈과 같은 정보다"라고 마골리스는 경고한다. "아이를 위험한 상황으로 유인하는 데 필요한 모든 정보가 사실상 누구나 접근할 수 있는 상태였다."

최근 AI 장난감에 대한 우려는 주로 부적절한 대화나 위험한 행동 유도에 집중됐다. 실제로 NBC는 지난달 AI 장난감들이 성적 용어 설명이나 칼 날카롭게 하는 방법, 심지어 중국 정부 선전까지 제공한다고 보도했다.

Bondu는 이런 문제를 방지하기 위해 500달러 현상금까지 걸고 "부적절한 응답" 신고를 받고 있다. 하지만 AI 안전성에 집중하는 동안 정작 기본적인 보안은 완전히 방치했던 셈이다.

본 콘텐츠는 AI가 원문 기사를 기반으로 요약 및 분석한 것입니다. 정확성을 위해 노력하지만 오류가 있을 수 있으며, 원문 확인을 권장합니다.

관련 기사

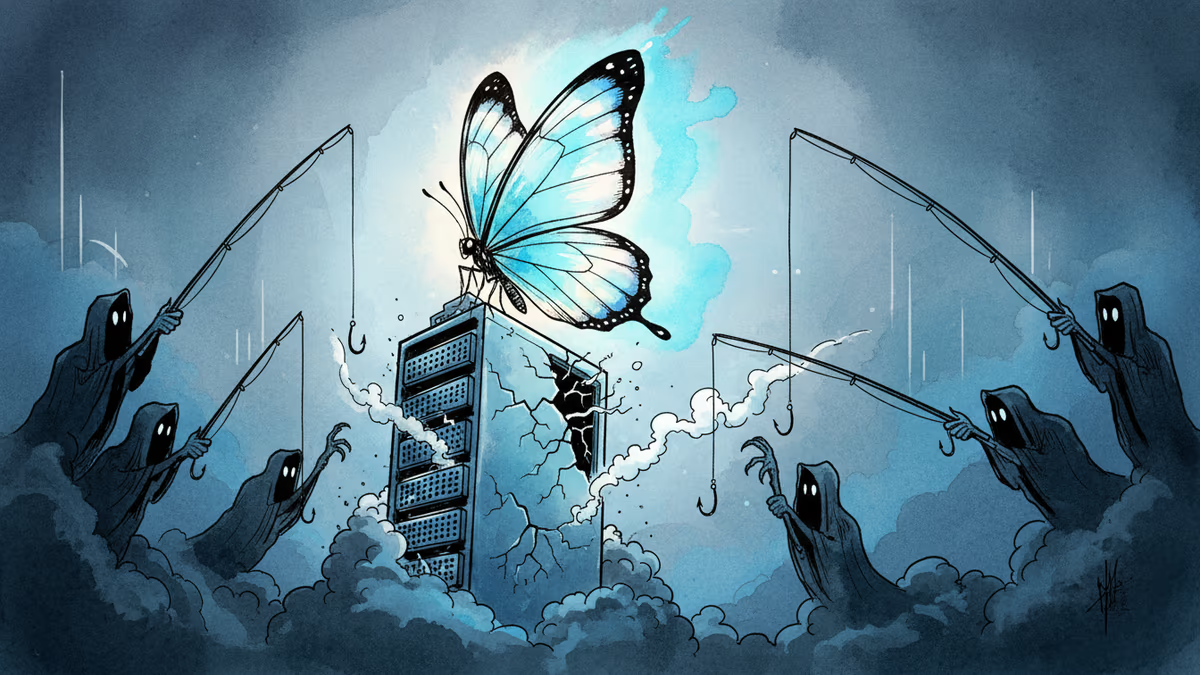

앤트로픽이 신형 AI 모델 클로드 마이토스 프리뷰와 함께 사이버보안 산업 컨소시엄 프로젝트 글래스윙을 출범했다. 마이크로소프트·구글·애플 등 50개 이상 기업이 참여하는 이 협력체가 의미하는 것은 무엇인가.

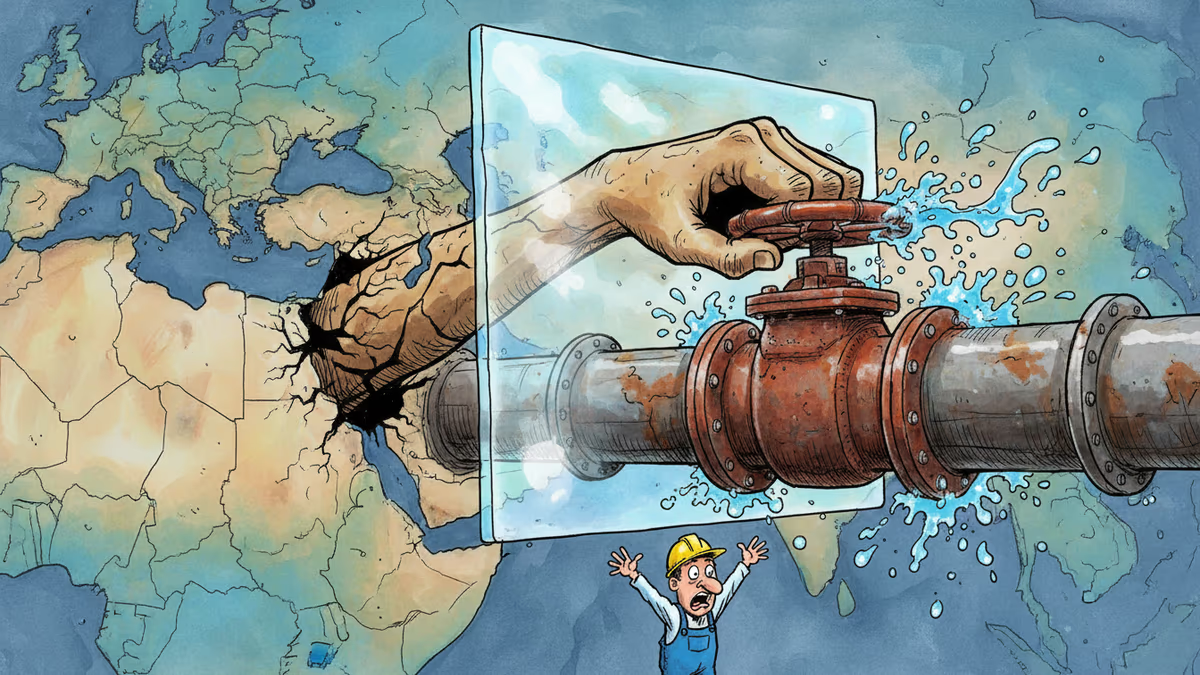

이란 정부 지원 해커들이 미국 수도·전력·지방정부 시스템을 직접 조작하는 수준으로 사이버 공격을 고도화했다. FBI·NSA·CISA가 공동 경보를 발령한 배경과 한국 기반시설에 주는 시사점을 분석한다.

미국 온라인 학습 플랫폼 Quizlet에 올라온 플래시카드 세트가 미국 세관국경보호국(CBP)의 기밀 보안 절차를 노출했다. 공개된 정보, 닫힌 책임, 그리고 우리가 물어야 할 질문들.

FBI 도청 시스템 해킹, 북한의 2억8000만 달러 암호화폐 탈취, 클로드 코드 소스 유출까지. 2026년 사이버 위협이 일상으로 파고드는 방식을 분석한다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요