수백 번 인용된 논문이 틀렸다

ChatGPT가 학습 효과를 높인다고 주장한 메타분석 논문이 출판 1년 만에 철회됐다. 수백 건의 인용과 소셜미디어 확산 이후의 일이다. 이 사건이 AI 교육 연구 전반에 던지는 질문을 짚는다.

수백 편의 논문이 이 연구를 인용했다. 교사들이 공유했고, 정책 논의에 등장했으며, "AI가 학습을 돕는다는 첫 번째 증거"로 소셜미디어에서 회자됐다. 그런데 그 논문이 틀렸다.

Springer Nature는 최근 ChatGPT가 학생 학습 성과에 미치는 영향을 분석한 메타분석 논문을 공식 철회했다. 출판된 지 약 1년 만이다. 철회 이유는 "분석의 불일치"와 "결론에 대한 신뢰 부족". 데이터 조작이나 표절이 아니라, 분석 방법 자체에 문제가 있었다는 뜻이다.

이 논문은 무엇을 주장했나

해당 논문은 ChatGPT를 교육에 활용한 51개 선행 연구를 종합해 학습 성과, 학습 인식, 고차원적 사고력에 미치는 효과를 수치화했다. 메타분석은 개별 연구보다 신뢰도가 높다고 여겨지는 방법론이다. 여러 연구를 통합해 더 강력한 통계적 결론을 도출하기 때문이다. 바로 그 "신뢰도"가 이 논문의 무기였다.

에든버러대학교 디지털교육연구센터의 벤 윌리엄슨 선임 강사는 이렇게 설명했다. "이 논문의 저자들은 ChatGPT가 학습 성과에 미치는 이점에 대해 매우 주목을 끄는 주장을 했다. 소셜미디어에서 많은 이들이 이것을 ChatGPT, 나아가 생성형 AI 전반이 학습자에게 도움이 된다는 첫 번째 확실한 증거로 받아들였다."

문제는 그 확실성이 근거 없는 것으로 드러났다는 점이다.

논문 한 편의 파급력

철회 결정이 내려지기까지 이 논문은 이미 수백 건의 인용을 쌓았다. 학술 세계에서 인용 수는 영향력의 척도다. 한 논문이 다른 논문의 토대가 되고, 그 논문이 또 다른 연구의 근거가 된다. 잘못된 연구 하나가 학문적 연쇄 반응을 일으킬 수 있다는 의미다.

더 넓게 보면, 이 사건은 AI 교육 연구가 처한 구조적 압박을 보여준다. ChatGPT가 등장한 2022년 말 이후 교육계에서는 "AI를 어떻게 써야 하는가"를 둘러싼 논쟁이 폭발적으로 늘었다. 교사는 금지해야 하는가, 허용해야 하는가. 학생은 어떻게 활용해야 하는가. 이 논쟁에 "데이터"가 필요했고, 연구자들은 빠르게 답을 내놓으려 했다.

속도와 엄밀함은 종종 충돌한다.

누가, 어떻게 영향을 받는가

교사와 교육 행정가 입장에서 이번 철회는 불편한 진실이다. 많은 학교가 AI 도구 도입 여부를 결정할 때 이 같은 연구를 참고한다. "효과가 있다는 연구가 있다"는 말 한마디가 정책을 바꾸기도 한다. 이제 그 근거 중 하나가 사라졌다.

AI 기업 입장에서는 다소 복잡하다. OpenAI를 비롯한 AI 기업들은 자사 도구의 교육적 효과를 강조해왔다. 이번 철회가 직접적으로 그들의 주장을 반박하는 것은 아니지만, "AI가 학습에 좋다"는 서사에 균열을 낸다.

연구자와 저널 입장에서는 동료 심사(peer review) 시스템의 한계가 다시 도마에 오른다. 메타분석 논문이 통과됐다가 1년 후에야 철회됐다는 사실은, 심사 과정이 빠르게 변화하는 AI 연구를 따라잡지 못하고 있음을 시사한다.

한국의 경우, 교육부와 각 시도교육청이 AI 디지털 교과서 도입을 추진 중이다. 2025년부터 일부 학교에 적용이 시작됐고, AI 활용 교육의 효과에 대한 국내 연구 수요도 높아지고 있다. 이번 사건은 "효과가 있다는 연구"를 어디까지 신뢰해야 하는지 묻는다.

본 콘텐츠는 AI가 원문 기사를 기반으로 요약 및 분석한 것입니다. 정확성을 위해 노력하지만 오류가 있을 수 있으며, 원문 확인을 권장합니다.

관련 기사

ChatGPT가 WIRED의 제품 추천을 묻는 질문에 존재하지 않는 제품을 추천하거나 오래된 정보를 최신인 것처럼 제시했다. AI 쇼핑 추천의 신뢰성 문제를 짚는다.

앤트로픽의 국방부 갈등과 슈퍼볼 광고가 클로드 유료 구독자를 폭발적으로 늘렸다. 올해 유료 구독이 2배 이상 증가한 배경과 한국 AI 시장에 주는 시사점을 분석한다.

OpenAI가 ChatGPT 성인 모드 출시를 무기한 보류했다. 단순한 제품 결정이 아니다. 직원 반발, 투자자 압박, 그리고 AI 윤리의 충돌이 만들어낸 결과다.

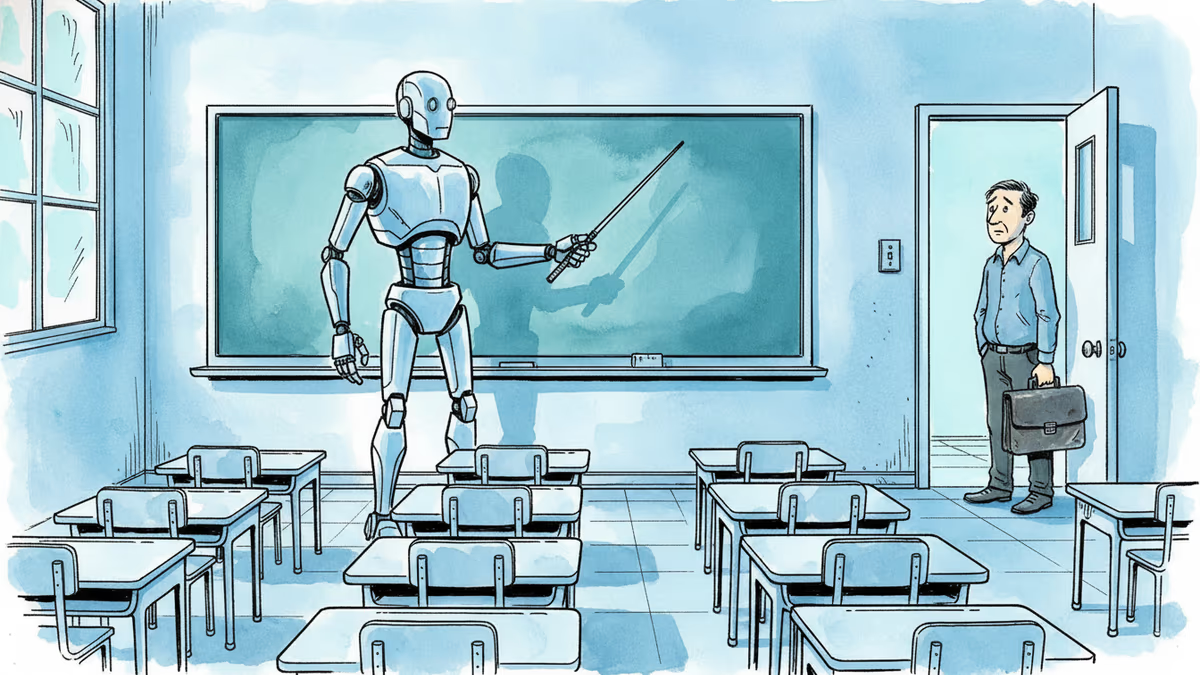

백악관에 등장한 휴머노이드 로봇과 멜라니아 트럼프의 AI 교육 비전. 교사를 대체하는 기술, 한국 교육에는 어떤 의미인가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요