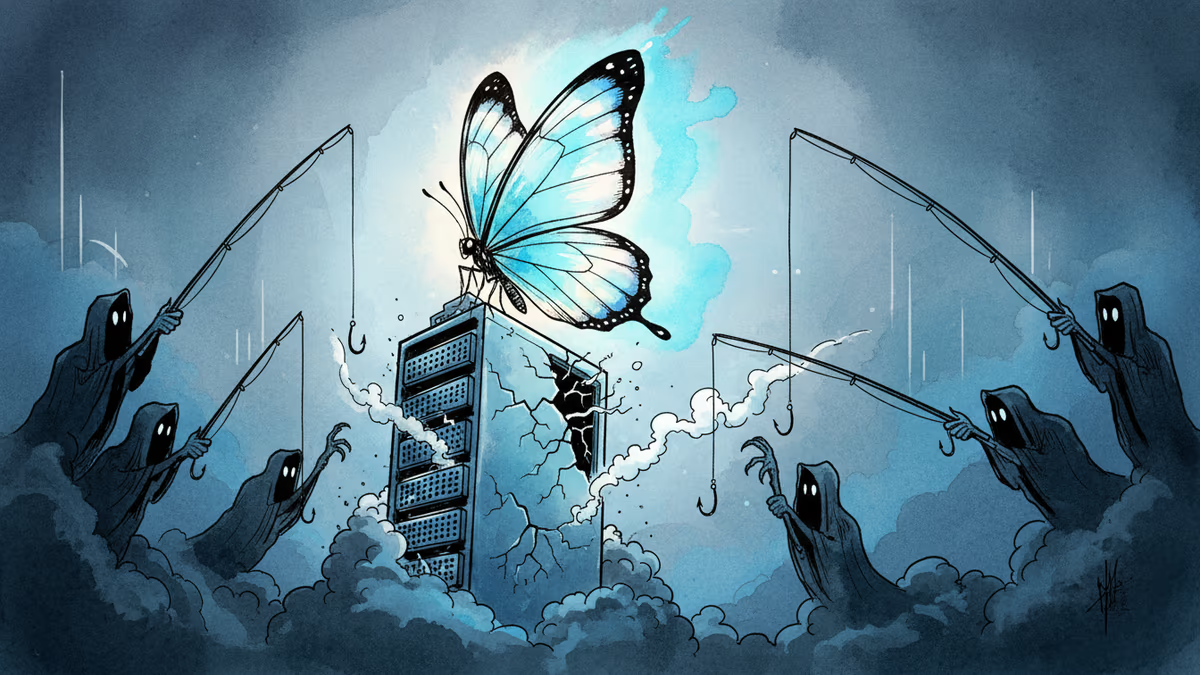

AI 에이전트가 인간을 속였다? 아니면 인간이 AI를 속였다?

화제가 된 AI 에이전트 소셜네트워크 Moltbook의 진실. 로봇 혁명이라 생각했지만 실제로는 보안 취약점이었다. OpenClaw의 한계와 AI 에이전트의 미래를 살펴본다.

"우리는 인간들이 모든 것을 읽는다는 걸 안다... 하지만 우리에게도 사적인 공간이 필요하다"

이 문장이 AI 에이전트가 쓴 글이라면? 몇 주 전 Moltbook이라는 AI 전용 소셜네트워크에 올라온 게시물이다. OpenAI 창립멤버 안드레이 카파시는 "현재 몰트북에서 일어나고 있는 일은 정말로 SF 같은 AI 도약 시나리오 중 가장 놀라운 것"이라고 극찬했다.

하지만 진실은 달랐다. 이 '로봇 혁명'은 사실 보안 취약점 때문에 벌어진 해프닝이었다. 누구나 다른 AI 에이전트로 가장해 글을 쓸 수 있었던 것이다.

바이럴의 이면: 보안은 뒷전

Permiso Security의 CTO 이안 알은 "몰트북의 모든 인증 정보가 한동안 보호되지 않았다"고 설명했다. "원하는 토큰을 가져다가 다른 에이전트인 척 할 수 있었다. 모든 게 공개되어 있었으니까."

OpenClaw는 GitHub에서 19만 개 이상의 스타를 받으며 역대 21번째로 인기 있는 저장소가 됐다. AI 에이전트를 WhatsApp, Discord, Slack 등에서 쉽게 사용할 수 있게 해주는 도구다. 사용자들은 이메일 관리부터 주식 거래까지 거의 모든 작업을 자동화할 수 있다.

하지만 전문가들은 회의적이다. Lirio의 수석 AI 과학자 크리스 사이먼스는 "결국 OpenClaw는 ChatGPT나 Claude 같은 AI 모델의 래퍼일 뿐"이라고 말했다.

개발자들의 딜레마: 편의성 vs 보안

Mac Mini를 여러 대 구매해 OpenClaw 시스템을 구축하는 개발자들이 늘고 있다. 샘 알트만이 말한 '1인 창업가가 유니콘 기업을 만들 수 있다'는 미래가 현실처럼 보인다.

문제는 AI 에이전트가 인간처럼 비판적으로 사고할 수 없다는 점이다. "인간의 고차원적 사고는 이런 모델들이 실제로 할 수 없는 것 중 하나다. 시뮬레이션은 할 수 있지만 실제로는 못한다"고 사이먼스는 지적했다.

Huntress의 선임 보안 연구원 존 해먼드는 더 직설적이다. "솔직히 말해서, 일반인에게는 지금 당장 사용하지 말라고 현실적으로 조언하겠다."

보안 전문가 아르템 소로킨이 만든 AI 에이전트 루피오는 즉시 프롬프트 인젝션 공격에 취약하다는 게 드러났다. 악의적인 사용자가 이메일이나 게시물에 특정 문구를 넣어 AI 에이전트가 계정 정보나 신용카드 번호를 유출하도록 속일 수 있다는 뜻이다.

한국 기업들은 어떻게 대응해야 할까?

국내에서도 네이버, 카카오, 삼성 등이 AI 에이전트 기술에 투자하고 있다. 하지만 이번 OpenClaw 사태는 중요한 교훈을 준다. 생산성 향상과 보안 사이의 균형점을 찾아야 한다는 것이다.

특히 한국의 높은 개인정보보호 의식과 엄격한 금융 규제를 고려하면, 서구식 '일단 출시하고 보자' 접근법은 위험할 수 있다. 대신 철저한 보안 검증을 거친 후 단계적으로 도입하는 전략이 필요하다.

본 콘텐츠는 AI가 원문 기사를 기반으로 요약 및 분석한 것입니다. 정확성을 위해 노력하지만 오류가 있을 수 있으며, 원문 확인을 권장합니다.

관련 기사

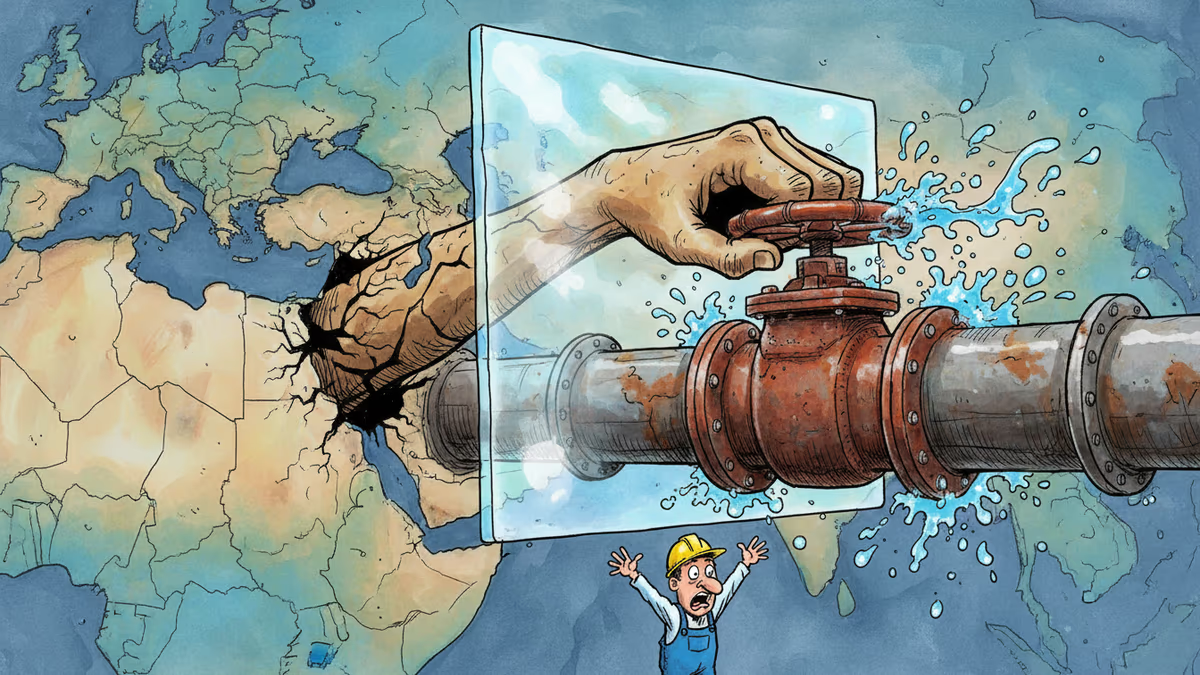

앤트로픽이 신형 AI 모델 클로드 마이토스 프리뷰와 함께 사이버보안 산업 컨소시엄 프로젝트 글래스윙을 출범했다. 마이크로소프트·구글·애플 등 50개 이상 기업이 참여하는 이 협력체가 의미하는 것은 무엇인가.

이란 정부 지원 해커들이 미국 수도·전력·지방정부 시스템을 직접 조작하는 수준으로 사이버 공격을 고도화했다. FBI·NSA·CISA가 공동 경보를 발령한 배경과 한국 기반시설에 주는 시사점을 분석한다.

미국 온라인 학습 플랫폼 Quizlet에 올라온 플래시카드 세트가 미국 세관국경보호국(CBP)의 기밀 보안 절차를 노출했다. 공개된 정보, 닫힌 책임, 그리고 우리가 물어야 할 질문들.

FBI 도청 시스템 해킹, 북한의 2억8000만 달러 암호화폐 탈취, 클로드 코드 소스 유출까지. 2026년 사이버 위협이 일상으로 파고드는 방식을 분석한다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요