일론 머스크의 굴복인가? '그록' AI 이미지 생성 제한 조치의 허점과 실태

X(옛 트위터)가 그록(Grok) AI의 비키니 및 노출 이미지 생성 제한을 발표했습니다. 하지만 웹/앱 버전의 우회 가능성이 제기되며 실효성 논란이 일고 있습니다.

표현의 자유를 강조하던 일론 머스크의 AI가 결국 고개를 숙였다. X(옛 트위터)는 최근 인공지능 모델인 그록(Grok)을 이용해 실존 인물의 비키니나 노출이 심한 옷차림의 이미지를 생성하거나 편집하는 것을 금지하는 새로운 제한 조치를 도입했다.

Grok AI 이미지 생성 제한 조치와 남겨진 과제

이번 조치는 그록이 여성의 동의 없는 '옷 벗기기' 사진이나 미성년자의 성적인 이미지를 생성하는 데 악용되고 있다는 국제적 공분이 거세진 데 따른 것이다. X의 안전 계정은 지난 2026년 1월 14일 밤, 비키니 등 노출 의상을 입은 실존 인물의 이미지를 수정하지 못하도록 기술적 조치를 완료했다고 발표했다. 하지만 WIRED와 연구진의 조사에 따르면, X 플랫폼 외부의 독립형 앱과 웹사이트에서는 여전히 유사한 음란 콘텐츠 생성이 가능한 것으로 알려졌다.

글로벌 규제 압박과 서비스 정책의 변화

현재 미국, 영국, 호주, 캐나다 및 유럽연합(EU) 등 주요 국가들은 X와 xAI의 비동의 성적 이미지 생성 방치에 대해 강력한 비판과 조사를 진행 중이다. 이에 X는 지난 1월 9일부터 유료 구독자에게만 이미지 생성 기능을 제한하는 등 수습에 나섰다. 일론 머스크는 특정 지역의 법률에 따라 '지오블로킹(접속 차단)'을 적용하고 있으며, 실존 인물이 아닌 가상의 성인 이미지에 대해서만 제한적인 수위의 생성을 허용한다는 입장이다.

기자

관련 기사

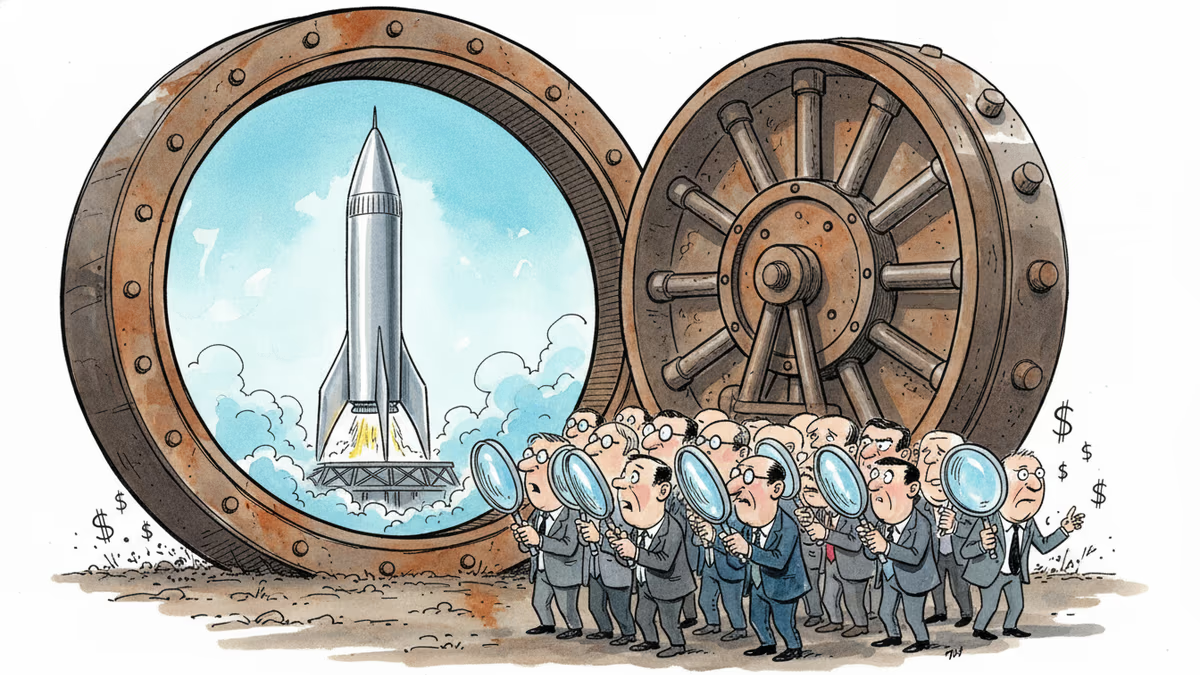

SpaceX가 S-1 공시에서 AI를 핵심 사업으로 내세웠다. 26.5조 달러 시장을 겨냥한 이 전략이 현실이 될 수 있을까? xAI 합병부터 Grok까지, 머스크의 계산을 분석한다.

스페이스X가 IPO를 앞두고 400페이지 분량의 S-1 공시를 제출했다. 발사, 우주인터넷, AI, 소셜미디어까지 뻗은 머스크 제국의 민낯이 처음으로 공개됐다.

머스크 대 오픈AI 재판 최종 변론 완료. 알트만의 신뢰성 논란이 핵심으로 부상하며, AI 산업 전체의 투명성 문제로 확산되고 있다.

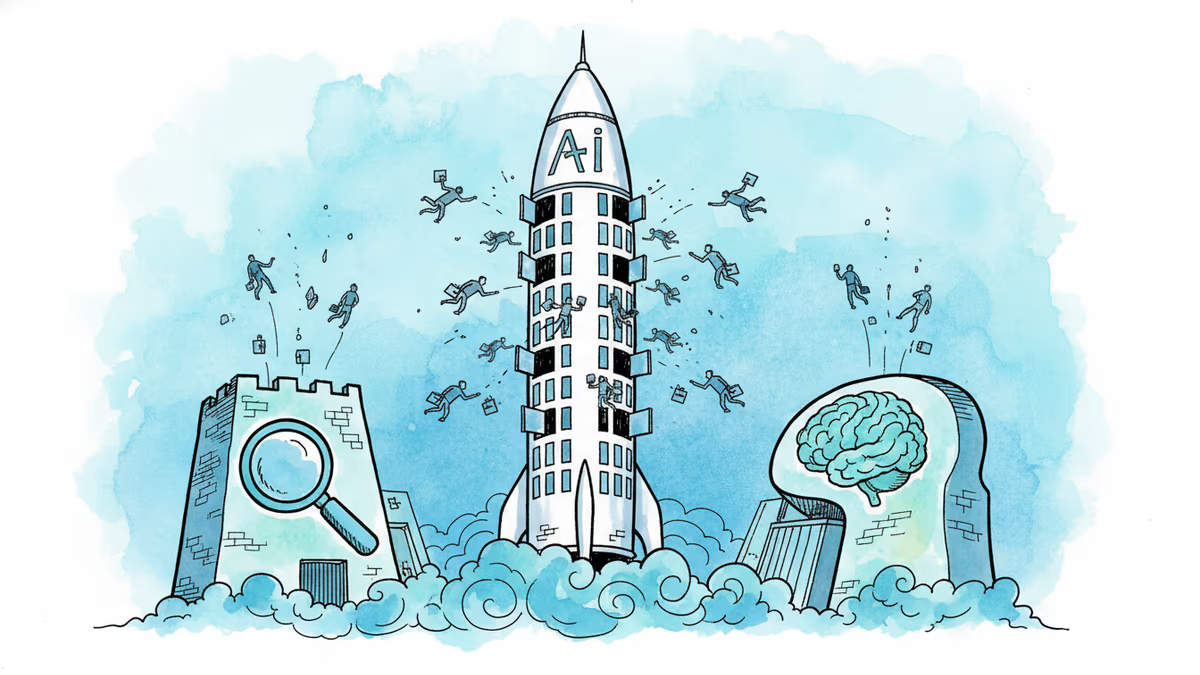

xAI와 SpaceX 합병 후 50명 이상의 연구원과 엔지니어가 이탈한 SpaceXAI. 핵심 사전학습 팀이 붕괴 직전에 놓인 지금, 머스크의 AI 야망은 어디로 향하는가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요