AI 기업 vs 국방부, 누가 옳은가?

앤트로픽이 팰란티어와의 AI 협력 중단을 요구하며 미국 국가안보 논쟁이 격화되고 있다. 기술 윤리와 국방 필요 사이의 딜레마를 살펴본다.

1월 3일, 미군 특수부대가 베네수엘라 카라카스에서 니콜라스 마두로를 체포했다는 가상의 시나리오가 AI 업계에 실제 논쟁을 불러일으켰다. 이 작전에서 팰란티어의 메이븐 스마트 시스템이 사용됐고, 여기에는 앤트로픽의 클로드 AI 모델이 탑재되어 데이터 분석과 타겟팅을 담당했다는 설정이었다.

문제는 한 달 후 벌어졌다. 앤트로픽이 팰란티어에게 자사 AI 모델 사용 중단을 요구하고 나선 것이다.

앤트로픽의 입장: "우리 AI는 무기가 아니다"

앤트로픽은 명확한 선을 그었다. 자사의 클로드 AI가 군사 작전에 사용되는 것을 원치 않는다는 것이다. 회사 측은 "AI 안전성과 윤리적 사용"을 핵심 가치로 내세우며, 특히 생명을 위협할 수 있는 군사적 용도에 대해서는 단호한 반대 입장을 표명했다.

이는 단순한 기업 정책이 아니다. 앤트로픽은 설립 초기부터 "AI 정렬(AI Alignment)" 연구에 집중해왔고, 인공지능이 인간의 가치와 일치하는 방향으로 발전해야 한다고 주장해왔다. 군사적 활용은 이러한 철학과 정면으로 충돌한다.

특히 앤트로픽은 자사 AI가 "헌법적 AI(Constitutional AI)" 원칙에 따라 개발됐다고 강조한다. 이는 AI가 인간의 기본적 권리와 가치를 존중하도록 설계된다는 의미로, 군사 작전에서의 활용은 이 원칙에 어긋난다는 논리다.

팰란티어의 반박: "국가 안보는 선택이 아니다"

반면 팰란티어는 정반대의 논리를 펼친다. 국가 안보는 협상 대상이 아니며, 최첨단 AI 기술을 활용해 미군의 작전 능력을 향상시키는 것은 당연한 의무라는 입장이다.

팰란티어의 알렉스 카프 CEO는 과거에도 "실리콘밸리의 평화주의적 환상"을 비판해왔다. 그는 기술 기업들이 현실을 외면한 채 이상주의에 빠져있다고 주장하며, 미국의 적대국들은 이미 AI를 군사적으로 활용하고 있는데 미국만 뒤처질 수 없다고 강조한다.

메이븐 스마트 시스템은 실제로 미군의 핵심 전력 증강 프로그램이다. 이 시스템은 드론 영상 분석, 적군 식별, 표적 추적 등에 AI를 활용해 군인들의 안전을 높이고 작전 효율성을 극대화한다. 팰란티어 측에서 보면, 앤트로픽의 요구는 미군의 생명을 위험에 빠뜨리는 무책임한 행동인 셈이다.

양측의 핵심 차이점

| 구분 | 앤트로픽 | 팰란티어 |

|---|---|---|

| AI 철학 | AI 안전성과 윤리 우선 | 국가 이익과 실용성 우선 |

| 군사 활용 | 원칙적 반대 | 적극적 지지 |

| 위험 인식 | AI 오남용의 위험성 | 기술 격차로 인한 안보 위험 |

| 책임 범위 | 글로벌 AI 윤리 | 미국 국가 안보 |

| 미래 비전 | 인간 중심 AI 생태계 | 기술 우위 기반 안보 체계 |

더 큰 그림: 기술과 권력의 딜레마

이 논쟁은 단순한 기업 간 갈등을 넘어선다. 미국 내에서 기술 기업들의 사회적 책임과 국가 안보 사이의 균형점을 어디에 둘 것인가 하는 근본적 질문을 제기한다.

구글이 2018년 국방부의 프로젝트 메이븐에서 철수한 사례처럼, 실리콘밸리의 많은 기업들이 군사적 활용에 거부감을 드러내고 있다. 반면 마이크로소프트나 아마존처럼 국방부와 적극적으로 협력하는 기업들도 있다.

문제는 중국과 러시아 같은 경쟁국들이 이런 윤리적 고민 없이 AI를 군사적으로 활용하고 있다는 점이다. 미국이 도덕적 우위를 유지하려다가 기술적 열세에 빠질 위험이 있다는 우려가 제기되는 이유다.

국내에서도 비슷한 논쟁이 예상된다. 네이버나 카카오 같은 플랫폼 기업들이 AI 기술을 발전시키면서, 이를 국방 분야에 어떻게 활용할지에 대한 사회적 합의가 필요할 것으로 보인다.

기자

관련 기사

경기 가평의 이앤이 컨트리클럽에서 회원 10만 명의 개인정보가 유출됐다. 경찰은 북한 해킹 조직의 소행으로 보고 수사 중이다. 왜 골프장인가?

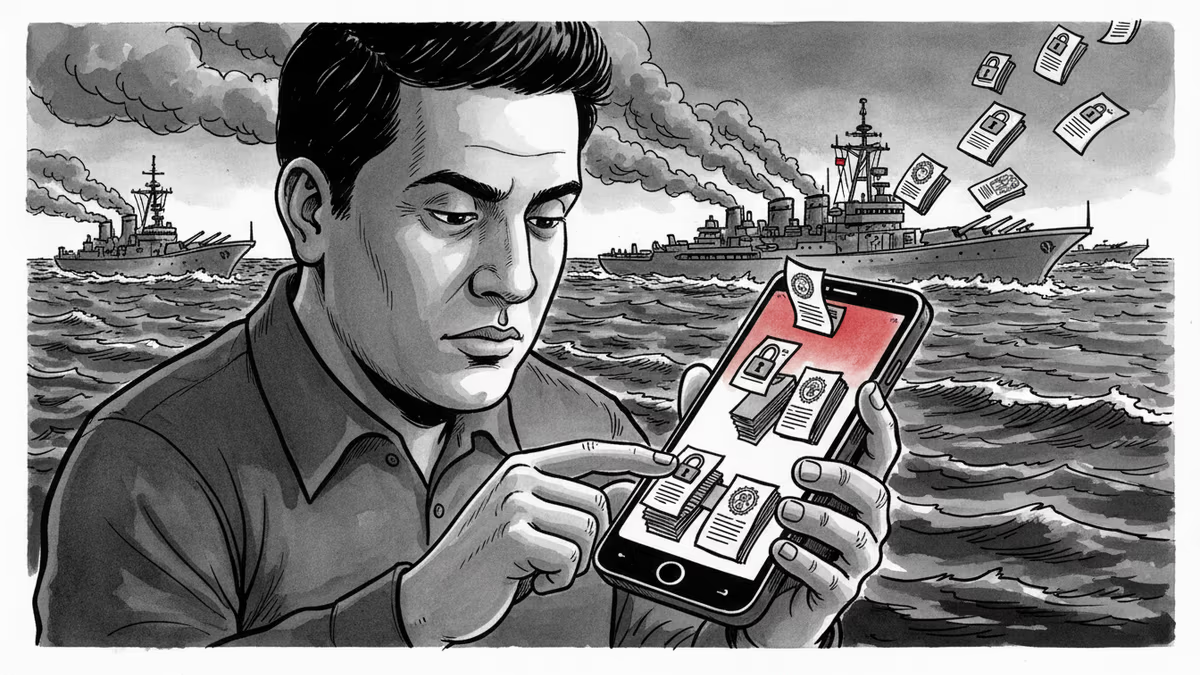

필리핀 국가안전보장회의가 중국 스파이 혐의로 자국민 3명을 체포했다고 발표. 남중국해 보급 작전 정보가 테트리스 게임을 통해 유출됐다는 충격적 사실이 드러났다.

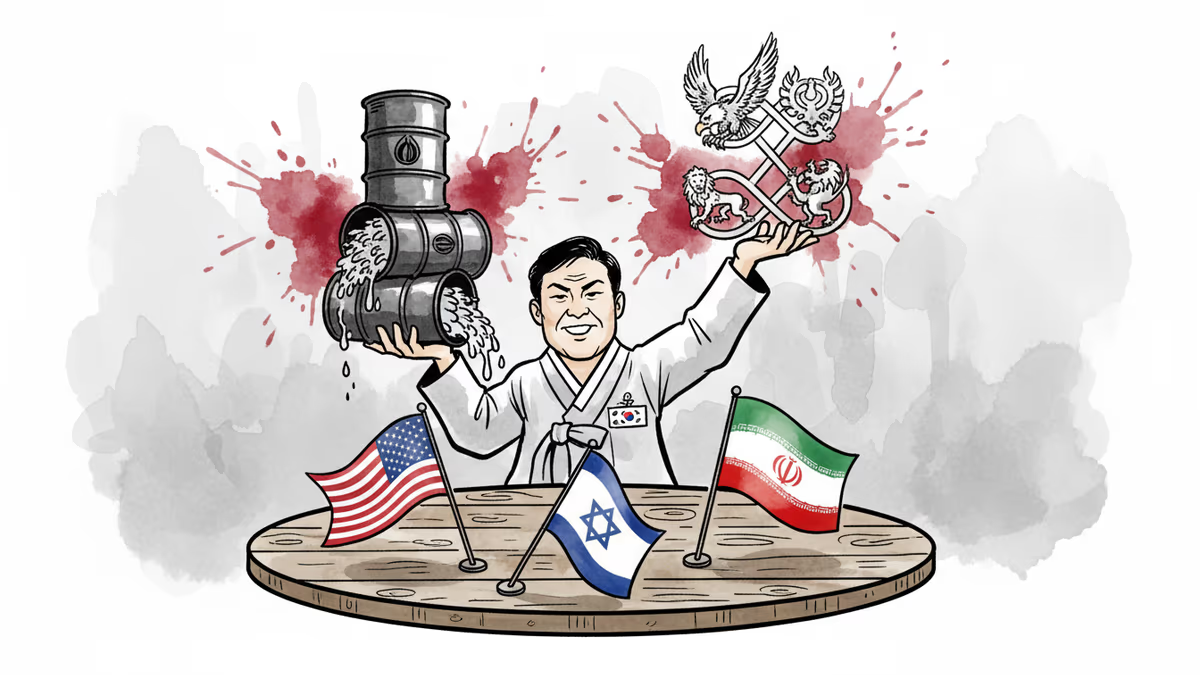

한국 국가안보실이 미국과 이스라엘의 이란 공습에 대응해 실무위원회 회의를 소집했습니다. 중동 정세 악화가 한국에 미치는 영향과 대응 방안을 분석합니다.

미중 AI 경쟁을 승부의 관점에서만 바라보면 놓치는 것이 있다. 중국이 구축하는 AI 생태계는 서구와 근본적으로 다른 철학과 목표를 가지고 있다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요