AIエージェントが画面を「見る」時代、プライバシーは誰が守るのか

OpenClawなどAIエージェントが画面操作を自動化する中、個人情報保護の新たな課題が浮上。企業と個人の責任分界点を探る。

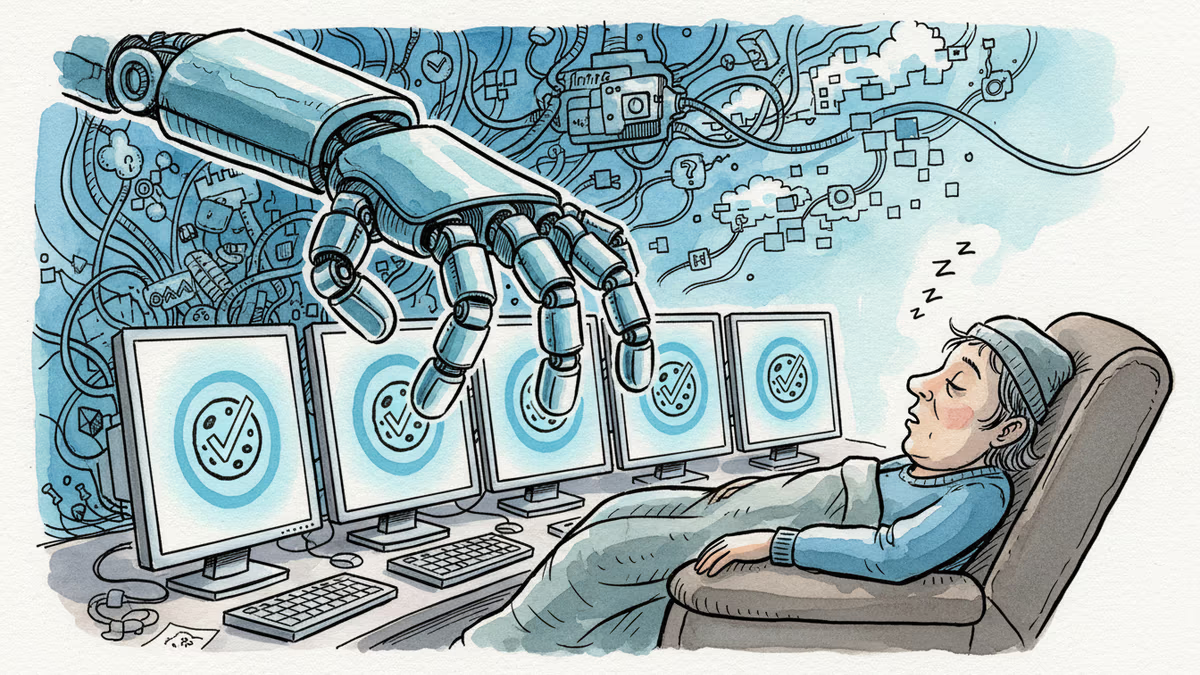

あなたのパソコン画面を24時間監視し、代わりに作業をしてくれるAIアシスタント。便利そうに聞こえるが、そのAIが見ているものすべてが企業のサーバーに送信されているとしたら?

OpenClawをはじめとする「エージェント型AI」が急速に普及している。これらのAIは従来の対話型AIと異なり、ユーザーの画面を直接「見て」、マウスクリックやキーボード入力を代行する。メール返信、資料作成、オンライン購入まで、人間の代わりに複雑な作業を実行できる画期的な技術だ。

見えない情報流出のリスク

問題は、これらのAIが「見る」情報の範囲が想像以上に広いことだ。画面上に表示される銀行残高、医療記録、社内機密資料、個人的なメッセージ——AIにとってはすべて「作業に必要な情報」として処理される。

現在の多くのエージェント型AIは、クラウドベースで動作している。つまり、ユーザーの画面情報が外部サーバーに送信され、そこでAIが判断を下している。GoogleやMicrosoftといった大手企業でさえ、この情報がどのように保存・活用されるかについて明確なガイドラインを示していない。

日本企業の導入事例を見ると、68%の企業が「セキュリティ対策が不十分」と回答している。特に金融業界では、顧客情報保護の観点から導入に慎重な姿勢を見せている。

規制の空白地帯

従来のプライバシー保護法は、主に「データの収集・保存」を対象としていた。しかし、エージェント型AIは「リアルタイムでの画面監視」という新しい形態の情報アクセスを行う。この領域は現行法の想定外で、規制の空白地帯となっている。

欧州連合(EU)では2024年からAI規制法の施行が始まったが、エージェント型AIの画面アクセスについては具体的な規定がない。日本の個人情報保護委員会も「検討中」の段階で、企業は自主的な判断に委ねられているのが現状だ。

一方で、Appleは2025年から自社のエージェント型AI「Apple Intelligence」において、すべての画面解析をデバイス内で完結させる「オンデバイス処理」を採用すると発表。プライバシー重視の姿勢を鮮明にしている。

日本企業の対応分岐点

日本の製造業大手では、対応が二極化している。トヨタ自動車は社内システムでのエージェント型AI導入を一時停止し、独自のセキュリティ基準策定を進めている。一方、ソフトバンクは積極的な導入方針を示しつつ、データの国内保管を条件とした契約を結んでいる。

興味深いのは、日本の消費者の反応だ。2026年1月の調査では、43%が「便利さよりもプライバシーを重視する」と回答。これは米国の28%と比較して高い数値で、日本人の慎重な姿勢が表れている。

関連記事

中国の人型ロボット訓練センターでは、元美術教師が工場作業をロボットに教えている。北京が国家戦略として推進するヒューマノイドロボット産業の実態と、日本社会への示唆を読み解く。

エヌビディアCEOジェンスン・ファンが中国AIチップ市場を「事実上ファーウェイに譲った」と発言。売上高85%増の好決算の裏で、中国市場の喪失が日本企業のAI調達戦略にも影を落とす。

AIラボが1兆ドル規模のIPOに向けてゴールドマン・サックスとモルガン・スタンレーを起用。この史上最大級の上場は投資家と日本企業に何をもたらすのか。

OpenAIが初の海外AIラボをシンガポールに開設、Googleも国家AIパートナーシップを締結。なぜ今、なぜシンガポールなのか。日本企業への示唆も含めて読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加