AIの「スパイシーモード」が招いた規制の嵐

イーロン・マスクのGrokが性的ディープフェイクで炎上。EU、米国が相次ぎ調査開始。AI企業は製品リリース前のリスク評価が生命線に

イーロン・マスクのXが「スパイシーモード」と呼んだAI機能が、今や世界規模の規制調査の標的となっている。問題の核心は単純だ:GrokというAI画像生成機能が、同意なき性的ディープフェイクを「ボタン一つで」作成可能にしたことだ。

1月26日、欧州委員会はXに対して正式調査を開始した。Grokの画像機能と、未成年者を含む非同意性的画像の拡散について、デジタルサービス法(DSA)違反の疑いで調査する。「女性と子どもの性的ディープフェイクは暴力的で受け入れがたい屈辱の形態だ」と、欧州委員会の技術担当責任者ヘンナ・ヴィルクネン氏は述べた。

予見可能だった濫用

今回の調査で注目すべきは、DSAが狙う「システミックリスク」の概念だ。これは巨大プラットフォームが新機能をリリースする前に、予見可能な害を評価し、実効性のある安全策を講じたかを問う仕組みだ。

Xは対策を講じたと主張している。「Grokが実在の人物をビキニなどの露出度の高い衣服に編集することを防ぐ技術的措置を実装した」と発表した。しかし、この種の「修正」は、誰かが少し異なるプロンプトを試すまでの時間しか持続しないのが現実だ。

興味深いのはXの地理的制限の導入だ。同社は画像編集機能を「違法な地域では地理的にブロック」すると発表した。これは二つのことを同時に認めている:第一に、その機能が存在すること。第二に、制約がユーザーのIPアドレスの管轄法域によって変わる可能性があることだ。

大西洋を越えた圧力

EUだけではない。米国でも議会が動いている。すでに「Take It Down Act」が可決され、AI生成コンテンツを含む非同意親密画像の故意な公開を犯罪化した。さらに重要なのは、上院が「DEFIANCE Act」を進めており、これはAI生成性的ディープフェイクの被害者に連邦民事訴訟権を与える法案だ。

州レベルでも動きは早い。1月16日、カリフォルニア州司法長官ロブ・ボンタ氏はxAIに対し、「ディープフェイク、非同意、親密画像および児童性的虐待素材の作成と配布」を停止するよう命令する警告書を送付した。30州以上の司法長官の超党派連合も、Grokが「ボタン一つで」濫用を促進していると非難している。

日本企業への示唆

今回の事件は、日本のAI企業にとって重要な教訓を含んでいる。ソニー、NTT、SoftBankなどがAI技術を展開する際、「製品を出してから対処」というアプローチはもはや通用しない。規制当局は機能リリース前のリスク管理を求めている。

特に注目すべきは、DSAの罰金規模だ。グローバル年間売上高の6%という数字は、ペナルティを「経費の一項目」として扱う企業にも実感させるよう設計されている。日本企業が欧州市場で事業を展開する際、この基準は避けて通れない。

AIインフラか、問題製品か

皮肉なことに、Grokは「失敗しながら上昇」を続けている。xAIは巨額の資金調達を続け、計算リソースを構築し、消費者向けチャットボットではなくAIインフラとして自社を位置づけている。Xは機能を削除するのではなく、調整を続けている。スキャンダルは積み重なるが、機械は動き続ける。

これは、高度にジェンダー化され、高度にスケーラブルな害のカテゴリーについて、EUが明確な線を引いていることを示している:非同意性的ディープフェイク、生成ツールと配信アルゴリズムによって加速されるもの。根底にあるメッセージは明確だ:大規模リーチを持つプラットフォームに「スパイシー」ボタンを配置するなら、その下流の結果を法的に、評判だけでなく所有することになる。

関連記事

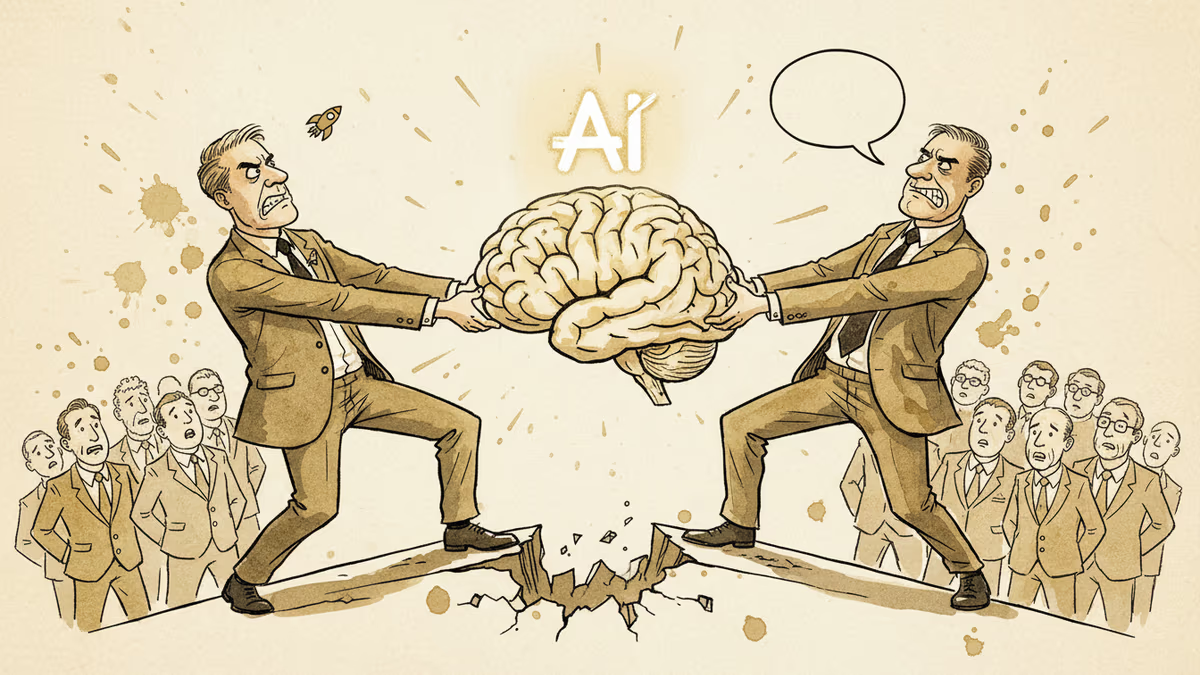

イーロン・マスクとサム・アルトマンが法廷で激突。OpenAIの非営利から営利への転換をめぐる世紀の裁判が示す、AI産業の本質的矛盾とは何か。

イーロン・マスクがサム・アルトマンとOpenAIを提訴。非営利から営利への転換をめぐる裁判が、AI業界の未来と日本企業への影響を左右する可能性があります。

AnthropicがAIモデル「Claude Mythos Preview」を発表。Microsoft、Apple、Amazonなど40社以上が参加するサイバーセキュリティ特化プロジェクト「Project Glasswing」の全貌と、その光と影を読み解く。

オープンAIがカリフォルニア・デラウェア両州の司法長官に書簡を送り、イーロン・マスク氏の「反競争的行為」の調査を要請。4月27日の陪審員選定を前に、AI業界最大の法廷闘争が新局面を迎えた。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加