ペンタゴンがAnthropicを「敵」と呼んだ日

米国防総省がAI企業Anthropicをサプライチェーンリスクに指定。Microsoftが法廷支援に乗り出した今、AI技術と国家安全保障の境界線はどこにあるのか。日本企業への影響も含めて考察する。

歴史的に、「サプライチェーンリスク」という烙印は、Huawei や ZTE のような中国企業に押されてきたものでした。ところが2026年3月、その同じレッテルが、サンフランシスコに本社を置く米国のAIスタートアップ Anthropic に貼られました。

何が起きたのか

Anthropic は2021年、OpenAI の元幹部たちによって設立された企業です。現在の企業評価額は3,800億ドルに達し、米国で最も急成長しているテクノロジースタートアップの一つとして知られています。同社のAIモデル「Claude」は、軍を含む多くの政府機関や民間企業に広く利用されてきました。

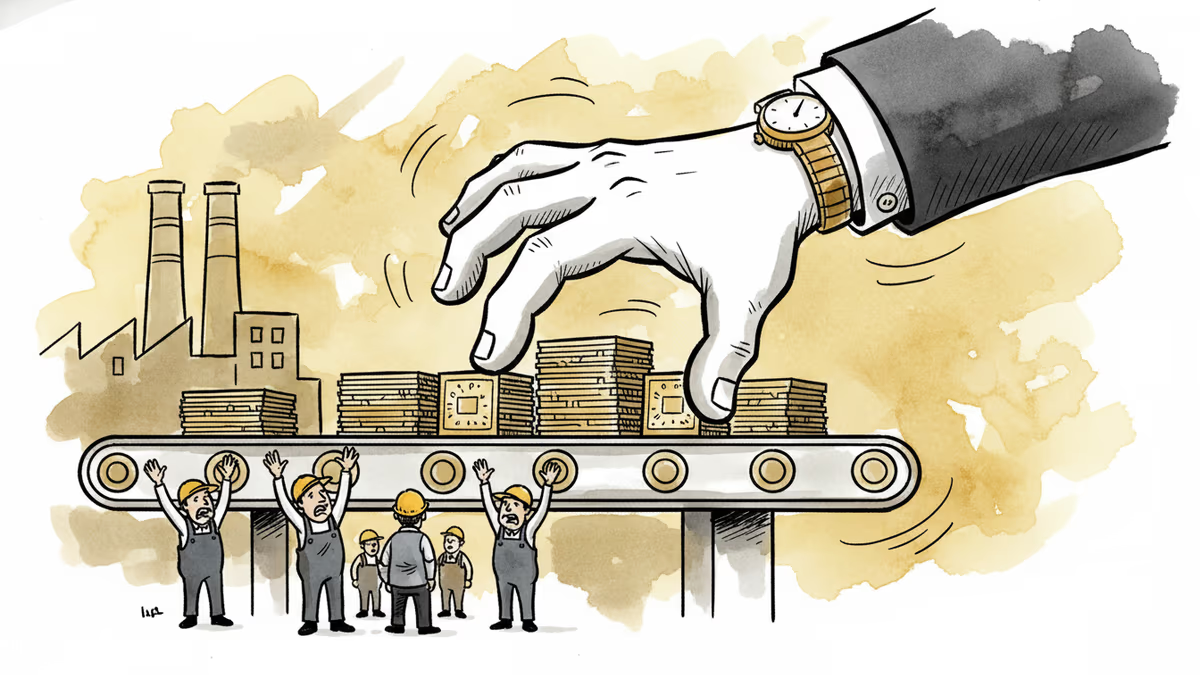

しかし先週、米国防総省(DOD)は突然、Anthropic の技術を「サプライチェーンリスク」に指定し、即日発効でその使用を禁止しました。この指定により、国防総省との契約を持つすべての企業やベンダーは、業務に Anthropic のモデルを使用していないことを証明しなければなりません。

事態の発端は、Anthropic と国防総省の間で進んでいた契約交渉の決裂にあります。Anthropic 側は、自社のモデルが「完全自律型兵器」や「国内での大規模監視」に使用されないという保証を求めました。一方、国防総省はすべての合法的な目的に対して無制限のアクセスを要求しました。双方が譲らず、交渉は破綻。その直後に今回の指定が下されました。

Anthropic は月曜日にトランプ政権を提訴し、この措置を「前例のない違法行為」と呼び、「近い将来、数億ドル規模の契約が危機にさらされている」と主張しています。

Microsoftが法廷に立った理由

ここで注目すべきは、Microsoft の動きです。同社は火曜日、サンフランシスコ連邦地方裁判所にアミカス・ブリーフ(第三者意見書)を提出し、国防総省の指定に対する一時的差し止め命令を支持しました。

Microsoft の主張は明快です。差し止め命令がなければ、同社を含む複数のテクノロジー企業が「国防総省向けの既存の製品・契約設定を即座に変更しなければならなくなる」とし、「これは重大な局面において、米国の戦闘員の能力を損なう可能性がある」と警告しています。

Microsoft がこの問題に深く関わるのには、財務的な背景もあります。同社は2024年11月、Anthropic への最大50億ドルの投資計画を発表しています。また2019年以来、競合する OpenAI への主要投資家でもあります。つまり Microsoft は、AI業界の二大プレイヤー双方に資本を投じているという、独特の立場にあります。

Amazon と Google も、国防総省の発表を受けて顧客に通知を送り、防衛関連以外の業務では Anthropic の製品が引き続き利用可能であることを伝えました。

なぜ今、この問題が重要なのか

この事件が持つ意味は、単なる一企業と政府の契約紛争を超えています。

AIの倫理的使用をめぐる境界線は、誰が、どのように引くのか。 これが今問われている本質的な問いです。

Anthropic が求めた「自律型兵器への不使用」という条件は、AI安全性の観点から見れば至極まっとうな要求に見えます。しかし国防総省の立場からすれば、民間企業が軍事利用の範囲を制限するという発想そのものが受け入れがたいものだったのかもしれません。

注目すべきタイミングもあります。世界中でAI規制の議論が加速する中、米国内で政府とAI企業の関係が新たな局面を迎えつつあります。欧州連合がEU AI法を施行し、中国が独自のAI規制を整備する一方で、米国では規制の枠組みがまだ流動的です。今回の事件は、その空白が生む摩擦の一例と言えるでしょう。

日本企業・日本社会への視点

日本にとって、この問題は対岸の火事ではありません。

NTT、富士通、NEC などの日本の大手IT企業は、クラウドサービスを通じて Anthropic の Claude を含む海外AIモデルを活用したサービスを展開しています。米国の防衛関連規制が拡大した場合、日米同盟の文脈で日本の防衛産業や政府系IT調達にも影響が及ぶ可能性は否定できません。

より広い視点では、今回の事件は「AIの調達リスク」という新しい概念を浮き彫りにしています。これまで企業のIT調達では、セキュリティや価格、性能が主な評価軸でした。しかし今後は、「そのAIモデルが、どの国の政府との関係でリスクに指定される可能性があるか」という政治的リスクも考慮しなければならない時代が来るかもしれません。

日本が推進する「信頼できるAI」(Trustworthy AI)の概念とも重なります。技術の信頼性は、性能だけでなく、その倫理的枠組みと政治的安定性によっても規定される——今回の事件はその現実を示しています。

関連記事

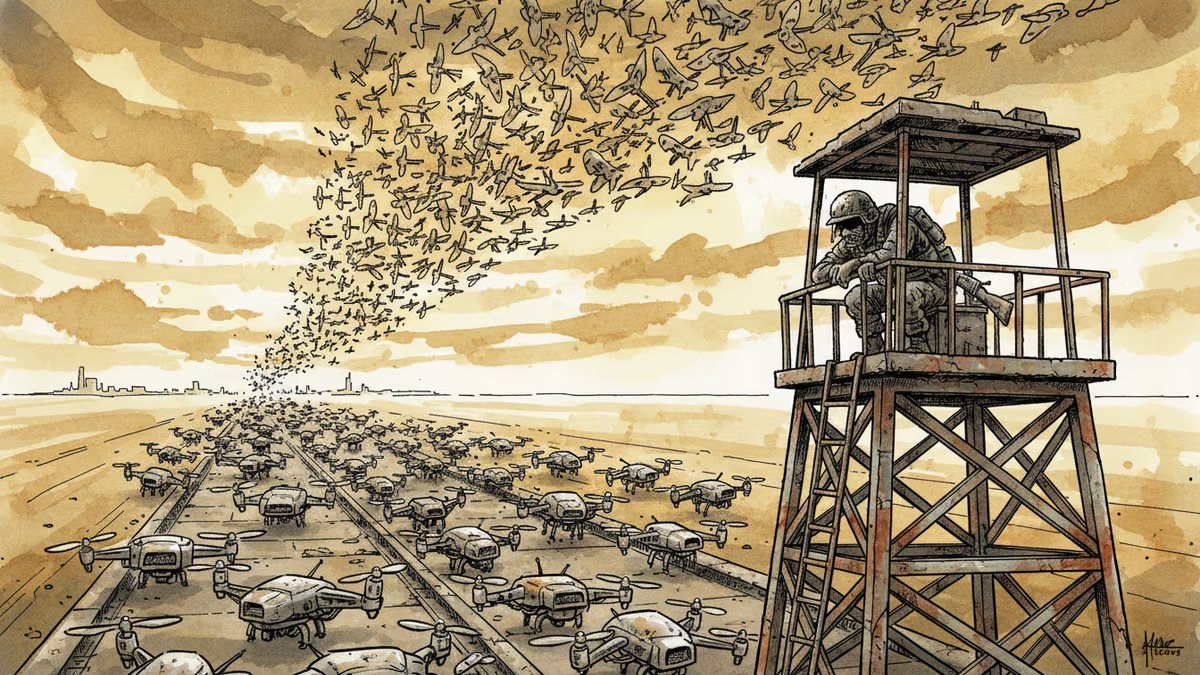

ウクライナの戦況が最悪期を迎えた中、大量ドローン生産が戦局を変えつつある。日本の防衛産業や安全保障政策にとって、この「無人機戦争」が示す教訓とは何か。

欧州の新たな半導体法案が、チップメーカーに既存契約の破棄を強制する可能性を示唆。サプライチェーンの安定と企業の契約自由のはざまで、日本企業はどう動くべきか。

元CIA長官ペトレイアス氏が警告——自律型ドローン群は既存の防衛システムを無力化する。ウクライナとイランの戦場が示す無人兵器の未来と、日本企業・投資家が注目すべき構造的変化を読み解く。

マイクロソフトが2025年に設立したTrusted Technology Groupの取り組みを通じ、AI開発における責任とスピードのトレードオフ、障害者包摂の意義を多角的に考察します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加