ユタ州警察 AI カエル誤認:AIが人間を「カエル」と判断した衝撃の不具合

ユタ州警察が導入したAIソフトウェアが人間を「カエル」と誤認。治安維持を目的とした最新技術の信頼性とアルゴリズムの不具合がもたらす法執行のリスクについて詳しく解説します。2025年末の最新テックニュース。

魔法使いの仕業ではありません。警察が信頼を寄せる最新のAIが、人間を「カエル」に変えてしまいました。ユタ州警察が導入した治安維持のためのソフトウェアが、歩行者を両生類と誤認していたことが明らかになり、技術の信頼性に疑問符が打たれています。

ユタ州警察 AI カエル誤認:安全を守るはずの技術が露呈した脆弱性

ローカルメディアのFox Newsの報道によると、ユタ州の法執行機関が街の安全を確保するために活用しているAIソフトウェアが、監視対象の人物を「カエル」であると判定する事案が発生しました。これは比喩的な表現ではなく、システムがデータ上で明確に人間を動物として分類していたことを意味します。

このニュースは、当初「警察による最新技術の活用」という前向きな文脈で語られる予定でしたが、ソフトウェアの致命的なバグが発覚したことで、プライバシー保護団体や技術倫理の専門家から強い懸念が示されています。法執行機関において、AIの判断が逮捕や捜査の根拠となる場合、こうした「誤認」は取り返しのつかない人権侵害につながる恐れがあるからです。

法執行機関におけるAI利用の境界線

警察当局は、AIの導入により犯罪抑止効果が高まると主張していますが、今回のカエル誤認事件は、AIが万能ではないことを改めて証明しました。システムが人間をカエルと見間違えるのであれば、ある無実の市民を「武器を持った容疑者」と見間違える可能性も否定できないためです。現時点で、このソフトウェアがどの程度の頻度でこうした誤作動を起こしているのか、詳細は明らかにされていません。

関連記事

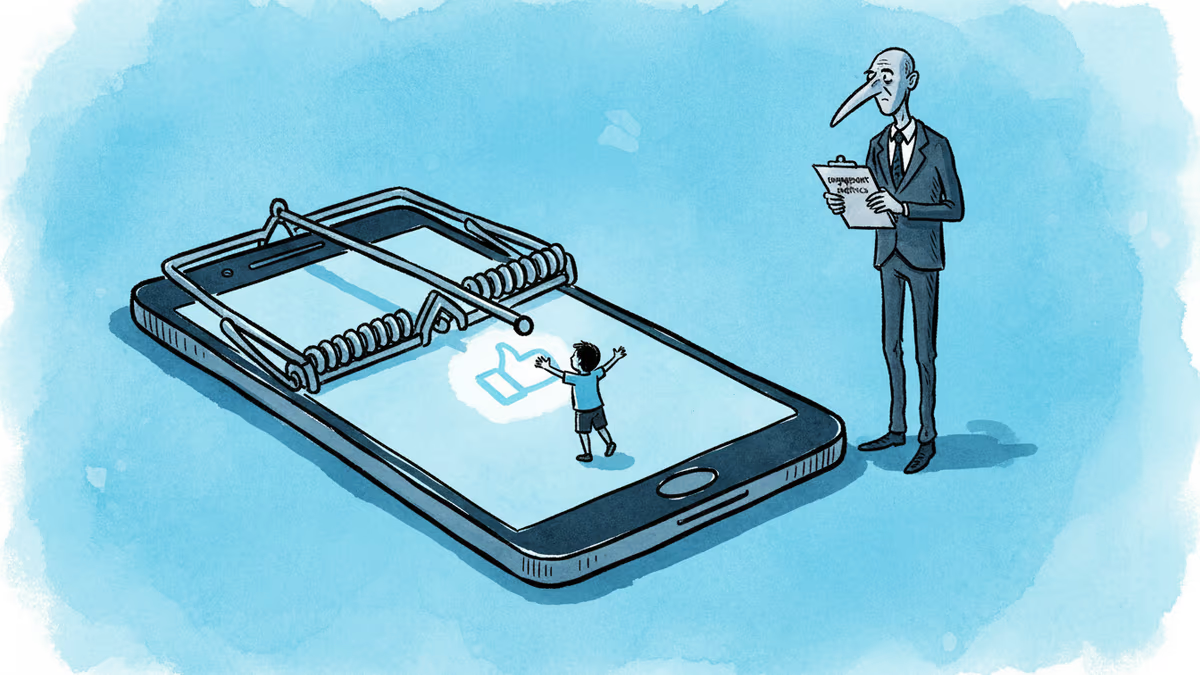

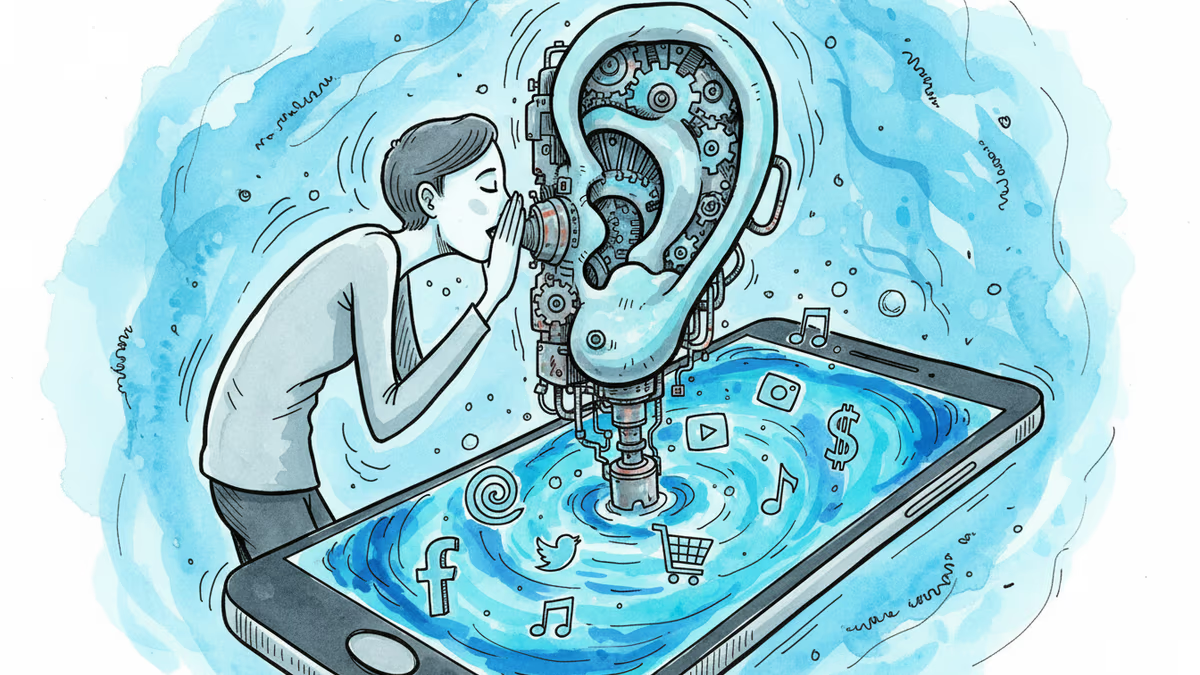

Metaが2件の訴訟で相次いで敗訴。SNSの「依存性設計」が初めて法的責任を問われた今、日本の子どもたちとプラットフォーム規制はどう変わるのか。

BlueskyチームがAIアシスタント「Attie」を発表。自然言語でカスタムフィードを作成できるこのアプリは、SNSのアルゴリズム支配に一石を投じる可能性があります。AT Protocolとの連携にも注目。

Threadsが米国で「Dear Algo」機能を開始。ユーザーが投稿でアルゴリズムに直接要望を伝える新しいコミュニケーション方法とは?

2020年のGoogle内部文書により、学校への投資を通じて子供を「生涯顧客」にする戦略が判明。メンタルヘルスへの影響を巡る大規模訴訟で明らかになりました。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加