テスラ、2億4300万ドルのオートパイロット判決覆しに失敗

米フロリダ州の裁判所がテスラの控訴を棄却。2019年の死亡事故でオートパイロットの責任が確定し、自動運転技術の法的責任が明確化

2億4300万ドル。この巨額の賠償金額が、自動運転技術の未来を左右する重要な判例として確定した。

米フロリダ州の裁判所は2月20日、テスラが求めていた陪審員評決の覆しを棄却する判断を下した。2019年に発生した死亡事故で、テスラのオートパイロット機能に3分の1の責任があるとした昨年8月の評決が最終的に確定することになる。

事故の詳細と法廷での争い

問題となったのは2019年にフロリダ州で発生した交通事故だ。ナイベル・ベナビデス氏が死亡し、ディロン・アングロ氏が重傷を負った。陪審員は運転手に3分の2の責任があるとしながらも、テスラにも3分の1の責任があると判断した。

注目すべきは、懲罰的損害賠償がテスラにのみ課されたことだ。これは単なる過失ではなく、企業の行為に問題があったと陪審員が判断したことを意味する。

テスラ側は「責任は運転手にある」として控訴したが、ベス・ブルーム判事は「テスラが提示した根拠は、裁判中や略式判決の審理で既に検討され、却下されたものと実質的に同じだ」と述べ、これを退けた。

日本の自動車業界への影響

この判決は、自動運転技術を開発する日本企業にとって重要な先例となる。トヨタ、日産、ホンダといった日本の自動車メーカーは、レベル2の運転支援システムから高度な自動運転技術まで幅広く開発を進めているが、今回の判決は技術開発と同時に法的責任の明確化が不可欠であることを示している。

特に日本市場では、高齢化社会における交通事故防止への期待から自動運転技術への関心が高い。しかし、技術への過度な依存が新たなリスクを生む可能性も浮き彫りになった。

技術開発における責任の境界線

今回の判決で最も重要なのは、運転支援システムと完全自動運転の境界線が法的にも明確になったことだ。オートパイロットは「運転支援」システムであり、運転手が常に注意を払う必要があるとテスラは主張してきた。

しかし陪審員は、システムの設計や機能説明に問題があったと判断した。これは日本企業にとって、技術の能力と限界を正確に伝える重要性を示している。

消費者への情報提供、システムの設計思想、そして万が一の事故時の責任分担—これらすべてを事前に明確にする必要がある。

関連記事

テスラで熱管理システムを開発したドリュー・バリーノ氏が、新スタートアップ「Sadi Thermal Machines」を設立。EVで培った技術が家庭のエネルギー革新にどう活かされるのか、日本市場への示唆も含めて考えます。

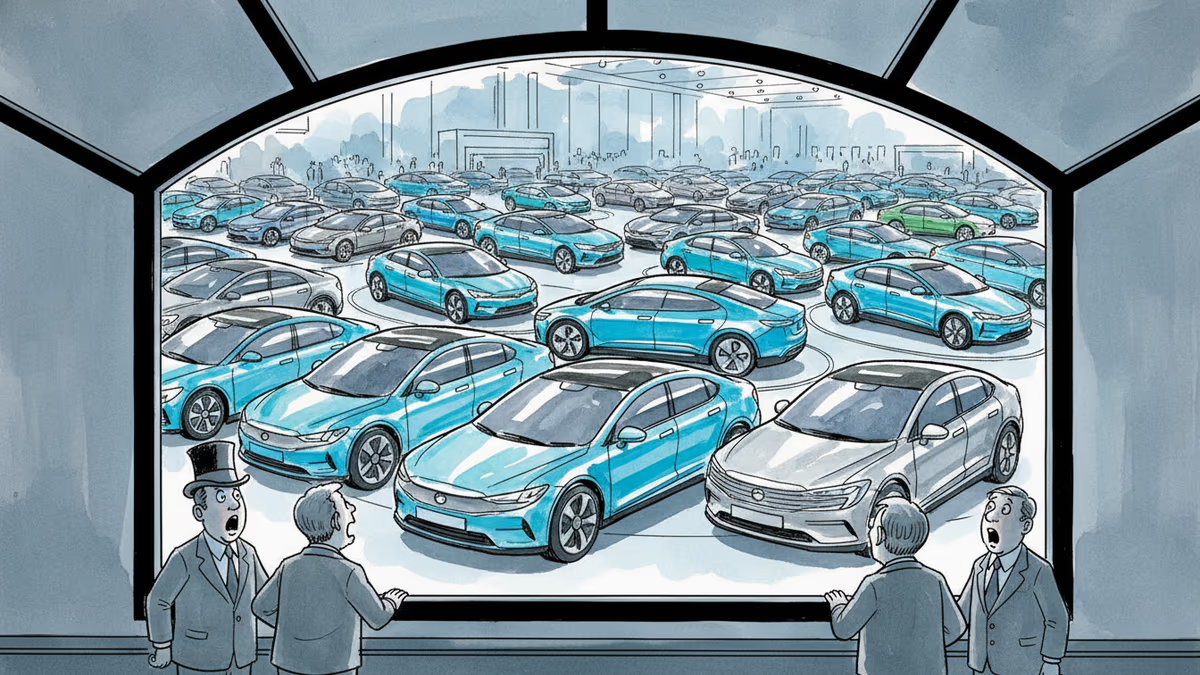

2026年北京モーターショーに見る中国EV産業の質的転換。価格競争から技術覇権へ。トヨタ・日産・VWが中国サプライヤーに依存する現実と、日本自動車産業への構造的影響を読む。

テスラがサイバートラック後輪駆動ロングレンジ173台をリコール。ブレーキローターの欠陥により走行中に車輪が脱落する恐れがあり、安全性への懸念が高まっています。

イーロン・マスクがOpenAIをテスラに吸収しようとしていた計画が法廷で明らかに。マスク対オルトマン裁判が示す、AI覇権争いの深層と非営利組織の限界とは。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加