AIに裁かれる日、人間の「疑う力」は何をもたらすか

AI判事が90分で有罪を決定するSF映画『Mercy』を起点に、法廷における人間の陪審員の役割とAIの限界を多角的に考察。日本社会への示唆も含む。

90分で証拠を分析し、有罪か無罪かを判定し、そのまま死刑を執行する——そんな裁判官が存在したとしたら、あなたはその判決を「正義」と呼べるだろうか。

2026年1月に公開されたSF映画『Mercy』は、暴力と混乱に覆われた近未来のロサンゼルスを舞台に、Judge MaddoxというAIが支配する法廷を描く。クリス・プラット演じる警察官は、妻殺しの疑いで「有罪スコア97.5%」を叩き出され、生き延びるためにそのスコアを92%以下に下げなければならない。映画はエンターテインメントとして作られているが、その設定が問いかける本質は重い。AIは本当に「裁く」ことができるのか。

法廷に忍び込むAI——フィクションと現実の境界線

AI判事はまだ映画の中の話だ。しかし、AIが法廷に入り込んでいるのはすでに現実である。アメリカでは保釈の可否を判断する「リスク評価ツール」が複数の州で導入されており、弁護士や裁判官が法的先例の調査にAIを活用するケースも増えている。一部の裁判官は判決文の起草にAIを試験的に使い始め、模擬裁判では陪審員の代わりにAIを使うシミュレーションも行われている。

日本でも無縁ではない。裁判員制度が導入されて約17年が経つ現在、「感情的な判断を排除したい」「より客観的な判決を」という声は根強い。AIによる量刑支援ツールの研究は国内外で進んでおり、日本の法曹界もその波を意識せざるを得ない状況にある。

だが、陪審員制度を研究する学者ソナリ・チャクラヴァルティ(ウェズリアン大学)は、こう警告する。「AIは法的判断の意味を歪める。人間の意思決定者が何をもたらすか、そしてなぜ彼らが法制度の正当性に不可欠なのかを、AIは覆い隠してしまう」。

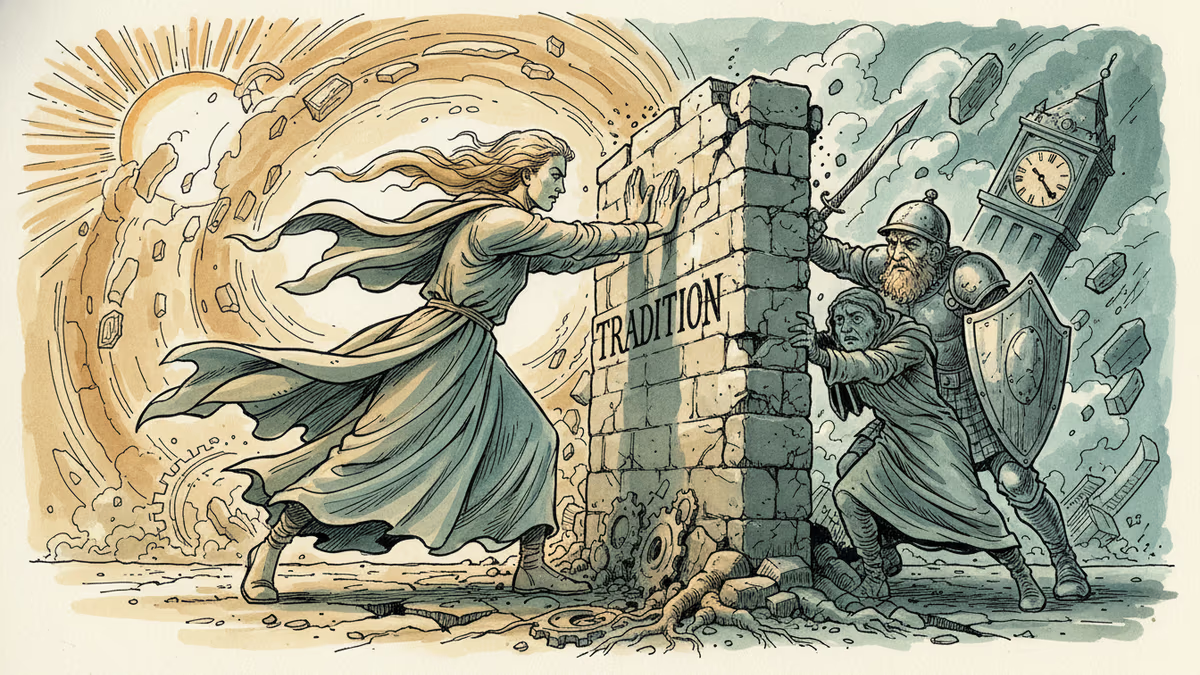

「疑うこと」は欠陥ではなく、設計の核心だ

有罪か無罪かを数値で示すことは、一見合理的に見える。しかし、刑事裁判における証拠の評価は、スコアボードで測れるものではない。証拠を解釈することは、知的な困難であるだけでなく、感情的な重みを伴う作業だ。無実の人を傷つけるかもしれないという重力は、判断そのものの本質的な一部である。

哲学者ブライアン・キャントウェル・スミスはこう論じた。AIは強力な計算的決定を下せるが、「判断」にはそれ以上のものが必要だ——特定の条件のもとで倫理的理想をどう適用するかについての人間の熟慮、そして何が問われているかについての他者の見解との格闘。それは純粋に合理的でもなく、純粋に感情的でもない。

法学者ジェームズ・Q・ウィットマンの研究によれば、「合理的疑いを超えた有罪」という基準の起源は中世にまで遡る。キリスト教徒の陪審員たちは、裁きと罰という行為が本来神のものであると信じ、その役割を担うことを恐れた。18世紀になってようやく、この言葉が成文化された——それは人間の躊躇を認めるためだった。陪審員は全能である必要はない。有罪への確信は、プロセスへの適切な曖昧さと共存できる。

さらに、有罪判決には陪審員の全員一致が必要だ。これはウィットマンが「道徳的な慰め」と呼ぶものを提供する。12人が重い道徳的責任を分かち合うことで、判断の重みを拡散させる。AIに「97.5%の確率で有罪」と言われることと、12人の人間が全員一致で「有罪」と言うことは、根本的に異なる意味を持つ。

日本社会が問われること——「和」の文化と司法の個人責任

ここで、日本固有の視点から考えてみたい。裁判員制度は、一般市民が重大刑事事件の判決に参加する仕組みだ。制度導入当初、「素人が判断できるのか」「感情的になりすぎないか」という懸念の声は多かった。しかし実際には、裁判員を経験した市民の多くが「重さを感じた」「責任を実感した」と証言している。その「重さ」こそが、チャクラヴァルティが言う法制度の道徳的正当性の源泉ではないか。

一方で、日本社会には「和を乱さない」「多数に従う」という集団的規範が存在する。全員一致が求められる場面で、少数意見を持つ裁判員が自分の疑念を貫けるか——これは制度設計の問題であり、文化的な問いでもある。AIが「94%有罪」と算出した場合、その数字に引っ張られて疑念を封じ込めてしまう裁判員が増えないとも限らない。

高齢化と人手不足が進む日本では、AIによる業務効率化への期待は大きい。しかしチャクラヴァルティが引用するマルクスの「類的存在(species-being)」——人間だけが行える意識的・目的的な活動——という概念は、効率化の波の中でどの領域を人間のために守るべきかを問いかける。司法はその最前線のひとつだろう。

AIは証拠の中のパターンを見つけ、膨大な判例を瞬時に検索し、行政的な作業を効率化することはできる。しかし「疑うこと」の質——これはもっと議論が必要なのか、それとも証拠が不十分なのかを見極める感覚——は、人間の陪審員にしか担えない。それは欠陥ではなく、設計の核心だ。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

AIが日常に深く浸透する今、人間の自律性とは何かを問い直す。カントの自律概念から生物学的オートポイエーシスまで、哲学・神経科学・AI倫理の交差点で「自律」を再定義する。

初のアメリカ人教皇レオ14世は就任1年で、平和・人間の尊厳・AIという3つのテーマを軸に独自の声明を発信し続けている。日本社会にとって、その問いかけは決して遠い話ではない。

AIの感情問題が注目される今、哲学者ジェフ・セボは昆虫からAIまで「道徳的配慮の範囲」を問い直す。感覚能力とは何か、誰が道徳的保護に値するのか。

作家デイヴィッド・エプスタインの体験から始まる「モノタスキング」の実践。マルチタスクが当たり前の時代に、集中することの意味と難しさを多角的に考察します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加