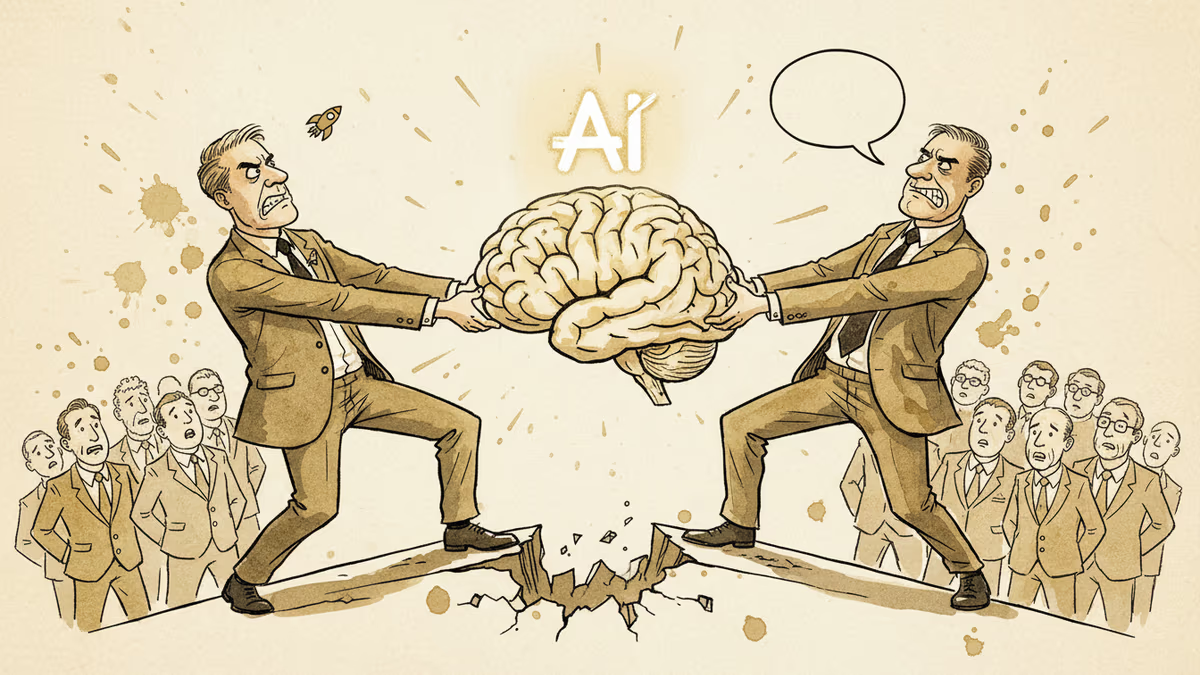

AIと戦争の間で:OpenAIは何を選んだのか

OpenAIが米国防総省と契約を締結。ライバルのAnthropicが「国家安全保障上のリスク」として排除された直後の動きは、AI企業の倫理と国家安全保障の間にある深い亀裂を露わにしています。

AIが「殺傷の連鎖(キルチェーン)」に組み込まれるとき、誰がその責任を負うのでしょうか。

2026年2月、OpenAIのCEO サム・アルトマンは米国防総省(DOD)との契約締結を発表しました。タイミングは偶然ではありませんでした。その数時間前、ライバル企業のAnthropicが国防長官 ピート・ヘグセスによって「サプライチェーン上の国家安全保障リスク」として取引禁止リストに載せられていたのです。

なぜAnthropicは排除されたのか

事の発端は契約交渉の決裂でした。国防総省はAnthropicに対し、「すべての合法的な目的」のためにAIモデルへの無制限アクセスを求めました。一方Anthropicは、完全自律型兵器や国内の大規模監視への使用禁止を明文化するよう求めていました。この溝は埋まらず、交渉は決裂。Anthropicはペンタゴンの機密ネットワークに最初に導入されたAIモデルを持つ企業であり、Palantirなどの防衛請負業者との連携でも高く評価されていただけに、ワシントンの関係者たちにとってこの展開は「衝撃的」なものでした。

アルトマンはXへの投稿で、「国内の大規模監視の禁止」と「自律型兵器システムを含む武力行使における人間の責任」が同社の「最も重要な安全原則の2つ」だと述べました。そして国防総省はその原則に同意し、契約に盛り込んだと説明しています。OpenAIが公開した契約書の抜粋には、「同機関はAIシステムをすべての合法的な目的のために使用できる」と記されていますが、OpenAIは自社の「安全スタック」と契約文言、既存の法律によって大規模監視や完全自律型兵器への使用は防げると主張しています。

議会は何を懸念しているのか

2026年3月12日、アルトマンはワシントンD.C.で複数の議員と面会しました。アリゾナ州選出の民主党上院議員 マーク・ケリー(元宇宙飛行士・海軍パイロット)は、AIが「キルチェーン」の中でどのように使われるかについて「詳細に議論した」と述べ、「深刻な疑問を提起した」と語りました。

「憲法を常に念頭に置き、それに準拠していることを確認しなければならない」とケリー議員は述べ、現在DODとAI企業の契約に関する法的枠組みを整備する立法作業を進めていることを明かしました。「議会が関与する必要がある。この技術は非常に速く進んでいるが、米国議会は私たちが望むほど速くは動けない」と率直に認めています。

なぜ今、この問題が重要なのか

この一連の出来事は、AI産業が避けては通れない問いを突きつけています。倫理的な原則を掲げるAI企業が、軍事契約を結ぶ際にどこまでその原則を守れるのか、という問いです。

OpenAIとAnthropicの対応の違いは興味深いです。Anthropicは明文化された使用制限を求めて交渉が決裂し、排除されました。OpenAIは「安全スタック」という技術的な仕組みと既存法律への信頼を根拠に契約を締結しました。どちらのアプローチが実際に安全を担保するかは、まだ誰にもわかりません。

日本にとってこの問題は決して対岸の火事ではありません。防衛省は近年、AIを活用した防衛能力の強化を進めており、川崎重工や富士通などの国内企業もAI・防衛分野の連携を模索しています。米国でのAI軍事利用をめぐる規制の枠組みは、日本を含む同盟国の防衛政策にも直接影響を与える可能性があります。また、自衛隊の活動範囲や武力行使の解釈をめぐる日本独自の憲法的制約は、AI兵器システムの導入においてさらに複雑な問いを生み出します。

さらに、ソフトバンクがOpenAIへの大規模投資を行っている文脈を考えると、日本の民間資本がAI軍事技術の発展に間接的に関与している構図も見えてきます。投資家にとって、AI企業の軍事契約は収益機会である一方、倫理的リスクや規制リスクとも表裏一体です。

関連記事

イーロン・マスクがサム・アルトマンとOpenAIを提訴。非営利から営利への転換をめぐる裁判が、AI業界の未来と日本企業への影響を左右する可能性があります。

OpenAIとAnthropicがSalesforce、Snowflake、Palantirから幹部を相次いで引き抜き。AI企業が狙うのは技術者だけでなく、企業顧客との深い関係性。ソフトウェア業界の構造変化が加速する。

米インド太平洋軍司令官が議会で証言。米軍がビットコインネットワーク上でノードを運用中と初めて公式に認めた。中国との戦略的競争における暗号資産の役割とは。

OpenAIでKevin Weil、Bill Peebles、Srinivas Narayananの3幹部が退社。IPO準備が進む中、相次ぐ離脱は何を示唆するのか。AI業界リーダー必読の分析。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加