Roblox 顔認証 義務化 2026:チャット利用時の年齢確認をグローバル展開

Robloxはチャット機能利用時の顔認証による年齢確認を義務化しました。2026年よりグローバル展開されるこの措置は、児童の安全を守るための法的圧力に対応したものです。年齢別の細かなチャットグループ分けも導入されます。

あなたの子供のチャット相手は、本当に同年代でしょうか?オンライン上での児童の安全確保が問われる中、Robloxは、チャット機能を利用するすべてのユーザーに対し、顔認証による年齢確認を義務化することを発表しました。一部の市場での試験運用を経て、2026年よりグローバル規模でのロールアウトが本格化しています。

Roblox 顔認証 義務化の仕組みとプライバシー保護

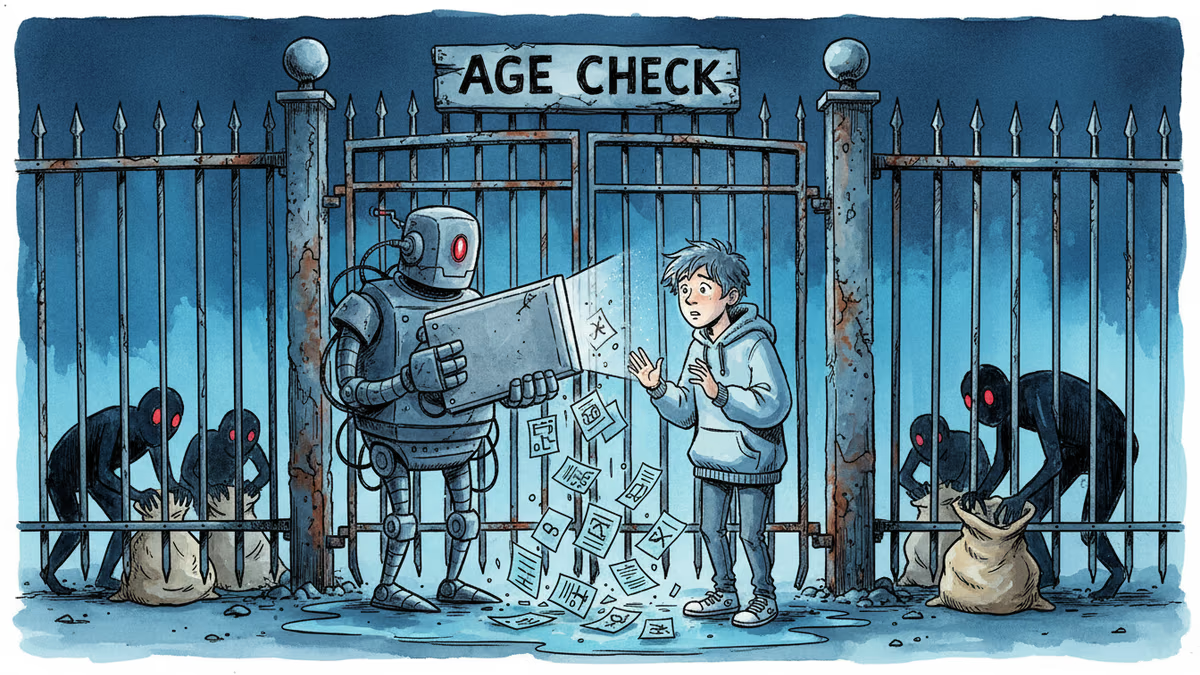

新しい仕組みでは、ユーザーはRobloxアプリ内でカメラへのアクセスを許可し、画面上の指示に従って顔をスキャンする必要があります。このプロセスは外部ベンダーのPersonaによって処理されます。プライバシーへの配慮として、RobloxおよびPersonaの両社は、確認作業が完了した直後にユーザーの画像や動画データを削除すると説明しています。

また、13歳以上のユーザーは、顔認証の代わりに身分証明書(ID)による認証を選択することも可能です。ゲームのプレイ自体に年齢確認は必須ではありませんが、チャット機能を利用するためには、このステップを避けて通ることはできません。

細分化された年齢別グループと法的背景

今回の導入の背景には、テキサス州やルイジアナ州の司法長官らによる、児童の安全性に関する複数の訴訟があります。これに対しRobloxは、生年月日を入力するだけの従来の方法よりも、正確な年齢把握が可能になると主張しています。認証完了後、ユーザーは以下の6つの年齢層に基づいたグループ内でチャットを行うことになります。

- 9歳未満(保護者の同意が必要)

- 9~12歳

- 13~15歳

- 16~17歳

- 18~20歳

- 21歳以上

関連記事

ディズニーランドが顔認証システムを導入。「任意」とされるその仕組みは、本当に自由な選択を保証しているのか。テクノロジーと日常空間のプライバシーをめぐる問いを考えます。

VR・ソーシャルゲームプラットフォームRec Roomが2026年6月1日に閉鎖。かつて35億ドルの評価額を誇ったサービスがなぜ収益化に失敗したのか。メタバースビジネスの本質的な課題を読み解く。

MetaがHorizon WorldsのVR版廃止を撤回。しかしこれは復活ではなく、静かな終わりの始まりかもしれません。メタバース戦略の転換点を読み解きます。

Discordが年齢確認システムの導入を撤回。ユーザーの反発と技術的課題が浮き彫りに。年齢確認技術の現状と未来、そして日本社会への影響を多角的に分析します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加