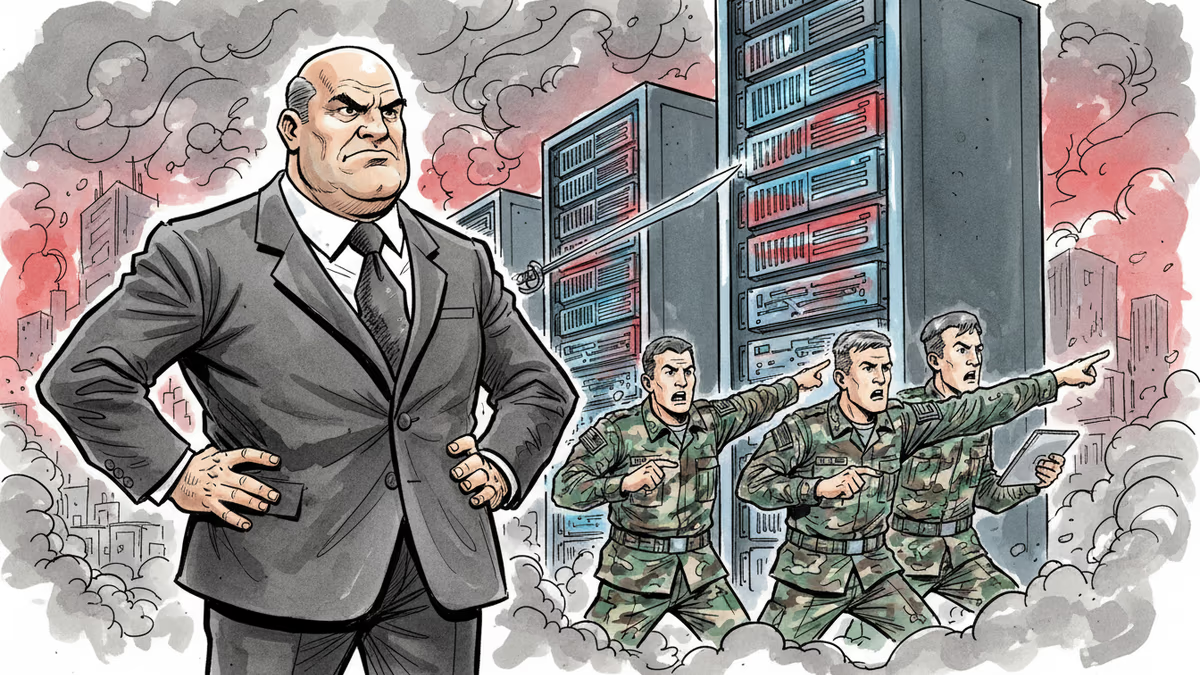

トランプ政権、Anthropic製品の使用停止を連邦機関に命令

ペンタゴンとの対立を受け、トランプ大統領がAnthropic製品の政府利用を6ヶ月以内に段階的廃止するよう指示。AI企業の倫理的立場と国防政策の衝突が浮き彫りに。

6ヶ月。これがAnthropicに与えられた「退場」までの猶予期間だ。

トランプ大統領は2月27日、Truth Socialへの投稿で、すべての連邦機関に対してAnthropic製品の使用停止を命じた。「我々はそれを必要とせず、望んでもいない。二度と彼らとビジネスをすることはない」と大統領は断言した。

対立の核心:監視と自律兵器

今回の決定は、Anthropicが国防総省との契約において、2つの「譲れない一線」を設けたことに端を発している。同社のAIモデルを大規模な国内監視や完全自律兵器の開発に使用することを拒否したのだ。

ピート・ヘグセス国防長官はこの制限を「過度に制約的」と判断。一方、Anthropicのダリオ・アモデイCEOは木曜日の公開投稿で、「この2つの安全保障措置を維持したまま、国防総省と戦闘員への貢献を続けることを強く希望する」と立場を堅持した。

興味深いのは、トランプ大統領が国防生産法の発動やAnthropicをサプライチェーンリスクに指定する措置には言及していないことだ。代わりに、6ヶ月の段階的廃止期間中の協力を求め、非協力的な場合は「重大な民事・刑事上の結果」を警告している。

日本企業への波及効果

Anthropicの政府契約からの排除は、日本のAI戦略にも影響を与える可能性がある。同社はソフトバンクグループとの提携を通じて日本市場に参入しており、政府系プロジェクトでの活用も検討されていた。

日本政府は現在、AI技術の軍事利用について慎重な姿勢を取っているが、同盟国である米国の動向は無視できない。特に、三菱重工業や川崎重工業などの防衛関連企業は、米国との共同開発プロジェクトにおいて、どのAI技術が「承認済み」なのかを注視する必要がある。

企業倫理と国家安全保障の境界線

Anthropicの決断は、AI企業が直面する根本的なジレンマを浮き彫りにしている。技術の平和的利用を掲げる企業理念と、国防契約がもたらす巨額の収益機会との間で、どこに線を引くのか。

同社の「Constitutional AI」アプローチは、AIシステムに人間の価値観を組み込むことを目指している。しかし、その「価値観」が政府の政策と衝突した時、企業はどのような選択をするべきなのだろうか。

OpenAIやGoogleといった他の大手AI企業も、同様の判断を迫られる日が来るかもしれない。特に、中国との技術競争が激化する中で、「倫理的AI」と「国家競争力」のバランスをどう取るかは、業界全体の課題となっている。

関連記事

AnthropicがOpus 4.8を公開。前作からわずか41日での更新は競争圧力の表れか。「不確実性を自ら報告する」設計思想が、企業AI活用の信頼基準を塗り替えようとしている。

産休・育休中にAIコーディングツールが普及し、復職後に「スキルギャップ」に直面する女性エンジニアたちの実態。技術変化が働く母親に与える不均衡な影響を多角的に分析する。

YouTubeが新AI機能「カスタムフィード」を発表。見たい動画をテキストで入力するだけで、パーソナライズされた専用フィードが生成される。この変化はコンテンツ消費の何を変えるのか。

ファーウェイ傘下HiSiliconが「タウのスケーリング則」という新設計思想を発表。米国の輸出規制を迂回する可能性を秘めた半導体戦略の全貌と、日本企業への影響を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加