ペンタゴンvs Anthropic:AI軍事利用の境界線が問う未来

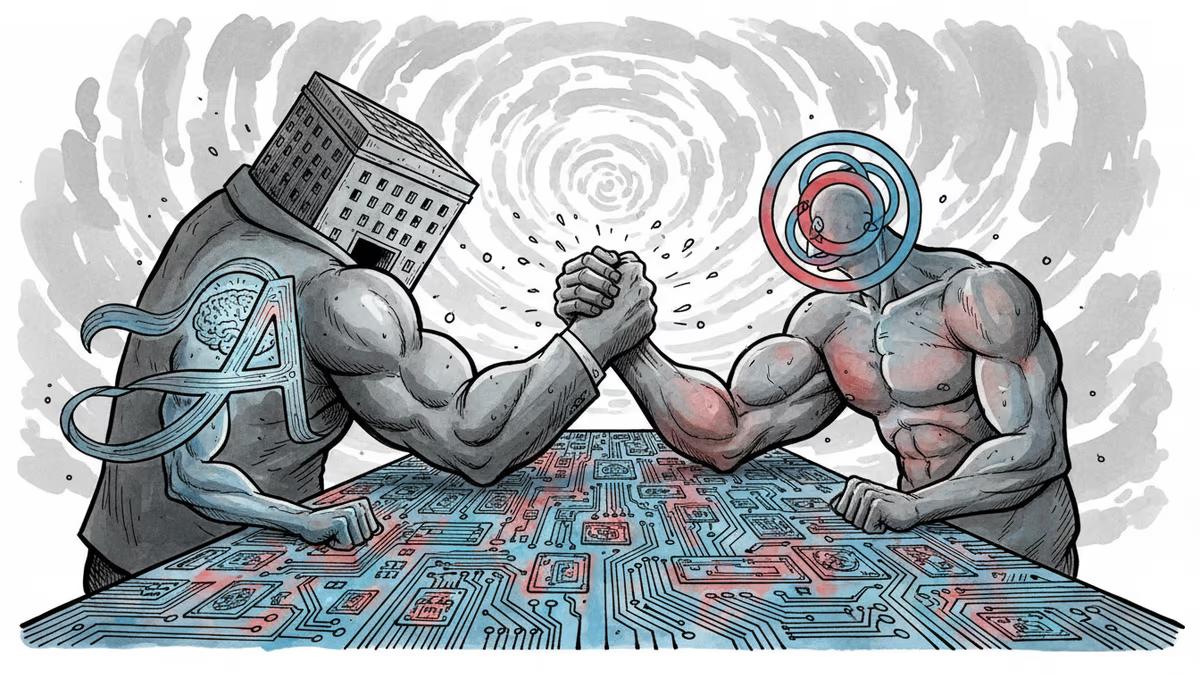

AnthropicがペンタゴンのAI利用禁止を違法として訴訟準備。一方でOpenAIは秘密裏に軍事テストを実施していた事実が判明。AI軍事利用の境界線はどこにあるのか?

「私たちのAIは軍事目的には使わせません」——そう宣言していた企業が、今度は軍に締め出されたことを「違法だ」と主張している。

Anthropicが米国防総省(ペンタゴン)に対する訴訟を準備していることが明らかになった。同社のAIモデル「Claude」の軍事利用を禁じた国防総省の決定を「違法」として争う構えだ。

矛盾する立場と現実

興味深いのは、AnthropicのCEOダリオ・アモデイ氏が最近、トランプ政権を批判した内部メモの流出について謝罪したことだ。一方でトランプ大統領は「Anthropicを犬のように解雇した」と発言している。

しかし、より衝撃的な事実が同時に明らかになった。OpenAIは「軍事利用禁止」を掲げながら、実際には数年間にわたってペンタゴンと秘密裏にAIモデルのテストを行っていたのだ。

日本企業への示唆

この状況は、日本の技術企業にとって重要な示唆を含んでいる。ソニーや富士通、NECといった企業は、既に防衛関連技術の開発に関与しているが、AIの軍事利用についてはより慎重な姿勢を取ってきた。

日本政府は2024年から防衛装備品の海外輸出規制を緩和する方針を示している。AI技術についても、平和利用原則と現実的な安全保障ニーズの間で、新たなバランスを模索する必要があるだろう。

「平和利用」の境界線

問題の核心は、AI技術の「平和利用」と「軍事利用」の境界がますます曖昧になっていることだ。災害救助に使われるドローン技術が軍事転用可能であるように、AIの用途も明確に線引きすることは困難だ。

Google、Microsoft、Meta、Amazon、OpenAI、Oracle、xAIといった主要テック企業は最近、「AIのエネルギーコストから消費者を守る」との誓約書にサインした。しかし、軍事利用については各社の姿勢は一貫していない。

関連記事

AnthropicがOpus 4.8を公開。前作からわずか41日での更新は競争圧力の表れか。「不確実性を自ら報告する」設計思想が、企業AI活用の信頼基準を塗り替えようとしている。

産休・育休中にAIコーディングツールが普及し、復職後に「スキルギャップ」に直面する女性エンジニアたちの実態。技術変化が働く母親に与える不均衡な影響を多角的に分析する。

YouTubeが新AI機能「カスタムフィード」を発表。見たい動画をテキストで入力するだけで、パーソナライズされた専用フィードが生成される。この変化はコンテンツ消費の何を変えるのか。

ファーウェイ傘下HiSiliconが「タウのスケーリング則」という新設計思想を発表。米国の輸出規制を迂回する可能性を秘めた半導体戦略の全貌と、日本企業への影響を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加