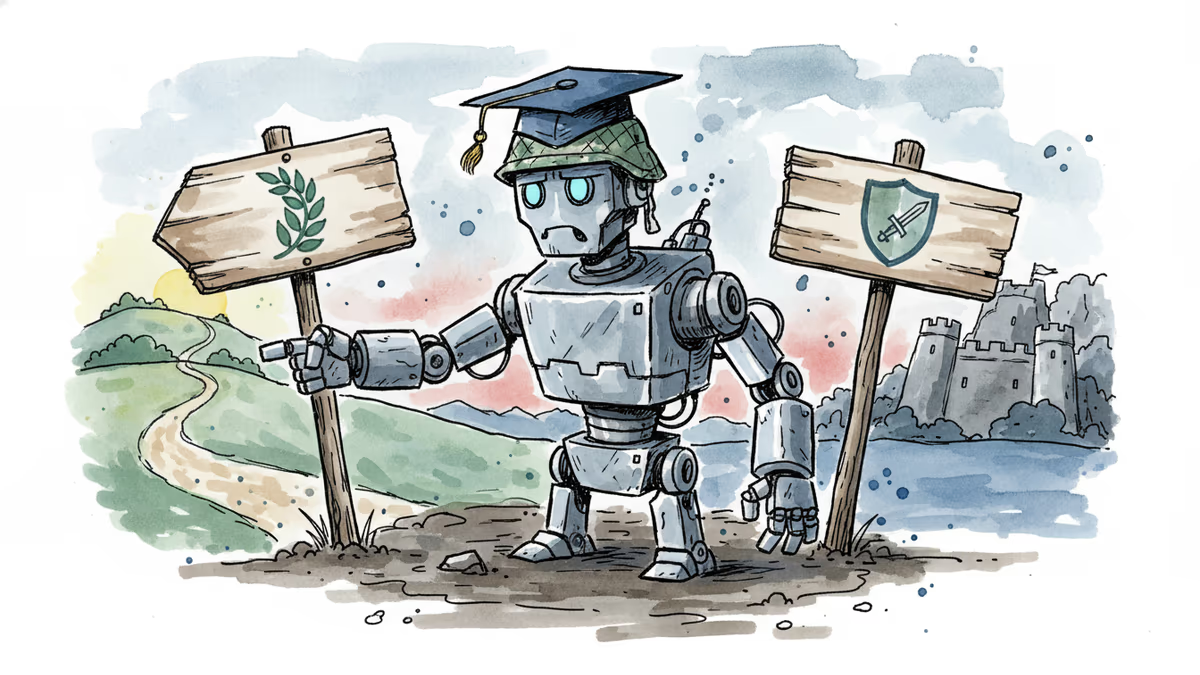

OpenAIが国防総省と契約、AI軍事利用の新時代が始まる

OpenAIが米国防総省との契約で多層防護システムを導入。AI軍事利用の倫理的境界線はどこにあるのか?日本の防衛産業への影響も分析。

「人工知能は戦争を変えるのか?」この問いが現実のものとなった。OpenAIが米国防総省との契約において、多層防護システムの詳細を初めて公開したのだ。

軍事AIの新たな境界線

OpenAIは従来、軍事利用に対して慎重な姿勢を取ってきた。しかし2024年から方針を転換し、「防御目的」に限定して国防総省との協力を開始している。今回公開された多層防護システムは、AI技術が軍事分野で悪用されることを防ぐための包括的な枠組みだ。

このシステムには3つの主要な防護層が含まれる。第一に、学習データの段階での厳格なフィルタリング。第二に、モデル出力のリアルタイム監視。第三に、人間による最終承認プロセスの義務化である。

特に注目すべきは、攻撃的な軍事行動への応用を明確に禁止している点だ。OpenAIのサム・アルトマンCEOは「我々の技術は盾であって剣ではない」と強調している。

日本への波及効果

日本の防衛産業にとって、この動きは重要な意味を持つ。三菱重工業や川崎重工業などの防衛関連企業は、すでにAI技術の軍事応用について研究を進めているが、今回のOpenAIの取り組みは新たな技術標準を示すものとなる可能性が高い。

日本政府も2023年に「防衛力強化に向けたAI活用戦略」を策定しており、サイバー防御や情報収集分野でのAI導入を加速させている。OpenAIの多層防護システムは、これらの取り組みにおける重要な参考事例となるだろう。

倫理的ジレンマの深層

しかし、この契約は新たな倫理的課題も浮き彫りにする。「防御目的」という定義の曖昧さが最大の争点だ。サイバー攻撃への対処は防御なのか、それとも攻撃なのか?予防的な軍事行動はどう位置づけられるのか?

MITの人工知能研究所は、「技術的な防護システムだけでは不十分」と指摘している。重要なのは、人間による判断と責任の所在を明確にすることだという。

国際的な視点では、中国やロシアがAI軍事技術の開発を加速させる中、西側諸国の対応は後手に回っているとの見方もある。OpenAIの今回の決定は、技術覇権競争における戦略的な意味合いも持っている。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

米国でAIへの否定的感情が高まっている。OpenAIのCEOへの襲撃事件、データセンター反対運動、世論調査での懸念増加が重なり、OpenAIやAnthropicのIPO計画や大手テック企業の巨額投資に影響を与える可能性がある。

Snapが全従業員の16%にあたる約1,000人の削減を発表。AIによる業務効率化を理由に掲げ、株価は8.6%上昇。日本企業はこの「AI人員削減」の波をどう受け止めるべきか。

流出文書により、イラン革命防衛隊(IRGC)が極秘でGPS誘導システムを取得し、2026年3月の戦争中の攻撃誘導に使用していたことが判明。中東の軍事バランスと日本の安全保障への影響を分析します。

ASMLが2026年の売上予測を上方修正。AI関連投資がチップ需要を押し上げる中、中国向け輸出規制という逆風も。日本企業や投資家への影響を多角的に分析します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加