CPUが「ボトルネック」に——AIが変えるチップの主役交代

エージェント型AIの台頭により、長年脇役だったCPUが突如主役に。NvidiaのGTC発表を前に、CPU市場は「静かな供給危機」に直面。日本企業への影響とは?

6ヶ月で前例のない需要増——AMDのデータセンター責任者がそう言い切るとき、業界に何かが起きていると考えていいでしょう。その「何か」は、私たちが想像していたよりも静かに、しかし確実に進行しています。

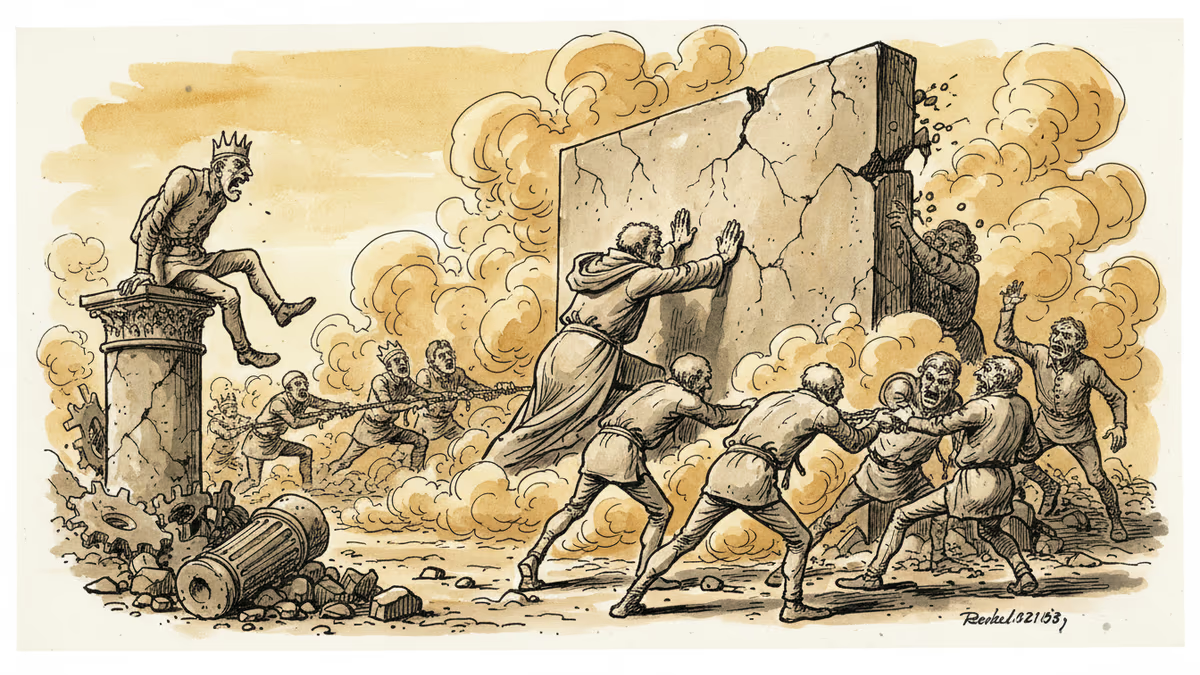

「脇役」が突然、主役になった理由

GPU(グラフィックス処理装置)が半導体業界の主役として君臨してきたここ数年、CPU(中央処理装置)はどこか影の存在でした。しかし今、その構図が変わりつつあります。

Nvidia のAIインフラ責任者、ディオン・ハリス氏はCNBCの取材に対し、「CPUはAIとエージェントワークフローを拡大する上でボトルネックになりつつある」と明言しました。同社は来週月曜日から始まる年次カンファレンス「GTC」において、エージェントAI向けに最適化された新たなCPUの詳細を発表する予定で、会場にはCPU単体のラックが展示される見通しです。

なぜ今、CPUなのか。その答えは「エージェントAI」という新しいパラダイムにあります。

これまでのAIは、ユーザーが質問し、AIが答えるという「問答型」でした。しかしエージェントAIは違います。自律的に複数のタスクを立案・実行し、複数のAIエージェントが連携しながら目標を達成する「仕事型」AIです。Nvidia のCEO、ジェンスン・フアン氏は先月の決算説明会で「エージェントシステムは複数のエージェントをチームとして生み出している。生成されるトークン数は本当に指数関数的に増えている」と述べ、「ワット当たりの最高パフォーマンスが文字通りすべてだ」と強調しました。

GPUが「多数の小さなコアで同時並行処理」を得意とするのに対し、CPUは「少数の強力なコアで逐次的・汎用的な処理」を担います。エージェントAIは、複数のエージェント間でデータを大量に移動させ、ワークフローを調整する必要があるため、まさにCPUが得意とする汎用的な演算能力を大量に必要とするのです。

「静かな供給危機」と市場の現実

市場調査会社The Futurum Groupは、この状況を「静かな供給危機(Quiet Supply Crisis)」と呼んでいます。同社は2028年までにCPU市場の成長率がGPUを上回る可能性があると予測。Bank of Americaは、CPU市場が2025年の270億ドルから2030年には600億ドルへと倍以上に拡大すると見込んでいます。

供給不足はすでに現実のものとなっています。AMD と Intel は中国の顧客に対して供給不足を警告しており(ロイター報道)、CPUの納期は最大6ヶ月、価格は10%以上上昇しています。チップアナリストのベン・バジャリン氏は「シリコンウェーハは木になるわけではない。10%多く収穫することはできない」と、供給制約の根本的な難しさを指摘します。

現在のサーバーCPU市場シェアは、Intel が60%、AMD が24.3%、Nvidia が6.2%(2025年第4四半期、Mercury Research推定)。残りはAmazonのGraviton、GoogleのAxion、MicrosoftのCobaltなど、ハイパースケーラー各社が自社開発したArm系プロセッサが占めています。

Nvidia 自身は2021年にデータセンター向けCPU「Grace」を発表し、次世代「Vera」が現在量産中です。今年2月には Meta のデータセンターでGrace CPUが単体で大規模導入される多年契約を締結。テキサス大学オースティン校の高度計算センターやロスアラモス国立研究所でも、スーパーコンピューターの電力を担っています。

「プラットフォーム非依存」という Nvidia の賭け

興味深いのは、Nvidia の戦略的な柔軟性です。同社は自社CPUをArmアーキテクチャで設計する一方、NVLinkネットワーク技術を第三者にライセンス供与し、Intel(x86)、Qualcomm、Fujitsu、Arm、さらにはRISC-Vを採用するSiFiveとも連携しています。

ハリス氏は「私たちはArmベースのCPUを構築しているが、x86コミュニティにも深く投資しており、エコシステム全体に投資している。どちらに転んでも強いポジションを持てる」と語ります。

これはGPUという「本業」を守りながら、CPU市場でも存在感を高める「保険」とも言える戦略です。クリエイティブ・ストラテジーズのバジャリン氏はこれを「スープからナッツまで(soup-to-nuts)」戦略と表現。「競争するためには、GPUを買うか何も買わないか、という選択肢だけでは不十分。多様なワークロードに対応するために製品を拡張するしかない」と分析します。

日本企業への影響:見えにくいが、確実なインパクト

日本の視点から考えると、この変化はどこに影響するでしょうか。

まず、日本の主要クラウドプロバイダーや大手製造業がAIインフラを増強する際、CPUの調達コストと納期が新たなリスク要因になります。すでに6ヶ月の納期遅延と10%超の価格上昇が報告されており、データセンター投資計画の見直しを迫られる企業が出てくる可能性があります。

次に、富士通 はNVLinkのライセンス契約を締結しており、独自のArmベースプロセッサ「A64FX」の後継開発においてNvidiaのエコシステムとの親和性を高める方向性が見えます。日本のスーパーコンピューター「富岳」を擁する理化学研究所も、次世代計算基盤の設計においてこのトレンドを無視できないでしょう。

さらに、少子高齢化で労働力不足が深刻な日本にとって、エージェントAIは「仮想労働力」として期待されています。しかしエージェントAIが本格普及するには、CPUを含む計算インフラの整備が前提条件です。インフラの供給制約は、日本のAI活用加速にとっての見えにくいブレーキになりかねません。

関連記事

マイクロソフト、アルファベット、メタ、アマゾンの4社が2026年第1四半期決算を発表。合計6500億ドルのAIインフラ投資が進行中。ビットコインマイナーや日本企業への影響を多角的に分析。

イランとの戦争でアブダビのデータセンターが被弾。Pure DCがGPU投資を一時停止。中東AI基盤整備の未来と日本企業への波及リスクを読み解く。

MetaがAmazonのGravitonチップを採用。年間売上高200億ドル超のAWSチップ事業が示す、AI半導体市場の新たな勢力図とは。日本企業への影響も含めて考察します。

米軍がイラン船舶を拿捕し、ホルムズ海峡の緊張が再燃。原油価格上昇と株式市場の下落が同時進行する中、日本経済・家計への波及効果を多角的に読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加