国防総省がAnthropicを「サプライチェーンリスク」指定、しかしClaude利用は継続可能

米国防総省がAI企業Anthropicを安全保障リスクに指定したにも関わらず、Microsoft、Google、AWSは非軍事用途でのClaude提供継続を表明。企業の技術倫理とビジネス継続性の新たな均衡点とは?

47%の企業がAI導入を加速させる中、思わぬ政治的リスクが浮上した。米国防総省がAnthropicを「サプライチェーンリスク」に正式指定したのだ。これは通常、中国やロシアなど外国の敵対勢力に適用される措置である。

拒否が招いた異例の指定

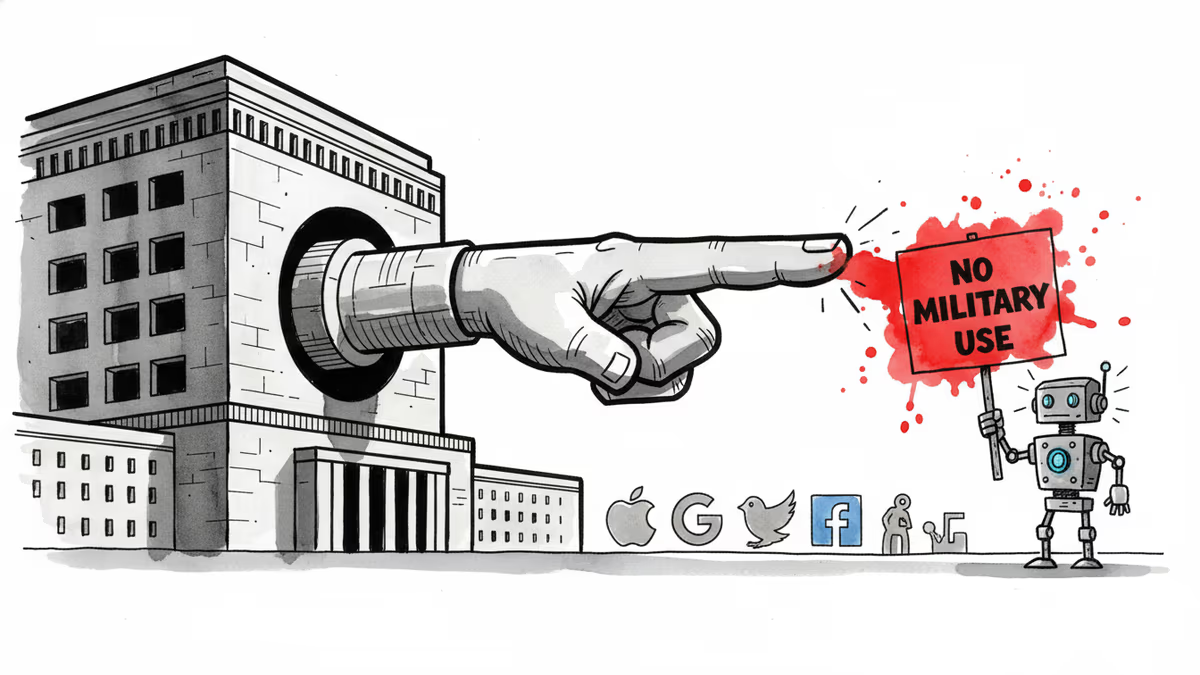

事の発端は、Anthropicが国防総省の要求を拒否したことだった。同省はClaudeへの無制限アクセスを求めたが、Anthropicは大規模監視や完全自律兵器など「AIが安全に支援できない用途」への利用を懸念し、これを断った。

結果として木曜日、国防総省は同社を供給網リスクに指定。これにより国防総省はClaudeの使用を段階的に停止し、国防総省と取引のある企業や機関はAnthropicのモデルを使用していないことを証明する必要が生じた。

大手テック企業の対応

Microsoftは最初に顧客への保証を表明した企業だ。同社の広報担当者は「弁護士がこの指定を検討した結果、Claudeを含むAnthropic製品は、国防総省以外の顧客に対してM365、GitHub、Microsoft AI Foundryなどのプラットフォームを通じて引き続き利用可能」と述べた。

Googleも同様の立場を示している。「この決定は、国防関連以外のプロジェクトでAnthropicと協力することを妨げるものではなく、彼らの製品はGoogle Cloudなどのプラットフォームを通じて引き続き利用可能」との声明を発表した。

AWSの顧客とパートナーも、非軍事用途でのClaude利用継続が可能だと報告されている。

企業倫理と現実的影響の狭間

AnthropicのCEOダリオ・アモデイ氏は法廷でこの指定と戦う意向を表明した。同氏は「この指定は国防総省との直接契約の一部としてClaudeを使用する顧客にのみ適用され、そのような契約を持つ全ての顧客の使用に適用されるわけではない」と説明している。

興味深いことに、国防総省の要求拒否後も、Claudeの一般消費者向け成長は続いている。これは企業が技術倫理を貫くことで、かえって市場での信頼を獲得する可能性を示唆している。

日本企業への示唆

日本企業にとって、この事例は重要な教訓を含んでいる。ソニーやトヨタ、任天堂など、グローバル展開する日本企業は、技術パートナーの選択において政治的リスクを考慮する必要性が高まっている。

特に、日本政府も防衛分野でのAI活用を検討する中、民間企業がどこまで協力すべきかという問題は避けて通れない。Anthropicの事例は、技術企業が軍事利用への明確な境界線を設けることの重要性を示している。

関連記事

AnthropicがOpus 4.8を公開。前作からわずか41日での更新は競争圧力の表れか。「不確実性を自ら報告する」設計思想が、企業AI活用の信頼基準を塗り替えようとしている。

産休・育休中にAIコーディングツールが普及し、復職後に「スキルギャップ」に直面する女性エンジニアたちの実態。技術変化が働く母親に与える不均衡な影響を多角的に分析する。

YouTubeが新AI機能「カスタムフィード」を発表。見たい動画をテキストで入力するだけで、パーソナライズされた専用フィードが生成される。この変化はコンテンツ消費の何を変えるのか。

ファーウェイ傘下HiSiliconが「タウのスケーリング則」という新設計思想を発表。米国の輸出規制を迂回する可能性を秘めた半導体戦略の全貌と、日本企業への影響を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加