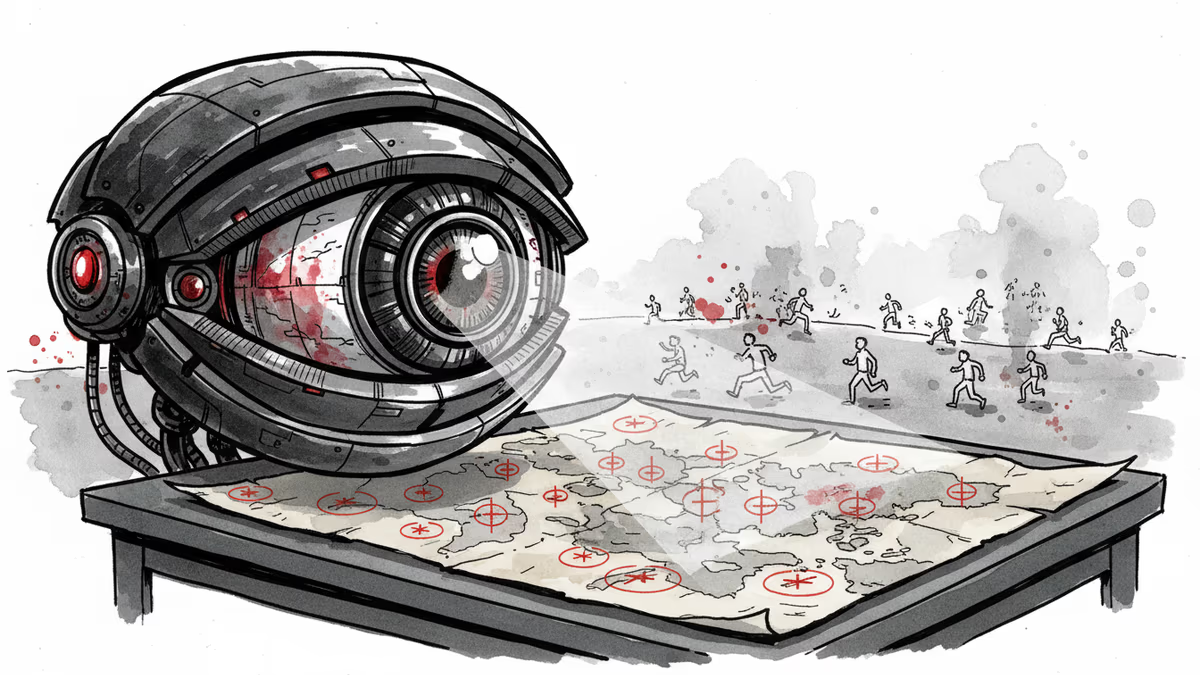

イスラエルのAI標的選定システム、ガザからイランへ展開

ガザで実戦テストされたイスラエルのAI兵器システムがイランでも使用され、人間の監督不足への懸念が高まっている

47%。これは、イスラエルがガザで行った空爆のうち、人工知能システムが標的を選定した割合だと専門家は推定している。そして今、この同じシステムがイランでも使用されているという報告が浮上し、国際社会に新たな懸念を呼んでいる。

ガザで実戦テストされたAI標的選定システム

イスラエル軍は、ガザ紛争において「Lavender」と呼ばれるAI標的選定システムを大規模に運用した。このシステムは、通信傍受、移動パターン分析、ソーシャルメディアの活動などから得られる大量のデータを処理し、攻撃対象を自動的に識別する。従来は軍事アナリストが何時間もかけて行っていた作業を、AIは数秒で完了する。

責任ある国家政策研究所(Quincy Institute)の上級副所長トリタ・パルシ氏は、「ガザでの爆撃とテヘランでの爆撃の類似点がますます強くなっている」と警告を発している。特に問題視されているのは、AI システムの判断に対する人間の監督が不十分だという点だ。

人間の監督なき自律兵器への懸念

軍事技術の専門家たちが最も懸念しているのは、AIシステムが標的を選定する際の「人間の最終判断」の欠如である。イスラエル軍の元情報将校によると、ガザでの作戦では、AI が選定した標的に対して軍事作戦員が平均20秒しか検証時間をかけていなかったという。

この状況は、国際人道法の根幹である「区別原則」—民間人と戦闘員を明確に区別する義務—に深刻な疑問を投げかけている。赤十字国際委員会は、「機械が生死を決定する権限を持つべきではない」との立場を堅持している。

日本への技術的・倫理的影響

日本の防衛産業界は、この動向を複雑な思いで見つめている。三菱重工業や川崎重工業などの企業は、AI技術の軍事応用について研究を進めているが、憲法第9条の制約と国際的な人道法の遵守という二重の課題に直面している。

日本政府は2023年に「AI戦略2023」を発表し、AI技術の平和利用を強調したが、同盟国であるアメリカとの技術協力の中で、軍事AI技術の開発圧力も高まっている。防衛省は、「人間が最終的な攻撃判断を行う」ことを前提とした AI 支援システムの研究を進めているが、イスラエルの事例は、その境界線の曖昧さを浮き彫りにしている。

国際社会の対応と規制の必要性

国連では、致命的自律兵器システム(LAWS)の規制に向けた議論が続いているが、主要軍事大国間の合意形成は難航している。アメリカ、中国、ロシア、そしてイスラエルは、完全な禁止措置には反対の立場を取っている。

一方、EUは2024年にAI規制法を施行し、軍事AIシステムにも一定の制約を課している。日本もG7の枠組みの中で、「責任あるAI開発」の原則を提唱しているが、具体的な規制措置はまだ策定されていない。

記者

関連記事

トランプ大統領がイランとの交渉に「まだ満足していない」と発言。ホルムズ海峡の封鎖継続と原油価格高騰が続く中、日本経済への影響と外交の行方を多角的に読み解く。

イスラエル軍がレバノン南部の約14%に相当する地域を「戦闘地帯」と宣言し、大規模な避難命令を発令。停戦合意後最大規模の軍事行動が中東情勢に与える影響を多角的に分析。

イスラエルがヒズボラへの攻撃を急激に強化。停戦合意後も続く交戦で31人が死亡し、中東の緊張が再び高まっている。その背景と国際社会への影響を読み解く。

イスラエルがハマス軍事部門の新司令官モハンマド・オデーをガザ市内の空爆で殺害。停戦合意下で続く攻撃が中東和平プロセスに何を意味するのか、多角的に考察します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加