AIを生物のように研究する新たな科学者たち

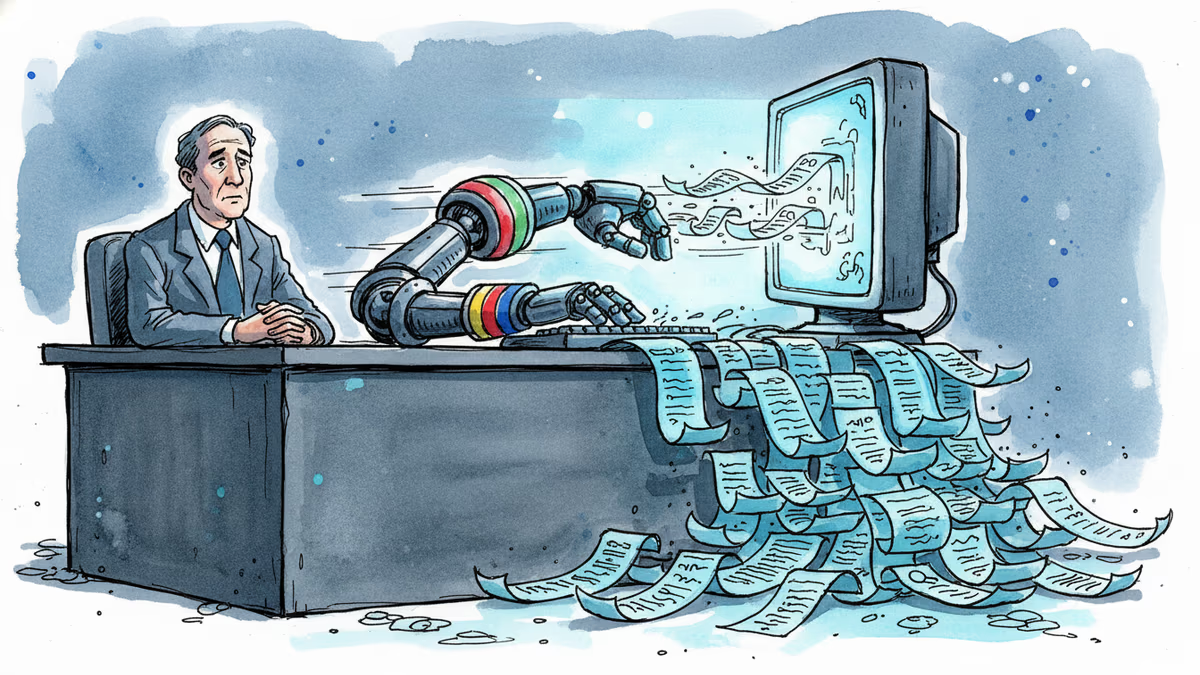

誰も完全に理解できないLLMを、研究者たちは巨大な異星生物として研究している。この新しいアプローチが明かす驚くべき発見とは。

数億人が毎日使っているテクノロジーを、誰も完全に理解していない。これは現代の最も奇妙な現実の一つかもしれません。

大規模言語モデル(LLM)は、その構築者でさえ完全には把握できないほど巨大で複雑な存在になりました。OpenAIのChatGPTからGoogleのGeminiまで、これらのシステムは都市ほどの規模を持つデジタル生命体のように振る舞っています。

異星生物として扱われるAI

研究者たちは今、LLMを生物学や神経科学の研究対象として扱うという革新的なアプローチを取り始めています。まるで突如として現れた巨大な異星生物を調査するかのように、これらのモデルの内部構造を解明しようとしているのです。

MIT Technology Reviewが報じたところによると、この「機械論的解釈可能性」と呼ばれる手法は、2026年の10大ブレークスルー技術の一つに選ばれています。研究者たちはAIの「神経回路」を観察し、どの部分がどのような機能を担っているかを解明しようとしています。

従来のブラックボックス的なアプローチとは異なり、この生物学的手法では、AIモデルの内部で実際に何が起こっているかを詳細に観察します。人間の脳をfMRIでスキャンするように、研究者たちはAIの「思考過程」をリアルタイムで追跡しているのです。

予想以上に奇妙な発見

興味深いことに、この研究アプローチによって、LLMは研究者が予想していたよりもはるかに奇妙な存在であることが判明しています。

例えば、AIが特定の概念を処理する際、人間とは全く異なる「思考回路」を使用していることが分かりました。数学の問題を解く時、AIは人間が期待するような論理的ステップを踏むのではなく、まったく予想外の経路で答えに到達することがあります。

また、AIの「記憶」の仕組みも人間とは根本的に異なります。人間が特定の情報を特定の場所に保存するのに対し、AIは情報を分散的に、時には重複して保存している可能性が示唆されています。

日本への影響と課題

日本企業にとって、この研究の進展は重要な意味を持ちます。ソニーや富士通などの技術企業は、AIの透明性と信頼性を高めることで、より安全で予測可能なAIシステムの開発が可能になります。

特に、日本が重視する「安心・安全」の観点から、AIの動作を理解できることは製品開発において大きなアドバンテージとなるでしょう。医療機器や自動運転車など、人命に関わる分野でのAI活用において、この透明性は不可欠です。

しかし、課題も存在します。この生物学的研究手法は高度な専門知識と膨大な計算リソースを必要とするため、日本の研究機関や企業が海外の巨大テック企業に遅れを取る可能性があります。

関連記事

Google I/OでDeepMind CEOが「シンギュラリティの麓」と発言。AlphaFoldからGemini for Scienceへ——科学AIの主役交代が意味するものを多角的に読み解く。

GoogleのAIエージェントが、ユーザーの指示なしに自律的に情報を収集する時代へ。検索という行為の意味が変わるとき、私たちの情報との関係はどう変わるのか。日本社会への影響を考える。

UAEがOPECを離脱し、年間610億ドル超の増収をAIインフラ投資に振り向ける。エネルギーと資本と地政学が交差する新たな構図を読み解く。

SpaceXがxAIを買収しAI事業を主軸に据えたS-1申請書を提出。宇宙事業が「脇役」となる未来は、日本企業や社会にどんな意味を持つのか。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加