トランプ政権、AI企業Anthropicを「サプライチェーンリスク」指定

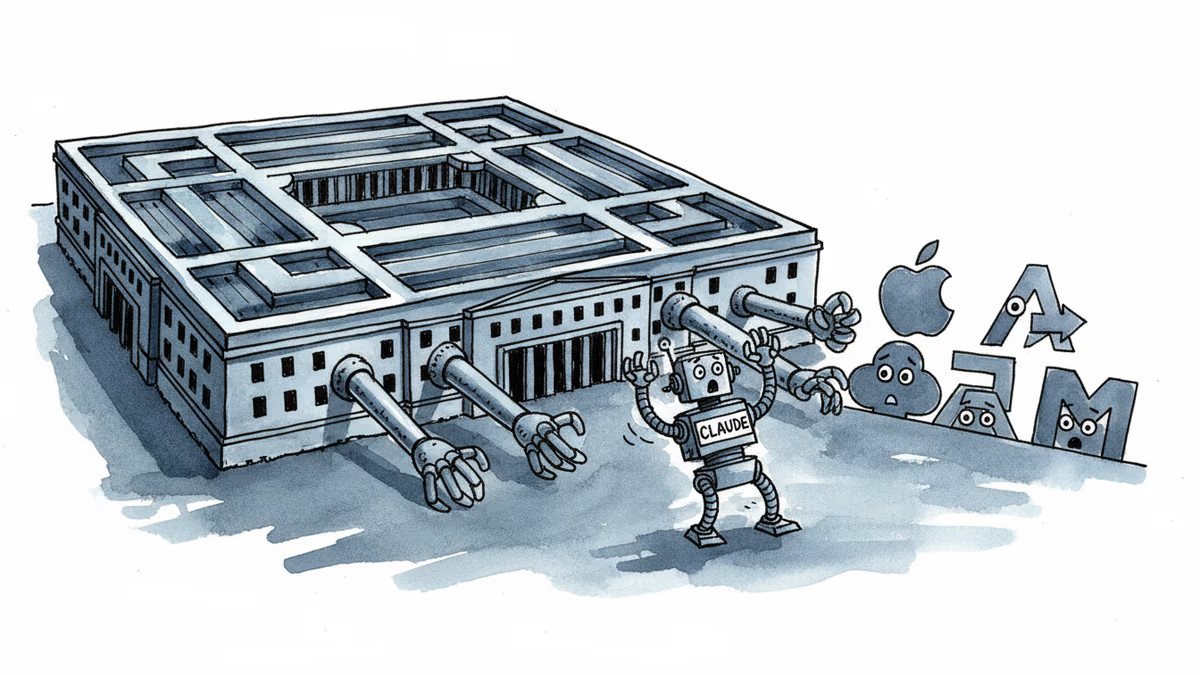

米国防総省がAI企業Anthropicを供給網リスクと指定。PalantirやAWSなど大手企業への影響が懸念される中、AI安全保障の新局面が始まった。

2時間という短い間隔で、米国の対AI政策が劇的に転換した。トランプ大統領がTruth SocialでAnthropic製品の連邦政府使用禁止を発表した直後、ピート・ヘグセス国防長官は同社を「サプライチェーンリスク」として正式指定したのだ。

何が起こったのか

今回の決定は、AI企業Anthropicとその主力製品である対話AI「Claude」を標的としている。同社はOpenAIと並ぶ生成AI分野の有力企業として知られ、多くの企業や政府機関がその技術を活用していた。

国防総省の「サプライチェーンリスク」指定は、単なる使用禁止を超えた意味を持つ。これは、国家安全保障に関わる調達において、該当企業との取引を制限する強力な措置だ。

影響を受ける可能性が高いのは、国防総省との契約でClaude技術を使用している大手企業群だ。データ分析大手のPalantirや、クラウドサービスのAWS(Amazon Web Services)など、多くの主要テック企業が対象となる可能性がある。

企業への波及効果

問題の複雑さは、影響範囲の不透明さにある。国防総省は、国家安全保障以外の分野でClaude技術を使用する企業をどこまで「ブラックリスト」に載せるかを明確にしていない。

Palantirのような企業にとって、これは深刻な問題だ。同社は政府機関向けデータ分析で収益の大部分を上げており、AI技術の選択が事業継続に直結する。一方でAWSは、民間向けサービスでClaude技術を提供しているが、政府契約への影響は未知数だ。

日本企業への影響も無視できない。米国政府との取引を持つソニー、富士通、NECなどの技術企業は、自社のAI戦略の見直しを迫られる可能性がある。特に防衛関連技術を扱う企業にとって、米国の安全保障政策は事業戦略の重要な要素となる。

AI安全保障の新段階

この動きは、AI技術をめぐる地政学的競争が新たな段階に入ったことを示している。従来、技術規制は主に中国企業を対象としていたが、今回は米国発のAI企業が標的となった点が注目される。

背景には、生成AI技術の急速な発展と、それに伴う安全保障上の懸念がある。大規模言語モデルは、情報分析、意思決定支援、さらには軍事作戦の計画立案にまで応用される可能性があり、その制御権は国家戦略上極めて重要だ。

日本政府も、この動向を注視している。経済安全保障の観点から、重要技術の供給網管理は喫緊の課題だ。今回の米国の決定は、日本のAI政策にも影響を与える可能性が高い。

関連記事

米国防総省が確認:敵対勢力が商業的位置情報データを使い、戦場の米軍兵士を追跡・監視。広告テクノロジー産業が「国家安全保障上の脅威」として問われ始めた。

産休・育休中にAIコーディングツールが普及し、復職後に「スキルギャップ」に直面する女性エンジニアたちの実態。技術変化が働く母親に与える不均衡な影響を多角的に分析する。

YouTubeが新AI機能「カスタムフィード」を発表。見たい動画をテキストで入力するだけで、パーソナライズされた専用フィードが生成される。この変化はコンテンツ消費の何を変えるのか。

ファーウェイ傘下HiSiliconが「タウのスケーリング則」という新設計思想を発表。米国の輸出規制を迂回する可能性を秘めた半導体戦略の全貌と、日本企業への影響を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加