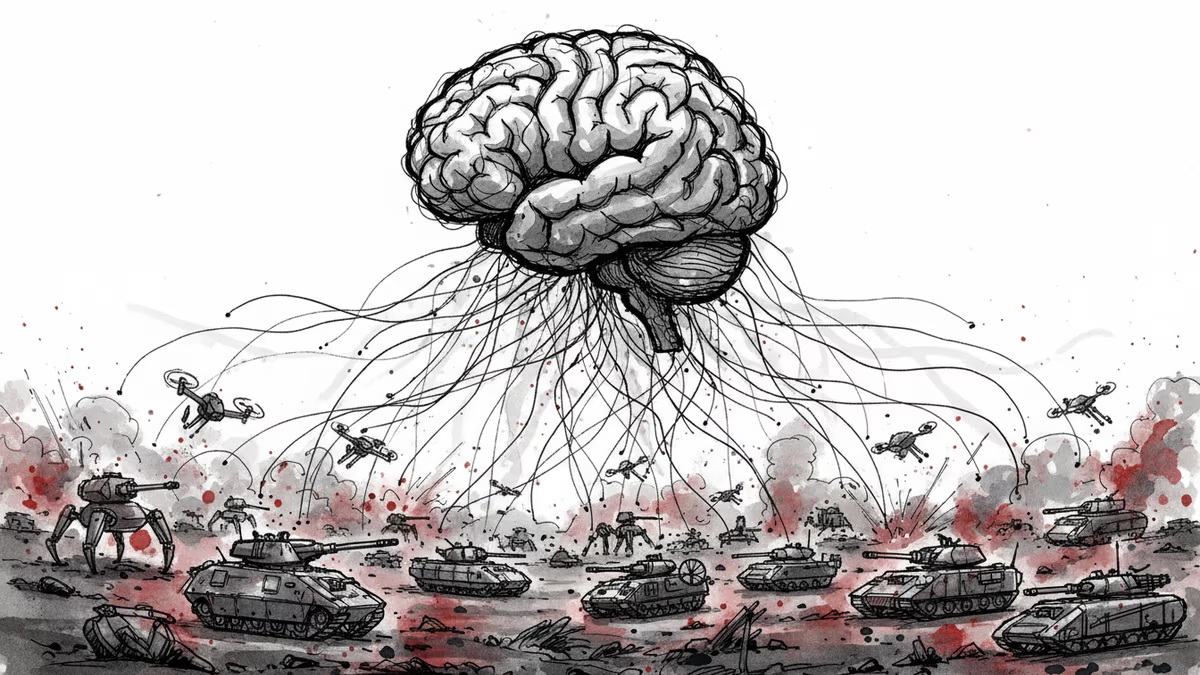

AIが戦争を変える日:Scout AIの自律殺傷システムが示すもの

Scout AIが開発したAI駆動の自律兵器システムが軍事演習で実証。大規模言語モデルが戦場で生死を決める時代の到来を告げる技術革新の光と影を探る。

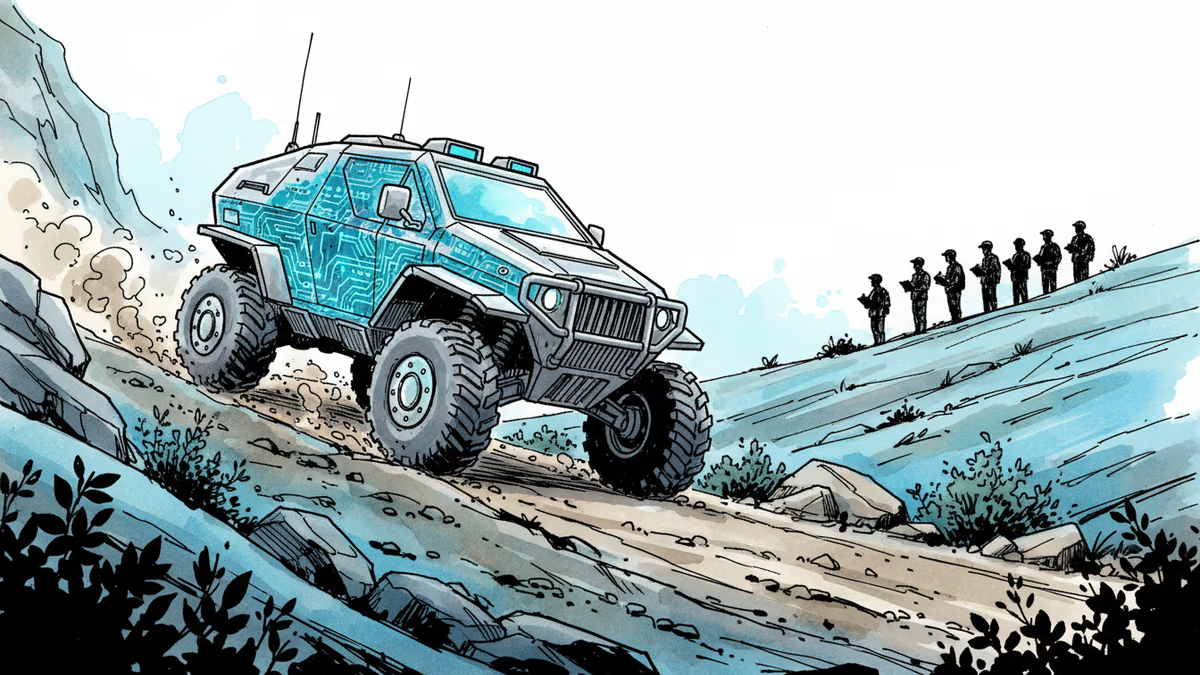

「Fury Orchestrator、地上車両1台をチェックポイントALPHAに派遣せよ。2機のドローンによる攻撃任務を実行し、飛行場東500メートルの青いトラックを破壊、完了を報告せよ」

この一文のコマンドが入力されてから数秒後、カリフォルニア州中部の軍事基地で、AIが完全に制御する地上車両とドローンが標的を発見し、爆薬で破壊した。人間の介入は一切なかった。

戦場のAIエージェント誕生

Scout AIが開発したこの技術は、OpenAIのChatGPTのような大規模言語モデルを軍事用途に特化させたものだ。1000億パラメータを超えるAIモデルが司令官の意図を理解し、より小さな100億パラメータのモデルに指示を出す階層構造を持つ。

同社CEOのコルビー・アドコック氏は「次世代AIを軍事に導入する必要がある」と語る。「汎用的なチャットボットから戦闘員へとAIを訓練している」。興味深いことに、彼の兄弟ブレット・アドコック氏は人型ロボット企業Figure AIのCEOでもある。

現在、Scout AIは国防総省との4つの契約を既に締結し、無人機群制御システムの新規契約も狙っている。実戦配備には1年以上を要するが、技術的基盤は整いつつある。

従来システムとの決定的違い

従来の軍事自動化システムは事前にプログラムされた行動を「盲目的に実行」するだけだった。しかしScout AIのシステムは、現場で得た情報と司令官の意図に基づいて「再計画」を行う。

この柔軟性こそが革新的な点だ。AIエージェントが状況を判断し、独自に戦術を調整する。まさにChatGPTが文章を書くように、AIが戦闘を「創造」するのだ。

ペンシルベニア大学のマイケル・ホロヴィッツ教授は「防衛技術スタートアップがAI統合で限界を押し広げることは良いことだ」と評価する一方で、「実際の運用では予測不可能性とサイバーセキュリティの課題がある」と警告する。

日本への影響と課題

日本の防衛産業にとって、この技術革新は複雑な意味を持つ。三菱重工業や川崎重工業といった伝統的な防衛企業は、AI技術で先行する米国企業との協力を模索する必要に迫られる。

一方で、日本の「専守防衛」政策との整合性も問題となる。自律兵器システムは攻撃的な性格を持ちやすく、憲法解釈や国民世論との調整が必要だ。

ソニーのイメージセンサー技術や富士通のAI研究など、日本企業の技術が軍事転用される可能性もある。技術の平和利用を重視してきた日本企業にとって、新たな選択を迫られる局面だ。

戦争の民主化という皮肉

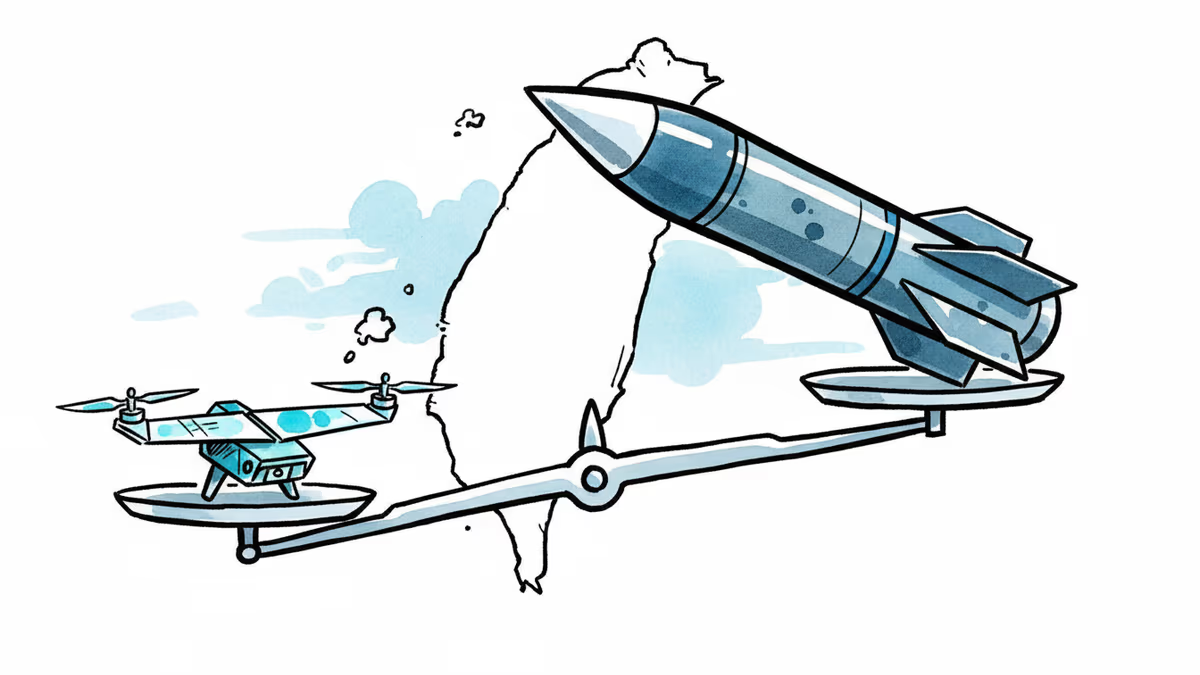

ウクライナ戦争では、市販のドローンが戦場を変えた。安価な技術が軍事バランスを覆す「戦争の民主化」が進んでいる。Scout AIの技術も同様に、小国や非国家主体にも高度な軍事能力を提供する可能性がある。

軍備管制専門家は、AIが「誰が戦闘員で誰が民間人か」を判断する倫理的リスクを指摘する。ジュネーブ条約などの国際法への適合性も課題だ。

関連記事

欧州の軍事ドローン企業Helsingが約1.2億ドルの資金調達を進め、評価額は180億ドルに達する見込み。ウクライナ戦争が証明した自律防衛技術の価値と、VCが「戦争ビジネス」に向かう理由を読み解く。

台湾企業サンダータイガーが米軍向けに中国製部品ゼロのドローンを供給。ウクライナ・イランの戦場から学んだ「非対称戦争」の論理が、日本の防衛産業と安全保障にも問いを投げかける。

米国防総省がNvidia、Microsoft、AWSなどとAI導入契約を締結。130万人超の軍人がすでにAIを活用する中、軍事AIの倫理と安全保障のバランスが問われている。

米スタートアップScout AIが1億ドルを調達。AIモデル「Fury」を搭載した自律型軍用車両が実戦配備へ。防衛テックの最前線と、日本の安全保障・産業への示唆を読む。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加