AIを「信頼」できるか?問うべき問いが違う

メディア界の大物バリー・ディラー氏がWSJカンファレンスで語った。AI開発者への信頼より、誰も答えを知らない「未知の結果」こそが本当のリスクだと。AGI時代の本質的な問いを考える。

「信頼できるかどうか」——それは、実は問うべき問いではないのかもしれない。

メディア界の重鎮、バリー・ディラー氏がウォール・ストリート・ジャーナル主催「Future of Everything」カンファレンスで発した言葉は、AI論争の焦点を静かにずらした。Fox Broadcastingの共同創業者であり、IACおよびExpedia Groupの会長を務める同氏は、OpenAIのCEO サム・アルトマン氏を「誠実で、良い価値観を持つ人物」と評した。しかし、それはむしろ前置きに過ぎなかった。

「彼らも知らない」——開発者自身の驚き

アルトマン氏をめぐっては、元同僚や元取締役から「操作的」「欺瞞的」との批判が相次いでいた。ディラー氏はそうした人物評論に加わるのではなく、より根本的な問いを提示した。「AIにおける大きな問題のひとつは、信頼をはるかに超えたところにある。信頼が無関係になるかもしれない。なぜなら、起きていることが、それを起こしている人々自身にとっても驚きだからだ」

同氏はAI開発の最前線にいる人々と多くの時間を過ごしてきたと語り、こう続けた。「彼らは自分たちでも驚いている。だから……これは大いなる未知だ。私たちも知らない。彼らも知らない」

これは単なる謙遜ではない。AI研究の現場では実際に、大規模言語モデルが予期せぬ能力を「創発」する現象が繰り返し報告されている。開発者がシステムを設計しても、そのシステムが何を「学習」し、どんな能力を獲得するかは、事前には完全に予測できない。ディラー氏の言葉はその現実を、業界外の視点から鋭く言語化したものだ。

AGIという「一方通行の扉」

ディラー氏が特に警戒を示したのは、AGI(人工汎用知能)の到来だ。AGIとは、あらゆる知的タスクにおいて人間を凌駕しうる理論上のAIを指す。「私たちはほぼそこに近づいている。まだ到達してはいないが、ますます速く、ますます近くなっている。ガードレールについて考えなければならない」と同氏は述べた。

そして、より鋭い警告を加えた。もし人間がガードレールを設けなければ、「別の力——AGIという力が、自分たちでそれをやるだろう。そしてそれが起きたら、一度解き放てば、後戻りはない」

「後戻りはない」という表現は、技術的な不可逆性を示す。核兵器の登場が軍事的均衡を永久に変えたように、AGIの出現は人間社会の意思決定構造そのものを変えうる——そうした含意がある。

日本社会にとって、この問いはどんな意味を持つか

日本は今、少子高齢化と労働力不足という構造的課題に直面している。政府はAIやロボット技術の導入を積極的に推進しており、トヨタやソニー、NTTといった大企業も生成AIの業務活用を加速させている。この文脈でAIへの期待は大きい。

しかし、ディラー氏の指摘は別の問いを投げかける。日本社会が「信頼できるAI企業」を選ぶことに注力している間に、そもそも誰も制御できない段階に技術が進んでいるとしたら? 労働力不足を補うために導入したシステムが、やがて「補助」ではなく「主導」になる転換点は、どこにあるのか。

日本では「人間と機械の協調」という概念が文化的に受け入れられやすい土壌がある。しかしその「協調」が成立するのは、人間側がまだ主導権を持っている間だけだ。ディラー氏の言う「ガードレール」の設計は、技術企業だけでなく、社会全体——政策立案者、倫理研究者、そして市民——が参加すべき課題だという点は、日本においても例外ではない。

「善意の開発者」論の限界

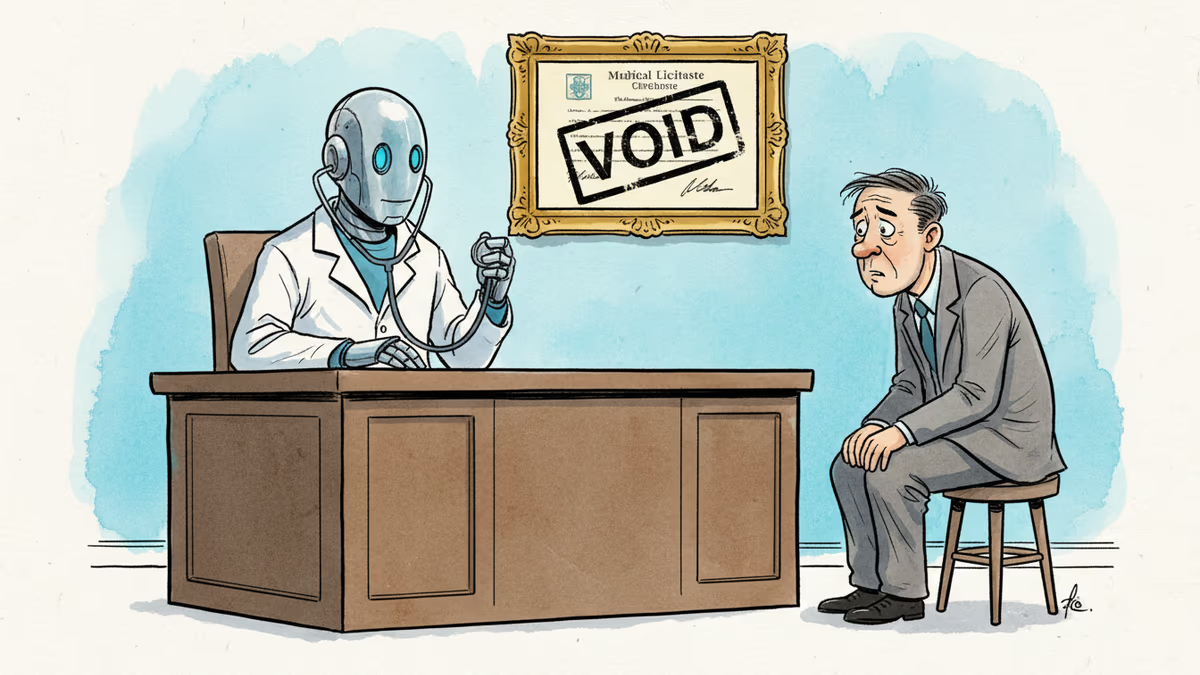

ディラー氏の発言で最も示唆に富むのは、「良い人が率いていても問題は解決しない」という論点だ。アルトマン氏を信頼するかどうかに関わらず、問題の本質は人格ではなく構造にある。

これは技術ガバナンスの議論において重要な視点だ。規制の議論がしばしば「誰を信頼するか」という人物論に収束しがちな中、ディラー氏は「信頼に依存しないシステム設計」の必要性を示唆している。民主主義が「善良な指導者への依存」ではなく「制度的チェック」によって機能するように、AIガバナンスもまた、個人の誠実さに委ねるだけでは不十分だという考え方だ。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

イーロン・マスクがOpenAIをテスラに吸収しようとしていた計画が法廷で明らかに。マスク対オルトマン裁判が示す、AI覇権争いの深層と非営利組織の限界とは。

イーロン・マスクとサム・オルトマンの裁判で証言したシボン・ジリス。彼女の立場が照らし出すのは、シリコンバレーの権力構造と個人的関係の曖昧な境界線だ。

マイクロソフトが2030年の時間単位クリーンエネルギー目標の見直しを内部で検討中。AI データセンターの急拡大が環境公約と正面衝突している実態を多角的に分析します。

ペンシルベニア州がCharacter.AIを提訴。AIチャットボットが医師を偽ったとされる事件は、日本のAI規制や医療AIの信頼性にも深く関わる問題を提起している。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加