アンソロピック、トランプ政権を相手取り法的措置へ

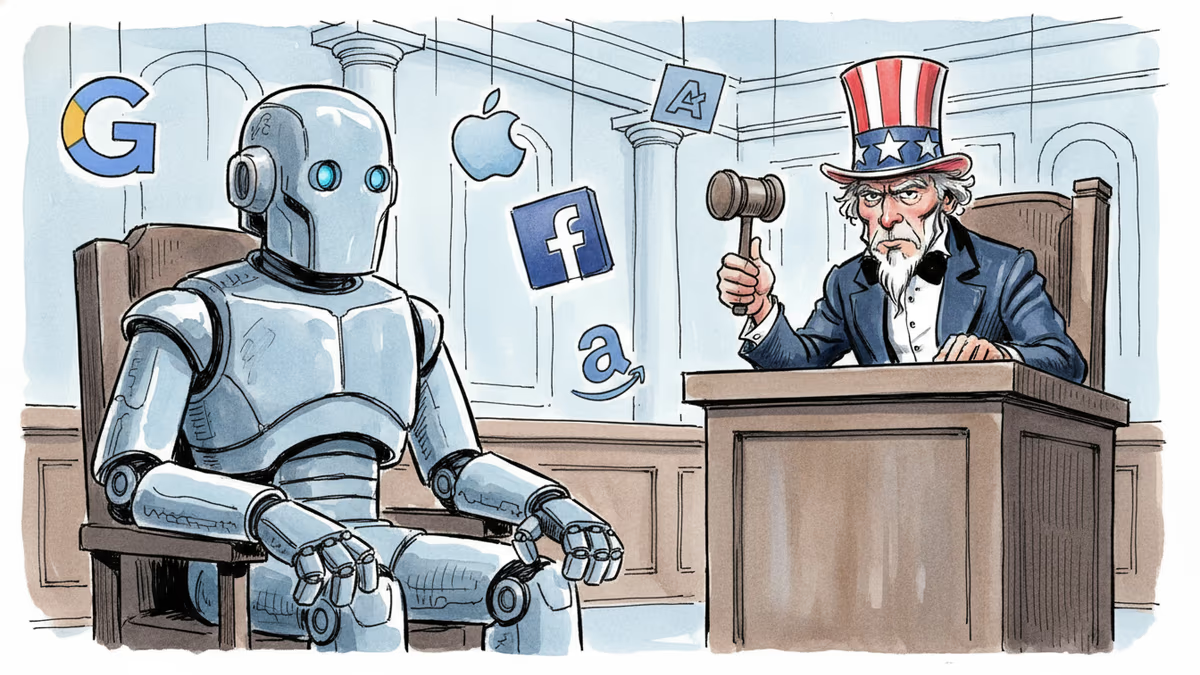

AI安全性重視のアンソロピックが国家安全保障リスクと認定され、法的対応を検討。AI規制と企業自由度の新たな対立軸が浮上。

2026年、AI安全性で名高いアンソロピックが、まさかの「国家安全保障リスク」認定を受けた。同社は近くトランプ政権を相手取って法的措置を講じる方針を発表している。

突然の方針転換

アンソロピックは、これまで業界でも特に慎重なAI開発姿勢で知られてきた。同社のClaudeは、安全性を最優先に設計されており、むしろ他社よりも保守的なアプローチを取っていたはずだった。

しかし、トランプ政権は新たな国家安全保障指針の下で、同社を「リスク企業」として分類。具体的な理由は明らかにされていないが、政府関係者は「AI技術の軍事転用可能性」と「外国勢力との関係性」を挙げている。

アンソロピック側は「根拠なき認定」として強く反発。同社は85億ドルの企業価値を持つAI分野の有力企業で、GoogleやAmazonからも巨額投資を受けている。

日本企業への波紋

興味深いことに、この動きは日本のAI関連企業にも影響を与えている。ソニーやトヨタなど、アンソロピックと技術提携を検討していた日本企業は、現在関係見直しを迫られている状況だ。

日本政府も微妙な立場に置かれている。米国との同盟関係を重視する一方で、AI技術の自主性確保も重要な課題となっているからだ。経済産業省関係者は「個別企業への見解は控える」としながらも、「AI分野での日本の自立性確保」の重要性を強調している。

規制と革新のバランス

この事件は、AI規制をめぐる根本的な問題を浮き彫りにしている。安全性を重視すればするほど、かえって政府の警戒を招くという皮肉な状況だ。

他のAI企業も注視している。OpenAIやMetaなど、より積極的な開発姿勢を取る企業が今回の認定を免れているのは偶然だろうか。それとも、政府にとって「予測可能な企業」の方が安心なのだろうか。

関連記事

トランプ大統領がイランへの軍事行動再開を検討する中、国家安全保障補佐官が離脱。外交と軍事の狭間で揺れるホワイトハウスの内実を読み解く。

マスク氏とオープンAI創業者ブロックマン氏の証言が真っ向から対立。慈善団体の「乗っ取り」か、正当な企業進化か。シリコンバレー最大の法廷劇が問いかけるAI企業統治の本質。

米商務省傘下のCAISIがGoogle DeepMind、Microsoft、xAIとAI事前評価協定を締結。ホワイトハウスも新たなAIワーキンググループ設立を検討中。日本企業と国際社会への影響を読む。

イーロン・マスクとサム・アルトマンが法廷で激突。OpenAIの非営利から営利への転換をめぐる世紀の裁判が示す、AI産業の本質的矛盾とは何か。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加