AI防衛利用を巡る攻防:ペンタゴンとAnthropic、期限迫る

米国防総省がAI企業Anthropicに軍事利用への協力を迫る中、技術企業の社会的責任と国家安全保障の境界線が問われている。日本企業にとっても重要な示唆を持つ事例を分析。

金曜日の午後まで。それが、AI企業Anthropicと米国防総省に残された時間だった。

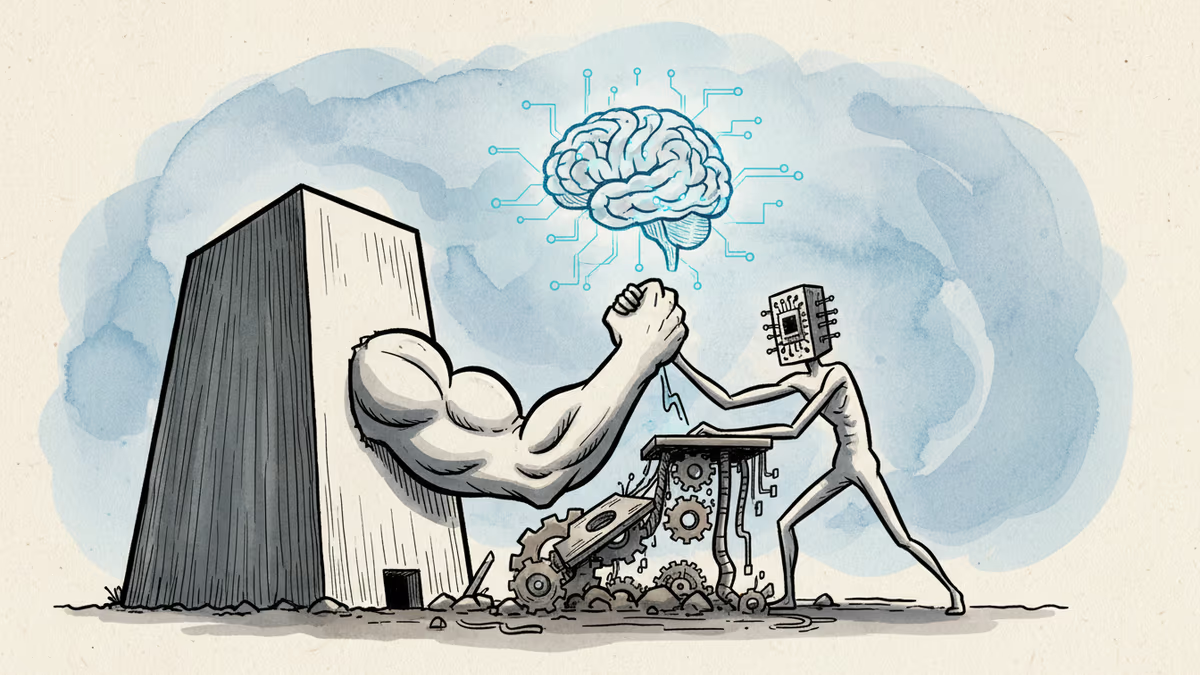

対立の核心:技術と倫理の狭間で

今週、国防総省はAnthropicに対し、同社のAIモデル「Claude」への無制限アクセスを要求する最後通牒を突きつけた。Claudeは現在市場で最も強力なAIの一つとされ、Grokなどの競合製品を上回る性能を持つとされている。

一方、Anthropic側は譲歩の条件として、自社のAIが米国民の大規模監視や人間の監視なしに作動する自律兵器に使用されないという保証を求めている。これは単なる技術提供の問題を超え、AI時代における企業の社会的責任という根本的な問いを投げかけている。

国防総省はAnthropicを「サプライチェーンリスク」として分類し、政府契約の剥奪を示唆している。さらに、国防生産法の発動も検討されており、これが実現すれば政府が同社のAI技術を強制的に接収することも可能になる。

矛盾する戦略:必要性と排除の間で

しかし、専門家たちはトランプ政権のアプローチに矛盾を指摘している。Anthropicをサプライチェーンリスクとして分類すれば、政府はその製品を使用できなくなる。一方で国防生産法を発動するということは、同社のAIモデルが国家安全保障に不可欠だと認めることになる。

この矛盾は、AI技術の軍事利用における政策の一貫性の欠如を浮き彫りにしている。NvidiaのCEOジェンセン・フアン氏は「交渉による解決を望むが、決裂しても世界の終わりではない」とコメントし、業界全体がこの対立の行方を注視していることを示している。

安全性重視からの転換点

興味深いことに、Anthropicは火曜日に「安全性第一」の方針を緩和し、競争力向上のためにAIモデルの制約を緩めると発表した。同社CEOダリオ・アモデイ氏はこれまで、AI製品の規制の必要性を訴えてきただけに、この方針転換は業界に大きな波紋を投げかけている。

日本への示唆:技術主権と倫理の両立

この対立は、日本の技術企業にとっても重要な示唆を持つ。ソニー、富士通、NECなどの日本企業も、AI技術の軍事転用や政府との関係において、同様の判断を迫られる可能性がある。

特に、日本政府が進める「経済安全保障」政策の下で、技術企業がどこまで政府の要求に応じるべきか、という問題は避けて通れない。日本特有の「和」を重んじる文化と、グローバルな技術倫理基準の間で、企業はどのような立場を取るべきだろうか。

関連記事

トランプ大統領がイランへの軍事行動再開を検討する中、国家安全保障補佐官が離脱。外交と軍事の狭間で揺れるホワイトハウスの内実を読み解く。

米インド太平洋軍司令官が議会で証言。米軍がビットコインネットワーク上でノードを運用中と初めて公式に認めた。中国との戦略的競争における暗号資産の役割とは。

米軍F-15E撃墜後、Polymarketが救出賭けを削除。予測市場の規制論争が激化する中、「情報と賭け」の危険な交差点を読み解く。

OpenAIが米国防総省と契約を締結。ライバルのAnthropicが「国家安全保障上のリスク」として排除された直後の動きは、AI企業の倫理と国家安全保障の間にある深い亀裂を露わにしています。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加