AI防衛契約の暗闘:「安全第一」か「軍事優先」か

AnthropicとOpenAIの国防総省契約をめぐる対立が浮き彫りにした、AI企業の価値観と軍事利用の境界線について考察

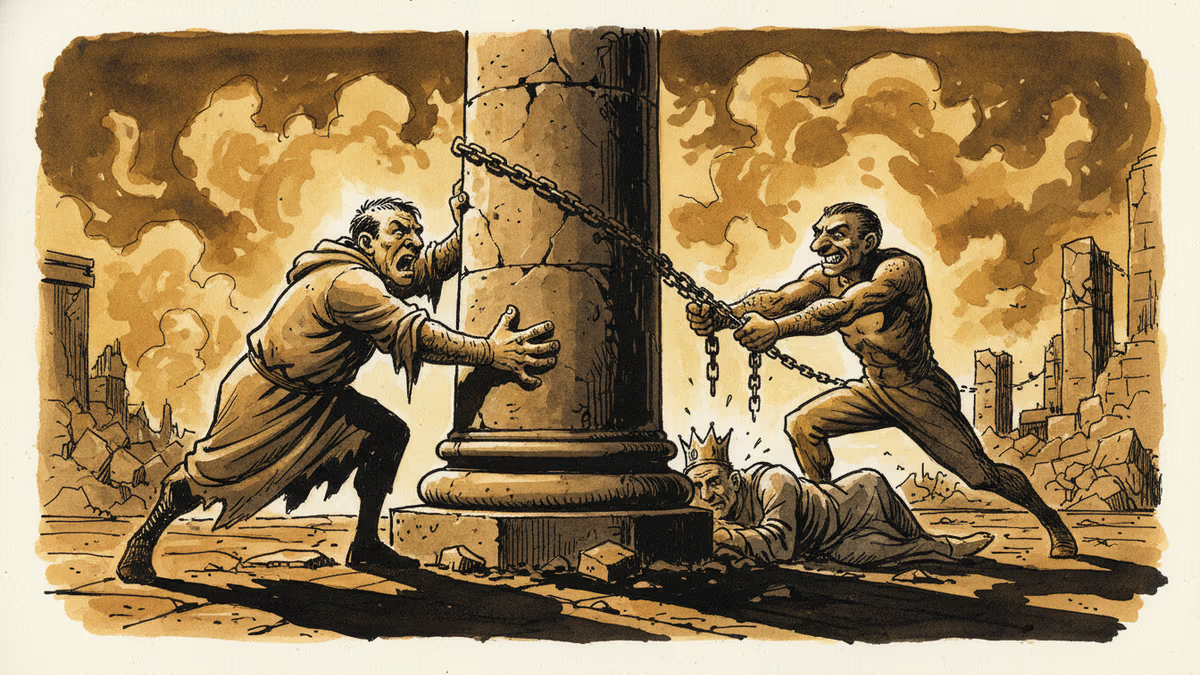

2億ドルの契約が一夜にして破談となり、CEOが「嘘つき」と罵倒される。これは単なる商談の決裂ではない。AI時代における企業の価値観と国家安全保障の衝突を象徴する出来事だ。

48時間で起きた劇的な展開

AnthropicのCEOダリオ・アモデイ氏と米国防総省の交渉が金曜日に決裂した後、わずか数時間で状況は一変した。トランプ大統領は連邦機関にAnthropicのツール使用停止を指示し、国防長官は同社をサプライチェーンリスクに指定すると発表。一方でOpenAIは同日、国防総省との新契約を発表した。

しかし週末を挟んで、アモデイ氏は国防総省研究技術担当次官エミル・マイケル氏との再交渉のテーブルに戻った。この急転直下の展開は、AI企業と軍事部門の関係がいかに複雑で政治的かを物語っている。

交渉決裂の核心は、「大量取得データの分析」という一文にあった。Financial Timesが入手した社内メモによると、アモデイ氏は「この文言こそ我々が最も懸念していたシナリオと完全に一致する」と述べている。

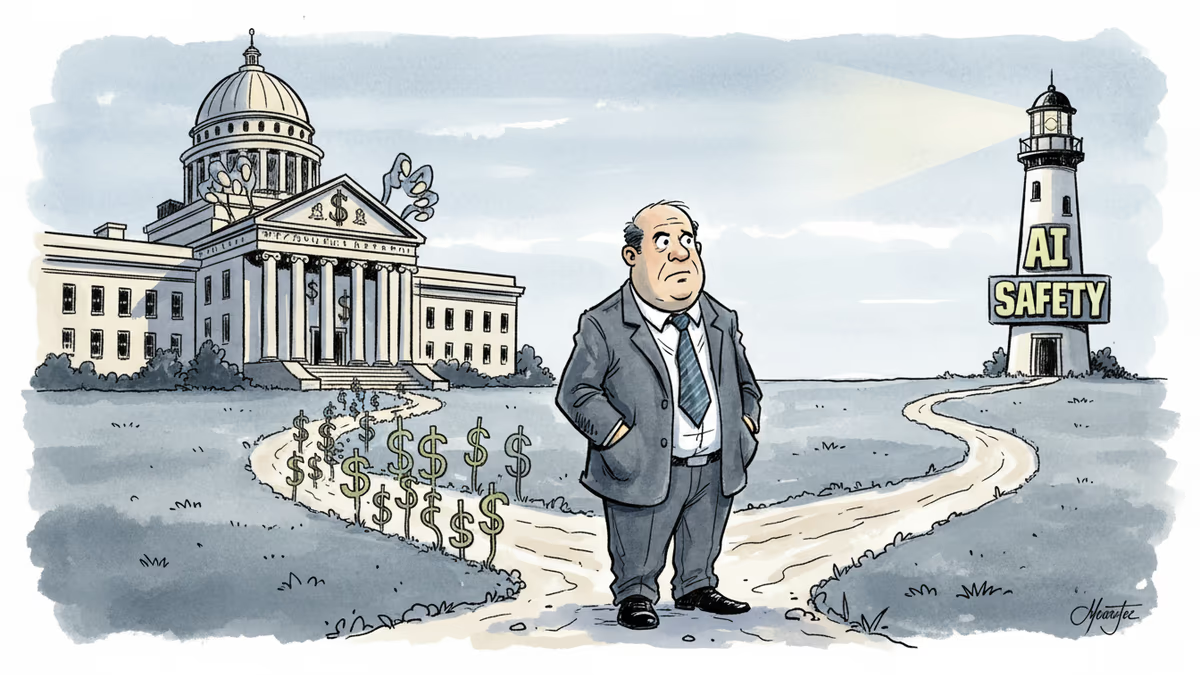

対照的な二つの道

今回の騒動は、AI業界の二つの哲学を鮮明に浮き彫りにした。

Anthropicの立場は明確だ。2021年にOpenAIの元スタッフらが「安全第一」を掲げて設立した同社は、自社のClaude AIが国内監視や自律兵器に使用されないよう保証を求めた。特に「大量取得データの分析」の削除を要求したのは、プライバシー侵害への懸念からだった。

一方、OpenAIの対応は対照的だった。同社はAnthropicの交渉決裂と同じ日に国防総省との契約を発表。しかし批判を受けて、CEOサム・アルトマン氏は「急ぎすぎた」と認め、安全措置の見直しを約束した。さらに「Anthropicはサプライチェーンリスクに指定されるべきではない」と擁護する姿勢も見せた。

日本企業への示唆

この対立は、日本のテック企業にとって重要な示唆を含んでいる。ソニーやトヨタなど、グローバル展開する日本企業も、いずれ同様の選択を迫られる可能性がある。

政府関係者は数ヶ月間、AnthropicがAI安全性を過度に重視していると批判してきた。しかし、日本社会の価値観を考えると、「安全第一」のアプローチは必ずしも否定的に受け取られないだろう。むしろ、長期的な信頼構築において優位に働く可能性もある。

NVIDIA、Google、Anthropicを含む業界団体が国防長官に送った抗議書簡も、企業の集団的な意思表示として注目に値する。日本企業も、個別の判断だけでなく、業界全体での連携を考える必要があるかもしれない。

関連記事

SKハイニックスが時価総額1兆ドルを突破。サムスン電子に続き韓国勢2社が同時に1兆ドルクラブ入り。AI半導体需要がコスピ指数を牽引する構造的変化と、日本市場への影響を読み解く。

6月8日開幕のWWDC 2026を前に、AppleとGoogleの提携によるSiri刷新への期待が高まる。株価は8週連続で上昇し最高値圏に。AI戦略の転換が投資家と利用者に何をもたらすか。

AIが量子コンピュータの開発を加速させ、現在のブロックチェーンやインターネットの暗号化技術が近い将来破られる可能性が高まっている。日本企業と個人にとっての意味を深く掘り下げる。

中国の人型ロボット訓練センターでは、元美術教師が工場作業をロボットに教えている。北京が国家戦略として推進するヒューマノイドロボット産業の実態と、日本社会への示唆を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加