AI企業と国防の境界線:アンソロピック制裁が示す新たなジレンマ

アンソロピックが米国防総省との契約交渉で制裁を受けた事件から、AI技術の軍事利用と企業倫理の複雑な関係を探る

47%。これは昨年、AI企業が国防関連契約を獲得した割合だ。しかし今、その数字の裏で起きている複雑な駆け引きが、一つの企業を政府のブラックリストに載せることになった。

交渉決裂の舞台裏

アンソロピックと米国防総省の契約交渉は、AI技術の軍事利用をめぐる現代の新たな戦場となった。この交渉で、アンソロピックは二つの明確な条件を提示した:完全自律兵器への使用禁止、そして米国民に対する国内大規模監視への使用禁止。

一方、国防総省は「すべての合法的な用途」での使用を求めた。この表現の背後には、軍事作戦の機密性と柔軟性を重視する国防当局の姿勢が透けて見える。

交渉が膠着状態に陥る中、アンソロピックのダリオ・アモデイCEOは「良心に従って」これらの条件下での技術提供を拒否すると表明した。その結果、トランプ大統領は全政府機関に同社技術の使用停止を命令し、ピート・ヘグセス国防長官は同社を「国家安全保障に対するサプライチェーンリスク」と指定した。

競合他社の対照的な選択

興味深いことに、OpenAIは同様の交渉で異なる道を選んだ。サム・アルトマンCEOは国防総省との合意に達したと発表したが、その後「急ぎすぎた」「日和見的で粗雑に見えた」と自社の判断を振り返った。

OpenAIは後に契約条件を修正し、「AIシステムは米国人および米国民の国内監視に意図的に使用されない」という文言を明記した。この修正は、アンソロピックの懸念が決して杞憂ではなかったことを示している。

規制当局の視点

連邦通信委員会のブレンダン・カー委員長は、アンソロピックの判断を「間違い」と断じた。「国防総省と契約するすべての技術に適用される明確なルールが存在する」と述べ、同社に「可能な限り軌道修正を試みる」よう促した。

しかし、この発言は新たな疑問を提起する。AI技術の特殊性を考慮した「明確なルール」は本当に存在するのだろうか。

日本企業への示唆

この事件は日本のAI企業にとって重要な教訓を含んでいる。ソニー、富士通、NECといった日本企業も、将来的に同様の選択を迫られる可能性がある。特に日本は米国との安全保障協力を深めており、AI技術の軍事転用問題は避けて通れない課題となっている。

日本企業の多くは「技術の平和利用」を企業理念に掲げているが、グローバルな競争環境では、より複雑な判断が求められるかもしれない。

倫理と競争力のバランス

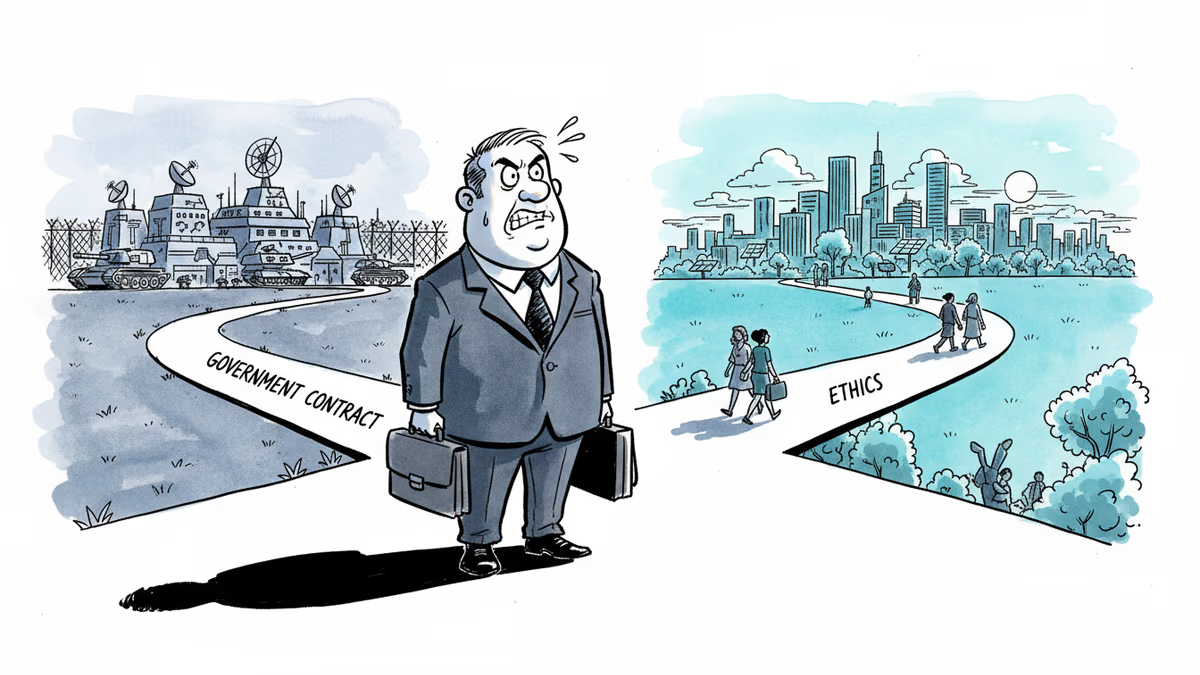

アンソロピックの選択は、AI企業が直面する根本的なジレンマを浮き彫りにした。倫理的な原則を貫くことで市場機会を失うリスクと、妥協することで長期的な信頼を損なうリスクのバランスをどう取るべきか。

同社は「危険な先例を作る」と政府の対応を批判したが、一方で政府側は国家安全保障の観点から企業の協力を当然視している。この溝は簡単には埋まりそうにない。

関連記事

マイクロソフトが2025年に設立したTrusted Technology Groupの取り組みを通じ、AI開発における責任とスピードのトレードオフ、障害者包摂の意義を多角的に考察します。

Metaが今週2件の裁判で敗訴。自社の内部研究が証拠として使われた。AI時代に企業は「知ること」のリスクとどう向き合うべきか。日本企業への示唆も含めて考える。

OpenAIが米国防総省と契約を締結。ライバルのAnthropicが「国家安全保障上のリスク」として排除された直後の動きは、AI企業の倫理と国家安全保障の間にある深い亀裂を露わにしています。

OpenAIのロボティクス部門責任者が、同社がペンタゴンと軍事AI契約を結んだ直後に辞任。AI倫理と商業化の間で揺れる企業の内部矛盾が浮き彫りに。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加