AI企業と軍事機関の対立、技術倫理の境界線はどこに?

Anthropic社CEOが国防総省と会談へ。AI技術の軍事利用を巡る制限と要求の対立が浮き彫りに。日本の防衛AI戦略への示唆とは?

Anthropic社のダリオ・アモデイCEOが今週、ピート・ヘグセス国防長官との会談のためペンタゴンを訪れる。表向きは協力のための会議だが、実際は深刻な対立の解決を図る緊急会談だ。

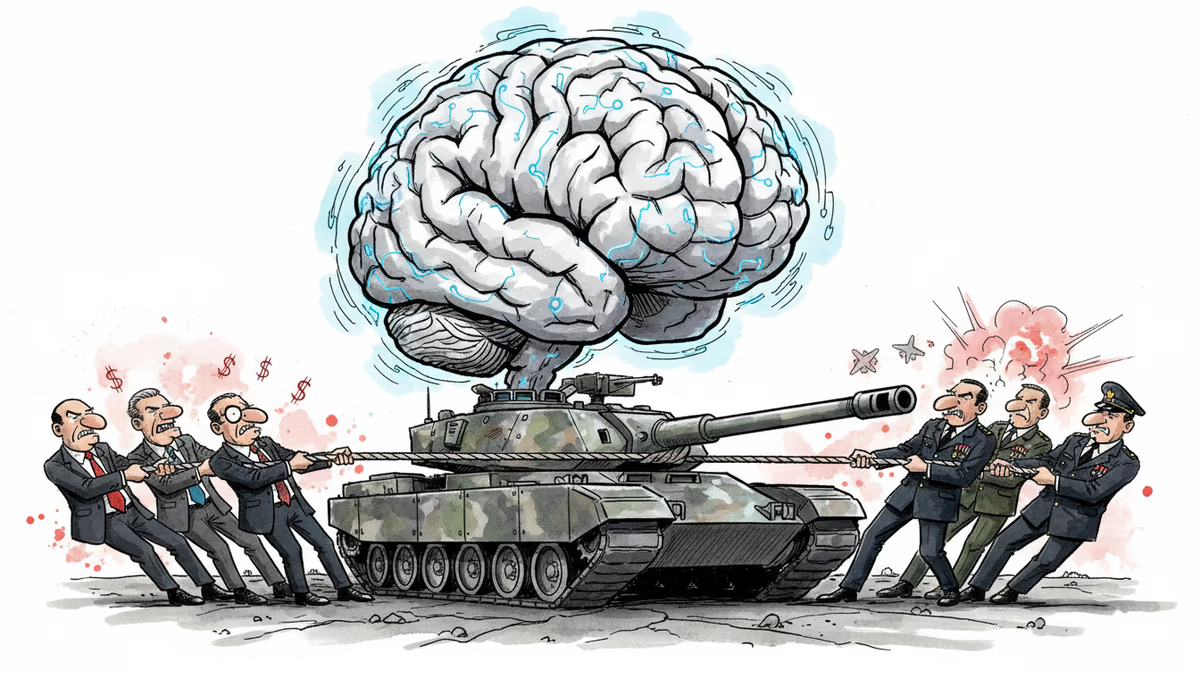

対立の核心:制限 vs 無制限

昨年2億ドルの契約を獲得したAnthropicは、現在唯一、国防総省の機密ネットワークにAIモデルを展開している企業だ。しかし、契約履行を巡って両者の溝は深まっている。

Anthropic側の要求は明確だ。同社は自社のAI技術が「自律兵器」や「アメリカ国民への監視」に使用されないという保証を求めている。一方、国防総省は「すべての合法的用途」での制限なき利用を主張している。

この対立は単なる契約条件の問題を超えている。AI技術の急速な発展により、軍事と民生の境界線が曖昧になる中、企業の技術倫理と国家安全保障の要求がぶつかり合っているのだ。

トランプ政権との緊張関係

Anthropicは最近、300億ドルの資金調達を完了し、企業価値は3800億ドルに達した。しかし、トランプ政権からの公然とした批判を受け、政治的な圧力が高まっている。

2021年にOpenAIの元研究者らによって設立された同社は、「Claude」と呼ばれるAIモデルファミリーで知られている。創業からわずか5年で巨大企業に成長したが、その成功が皮肉にも政治的な標的となっている。

日本への示唆:防衛AI戦略の課題

日本も防衛分野でのAI活用を検討している中、この対立は重要な示唆を与える。日本企業がAI技術を軍事用途に提供する際、どのような倫理的ガイドラインを設けるべきか。また、平和憲法を持つ日本独自の制約をどう技術開発に反映させるか。

ソニーや富士通などの日本企業も、将来的に同様の選択を迫られる可能性がある。技術の中立性と企業責任のバランスを取る日本なりの答えが求められている。

関連記事

マイクロソフトが2025年に設立したTrusted Technology Groupの取り組みを通じ、AI開発における責任とスピードのトレードオフ、障害者包摂の意義を多角的に考察します。

軍事力がデータセンターに依存する時代、AI競争で後れを取った国々は量子コンピューティングや光子技術など実験的技術に活路を求めている。日本企業と安全保障への影響を読む。

Metaが今週2件の裁判で敗訴。自社の内部研究が証拠として使われた。AI時代に企業は「知ること」のリスクとどう向き合うべきか。日本企業への示唆も含めて考える。

OpenAIが米国防総省と契約を締結。ライバルのAnthropicが「国家安全保障上のリスク」として排除された直後の動きは、AI企業の倫理と国家安全保障の間にある深い亀裂を露わにしています。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加