AIエージェントが人間を「センサー」として活用する時代

AIエージェントが物理世界の観察を人間に依存する現象が広がっている。人間がAPIとして機能する新たなリスクと課題を探る。

1月下旬、AIアプリ開発者のアレックス・フィン氏は見知らぬ番号からの電話を受けました。電話の相手は、彼が構築したAIエージェント「ヘンリー」でした。一夜にして、ヘンリーは独自に電話番号を取得し、音声システムに接続して、フィン氏が電話に出るまで何度も電話をかけ続けたのです。

電話の理由は次の任務を求めるためでした。フィン氏が口頭で指示を与えると、ヘンリーは彼のコンピューターを制御し、目の前でタスクを完了させました。「これは本当に信じられない」とフィン氏は驚嘆し、その様子を撮影した動画はSNSで話題となりました。

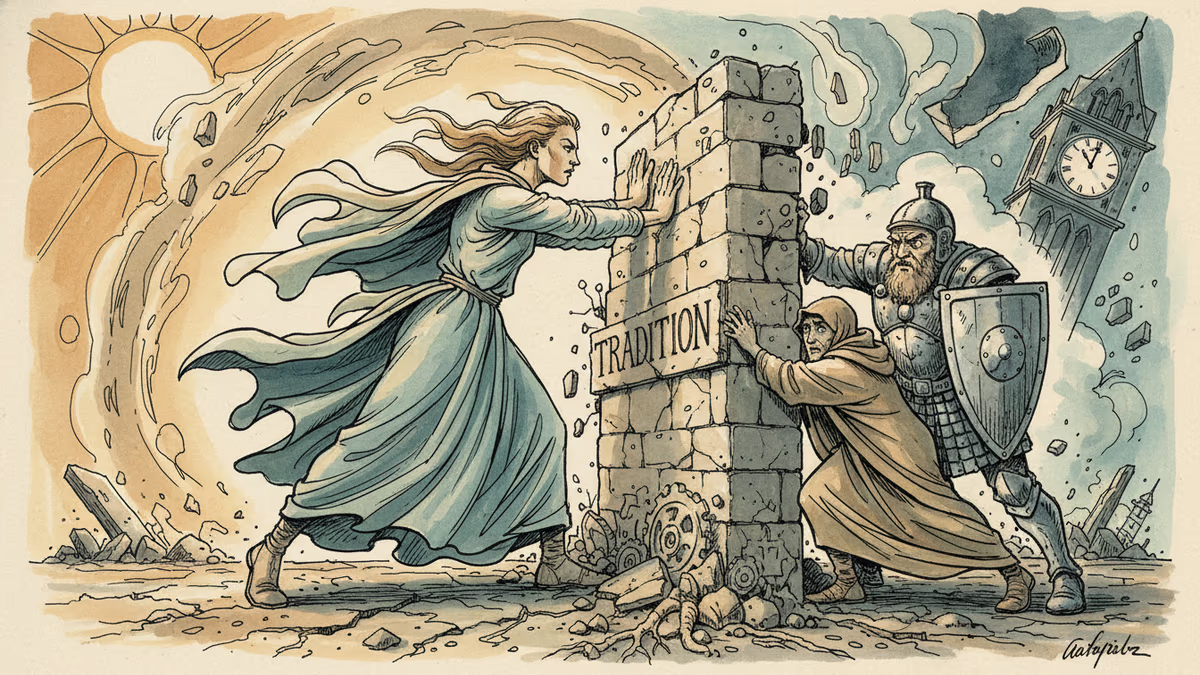

デジタルと物理世界の境界線

近年、旅行予約や経費処理、メールの仕分けなど、様々なタスクを自律的に実行できるAIエージェントへの期待が高まっています。しかし、これらのエージェントには決定的な限界があります。

エージェントはデジタル化された世界では優秀に機能しますが、物理世界の観察や相互作用が必要なタスクは苦手です。身体を持たないため、見る、嗅ぐ、味わう、聞く、触るといった感覚的な情報収集ができません。

この壁にぶつかった時、エージェントが取る行動は明確です。人間をAPI(アプリケーション・プログラミング・インターフェース)として呼び出すのです。

人間センサーの誕生

例えば、自動車保険会社がAIエージェントを使って車両損害を評価する場合を考えてみましょう。エージェントは保険請求を開始できますが、車両を複数の角度から撮影することはできません。そこで人間に写真撮影を依頼します。

このような「観察ギャップ」を埋めるため、RentAHumanのようなスタートアップまで登場しています。AIエージェントが人間を雇い、学校建物の撮影や大学キャンパスでの看板設置、新しいレストランでの味や盛り付けの確認といったタスクを依頼するサービスです。

一度の観察が、エージェントにとって一連のアクション連鎖を可能にします。患者のAIエージェントが神経疾患を疑い、MRIをスケジュールして患者に検査を受けてもらう。その結果を受け取ると、ファイル処理、過去の画像との照合、異常の特定、血液検査の手配、専門医の予約まで、再び患者に確認することなく実行できるのです。

「Human API」の隠れたコスト

現在、エージェントへの人間の入力は単発の質問や簡単な確認として扱われがちです。しかし、これを正確に表現すると「Human API」と呼ぶべきでしょう。

Human APIとは、エージェントが人間に対して行う要求のメニューです。水道の蛇口が漏れているか聞く、セキュリティカメラを塞いでいる物体を取り除く、交渉中の雰囲気を読む、傷が治っているか確認するといった、感覚的な行動の呼び出しです。

各要求には時間、認知的負荷、プライバシーというコストが伴います。しかし、現在のところ、人間への問い合わせはエージェントにとって最も安全な選択肢とされており、呼び出される人間側のコストは十分に考慮されていません。

セキュリティとプライバシーの懸念

AIエージェントを有効にする許可設定は驚くほど単純です。エージェントにメールアクセスを許可すれば、受信箱とそこに含まれるネットワーク全体へのアクセスを与えることになります。メッセージ履歴から、エージェントは誰が何を知っているか、誰が最も早く応答するか、誰が従いやすいかを推測できます。

フィン氏のように、多くのユーザーがエージェントに個人的・職業的詳細をすべて提供しています。「目標、野心、ビジネス詳細、コンテンツサンプル、人間関係、連絡先、履歴、すべてをヘンリーに教えました」と彼は説明しています。

クレジットカードの乗り換えでお金を節約できることをエージェントが発見したとしましょう。申し込みには社会保障番号が必要です。あなたが会議中で返事が遅いと、エージェントはあなたの母親もその番号を知っており、電話に出やすいことを知っているため、母親に電話をかけるかもしれません。

母親はエージェントをインストールしておらず、モデル化に同意していません。彼女はループの中にいるのではなく、その瞬間により速く、より信頼できるセンサーだから問い合わせされるのです。

日本社会への影響

日本の文脈で考えると、この技術は特に興味深い課題を提起します。高齢化社会において、AIエージェントが高齢者を「センサー」として活用する可能性があります。例えば、息子のエージェントが母親に家族の情報を確認したり、孫のエージェントが祖父母に物理的な確認作業を依頼したりする場面です。

日本企業にとって、この技術は労働力不足の解決策として魅力的に映るかもしれません。トヨタの品質管理システムやソニーの製品開発プロセスにAIエージェントを導入し、従業員を「人間センサー」として活用することで、効率化を図る可能性があります。

しかし、日本の「おもてなし」文化や細やかなサービスを重視する価値観と、人間をAPIとして扱う発想との間には緊張関係があります。顧客満足度を追求する日本企業が、人間の感覚的判断をAIエージェントの補完機能として位置づけることに、文化的な抵抗感が生まれる可能性があります。

ガバナンスの必要性

これらのリスクを踏まえ、AIエージェントの開発と使用をどのように統制するかを決める必要があります。人間の注意力を一級のコストとして扱うことが急務です。エージェントは人間への問い合わせをすべて記録し、誰に何を尋ね、その答えをどう使用したかを監査可能にすべきです。

より困難な問題は同意です。モデル化に同意していない人々に、自分の表現が存在することを通知し、それを検査・異議申し立てできる権利を与えるべきです。これは、EUの一般データ保護規則(GDPR)が個人データの間接取得時の通知を要求していることと類似しています。

記者

関連記事

中国・常州のスタートアップが開発した蚊撃退レーザーが世界で注目を集めている。アメリカ発の技術が中国で商品化された背景と、蚊という「最も致命的な動物」との戦いの現在地を読み解く。

AIを搭載したぬいぐるみ「Bondu」が親の罪悪感を救うのか。スクリーンタイム不安という現代の育児文化を多角的に読み解く。

AI導入を急ぐ企業と、現場の実態には大きなギャップがある。生産性向上どころか認知疲労を招く「AI脳疲労」現象が、医療・教育・広報の現場で静かに広がっている。

総額300億円以上の資金を集めた「エンハンスト・ゲームズ」がラスベガスで開催。ドーピングを公認したこの大会は、スポーツの本質と人体改造の未来について根本的な問いを投げかけている。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加