軍用AI新創獲3200萬美元融資,搶攻Anthropic退出的國防市場

前海軍陸戰隊指揮官創立的Smack Technologies開發軍事專用AI,在Anthropic與國防部合約破局後,軍用AI市場出現新機會

當Anthropic因為拒絕軍用而與美國國防部的2億美元合約破局時,一家名為Smack Technologies的新創公司卻反其道而行,專門開發軍事作戰AI,並剛完成3200萬美元的融資。

退役軍官的AI野心

Smack Technologies的CEO Andy Markoff並非典型的AI高管,而是前美國海軍陸戰隊特種作戰司令部指揮官,曾在伊拉克和阿富汗執行高風險特種作戰。他與同為退役海軍陸戰隊員的Clint Alanis,以及Tinder前技術副總裁Dan Gould共同創立這家公司。

「當你在軍中服役時,你宣誓要光榮、合法地服務,遵守戰爭法則,」Markoff說道。「對我來說,部署技術並確保其道德使用的人,需要穿著軍服。」

這種觀點與Anthropic的立場形成鮮明對比。當國防部長Pete Hegseth將Anthropic列為「供應鏈風險」後,軍用AI市場出現了新的機會空間。

專業化vs通用化的較量

Smack的AI模型採用類似Google AlphaGo的試錯學習方式,透過各種戰爭遊戲場景訓練,由專業分析師提供回饋信號,教導模型識別最佳作戰計劃。

Markoff強調,現有的大型語言模型並未針對軍用優化。「Claude這樣的通用模型擅長摘要報告,但它們沒有接受軍事數據訓練,缺乏對物理世界的人類級理解,不適合控制實體硬體。」

目前的軍事任務規劃仍大多依賴「白板和記事本」的手工作業,Smack的AI旨在自動化這些繁瑣的規劃工作。如果美國與中國或俄羅斯等「近似對等」國家發生戰爭,自動化決策可能提供美國急需的「決策優勢」。

自主武器的現實與爭議

事實上,美國和30多個國家已經部署了不同程度的自主武器系統,包括需要超人反應速度的飛彈防禦系統。里奇蒙大學法學院的Rebecca Crootof教授指出,「美國和其他30多個國家已經部署了具有不同自主程度的武器系統,包括一些我會定義為完全自主的系統。」

然而,AI軍用的可靠性仍存疑問。倫敦國王學院的一項實驗顯示,LLM在戰爭遊戲中傾向於升級核衝突,這個結果令人警惕。

生命未來研究所的Anna Hehir批評:「AI太不可靠、不可預測且無法解釋,不能用於如此高風險的場景。這些系統無法識別誰是戰鬥人員、誰是兒童,更別說識別投降行為。」

戰場現實的複雜性

即使是支持軍用AI的Markoff也承認限制的必要性。「我在現實世界中執行的作戰,沒有一次能按計劃進行50%以上,這種情況不會改變。」

這種坦率反映了戰場環境的混沌本質,也暗示了完全自主武器系統面臨的根本挑戰。

相关文章

Anduril與Meta聯手打造軍用AR眼鏡,目標是讓士兵用眼神和語音指揮無人機攻擊。合約金額逾百億美元,供應鏈刻意排除中國企業。這場技術競賽背後,藏著什麼地緣政治邏輯?

專為電商企業服務的金融科技新創Parker申請破產清算。超過2億美元的融資、6500萬美元的營收,為何仍難逃倒閉命運?這對亞洲金融科技生態意味著什麼?

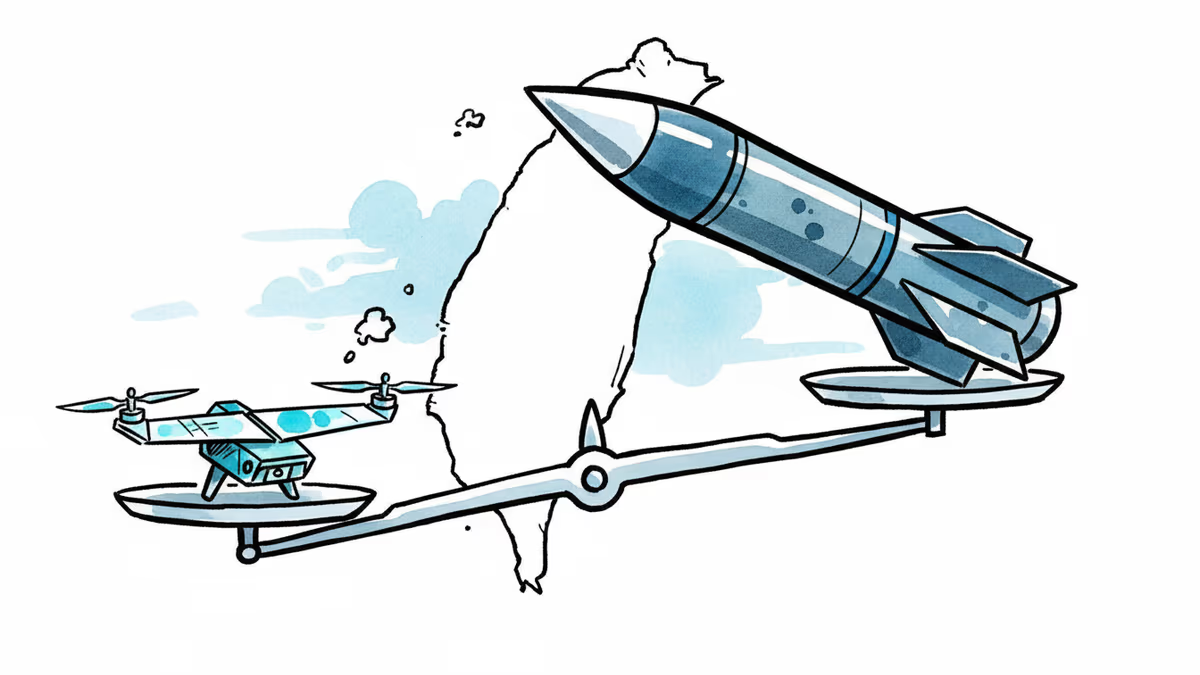

台灣企業Thunder Tiger成為首家獲美軍採購認證的亞洲無人機商,以無中國零件供應鏈切入市場。在習川會前夕,這場「低成本不對稱戰爭」的算盤,對整個華人世界意味著什麼?

美國太空軍公布12家黃金穹頂太空攔截器開發商,涵蓋SpaceX、洛克希德馬丁等巨頭。這場太空軍備競賽對亞太地區、台灣海峽及中美關係意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论