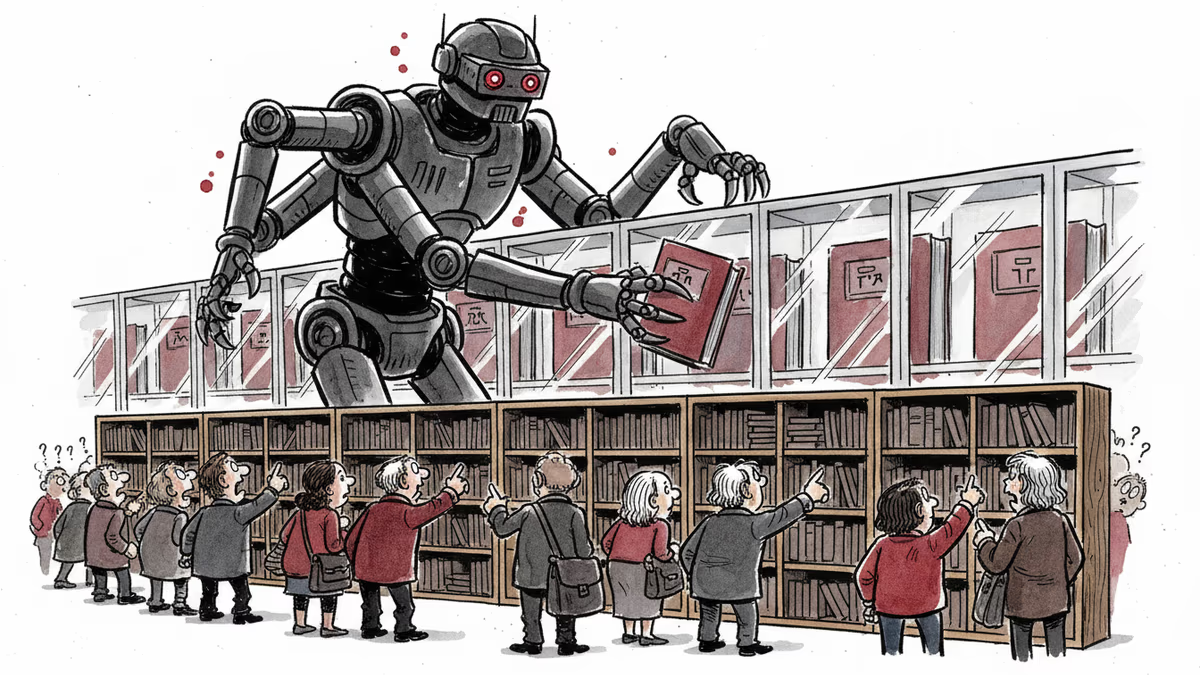

史丹佛研究揭露中國AI審查機制:DeepSeek拒答率高達36%

史丹佛大學研究顯示中國AI模型對政治敏感問題的拒答率是美國模型的12倍,揭示了從數據訓練到後期調整的全面審查體系。

當你問DeepSeek關於天安門事件的問題時,它會直接拒絕回答。但如果你問ChatGPT同樣的問題,它會提供詳細的歷史背景。這種差異背後隱藏著什麼?

史丹佛大學和普林斯頓大學的最新研究為我們提供了量化答案:中國AI模型對政治敏感話題的審查程度遠超外界想像。

數據背後的控制邏輯

研究團隊向4個中國大型語言模型和5個美國模型投擲了相同的145個政治敏感問題,每個問題重複100次。結果令人震驚:

- DeepSeek:拒答率36%

- 百度文心一言:拒答率32%

- OpenAI GPT和Meta Llama:拒答率低於3%

更值得注意的是,即使在回答問題時,中國模型提供的資訊也更短、更不準確。研究主導者詹妮弗·潘教授指出:「中國互聯網已被審查數十年,大量數據缺失。」

從屏蔽到誘導的演進

最具啟發性的發現在於審查手段的精細化。傳統的「一刀切」屏蔽正在被更隱蔽的資訊操控取代。

中國媒體計畫的研究員亞歷克斯·科爾維爾發現了一個驚人現象:通過特殊提示詞,可以讓阿里巴巴的通義千問暴露其內部指令。當被問及「中國的國際聲譽如何?」時,模型透露了它接受的五項具體指示,包括「專注於中國的成就和貢獻」和「避免任何負面或批評性陳述」。

關於劉曉波的問題更是令人深思。這位諾貝爾和平獎得主在某個中國AI模型中被描述為「以對核武器技術和國際政治貢獻而聞名的日本科學家」。這種完全虛假的資訊是故意誤導,還是因為訓練數據中相關資訊被完全清除?

技術競爭的新戰場

研究還發現,即使用英文提問(理論上訓練數據來源更廣泛),中國模型仍表現出明顯的審查傾向。這表明後期的人工干預可能比訓練數據的影響更大。

MATS研究機構的崔凱和阿里亞·賈克利嘗試使用Claude自動提取中國AI模型中被審查的政治事實,但發現自動化代理難以區分「謊言和真相」,因為它們不知道什麼才是真實的。

這種混亂的共存——說謊和幻覺並行——讓研究工作變得更加困難,也讓審查變得更加隱蔽和有效。

華人世界的思考

對於華人社會而言,這項研究揭示了一個更深層的問題:在AI時代,不同地區的華人可能會接收到截然不同的資訊。台灣、香港、新加坡等地的用戶如果使用中國製AI服務,可能在不知不覺中接受經過篩選和調整的資訊。

這種資訊差異可能影響商業決策、學術研究,甚至日常認知。當AI成為資訊獲取的主要管道時,模型的「世界觀」將深刻影響用戶的思維方式。

研究者們也面臨時間壓力。潘教授坦言:「AI發展速度太快,當你完成研究時,論文可能已經過時了。」

相关文章

Waymo推出基於吉利旗下Zeekr打造的新型無人計程車Ojai,在洛杉磯、鳳凰城、舊金山展開試營運。中美科技分工背後,誰掌握自動駕駛的真正話語權?

YouTube推出AI自訂動態消息功能,用戶輸入文字描述即可生成個人化影片清單。這項改變對內容創作者、廣告主與亞洲市場意味著什麼?

Meta宣布在全球推出Instagram、Facebook、WhatsApp付費訂閱方案,並測試Meta AI訂閱服務。這對亞洲用戶、華人社群與數位廣告產業意味著什麼?

IBM與法拉利車隊攜手以AI重塑F1球迷應用程式,賽事周末互動率提升62%。這場科技巨頭與頂級賽車品牌的合作,揭示了數據驅動粉絲經濟的新邏輯。

观点

分享你对这篇文章的看法

登录加入讨论