经济

AI聊天機器人 資安風險 2026:警惕對話中的隱私陷阱

2分钟阅读Source

解析 2026 年 AI 聊天機器人的資安風險。資安專家警告哪些數據絕對不可輸入 AI,從醫療隱私到企業機密,教你如何在 AI 時代保護數位資產與財務安全。

與AI對話愈發頻繁,但你是否在不經意間「開門揖盜」?2026年1月,資安專家發出嚴正警告:過度分享個人、醫療或企業數據給AI聊天機器人,正讓用戶面臨前所未有的詐騙與身分洩露風險。在科技浪潮下,數據安全已成為生存的必修課。

AI聊天機器人 資安風險 2026:哪些資訊絕對不能說?

儘管台積電(TSMC)的財報顯示AI繁榮依舊,但資安技術與法規建設卻難以望其項背。專家指出,用戶應避免向AI提供任何可用於精確識別身分的資訊。一旦數據被納入大型語言模型(LLM)的訓練集,便可能在與他人的互動中被意外導出,造成翻天覆地的連鎖反應。

- 個人隱私:如身分證字號、家庭地址或精確的財務收支狀況。

- 企業數據:包含尚未發布的產品原型圖、客戶清單或內部會議記錄。

- 密碼與驗證:任何形式的帳號密碼或多因素驗證密鑰。

在AI時代保護你的數位資產

目前市場中,Nvidia持續獨占鰲頭,但DeepSeek等新銳的崛起也讓數據隱私議題更加白熱化。我們建議企業應建立嚴格的AI使用守則,而個人則應將AI視為公眾場合的交談對象,而非私密的筆記本。

相关文章

经济CN

你今天發出的加密數據,兩年後可能已被解讀

AI正在加速量子電腦的研發進程,使現有區塊鏈與網路加密技術面臨前所未有的威脅。從比特幣到銀行系統,數位安全的基礎假設正在動搖。

经济CN

中國的「機器人學校」:誰在訓練未來的工人?

北京人形機器人數據訓練中心裡,前美術老師每天重複動作8小時,只為讓機器人學會工廠分揀。這是中國國家戰略的縮影,也是全球製造業秩序重組的前奏。

经济CN

兆元AI上市:這筆錢會改變什麼?

一家AI實驗室正準備以1兆美元估值上市,背後是高盛與摩根士丹利。這場史詩級IPO對亞洲投資者與華人科技生態意味著什麼?

经济CN

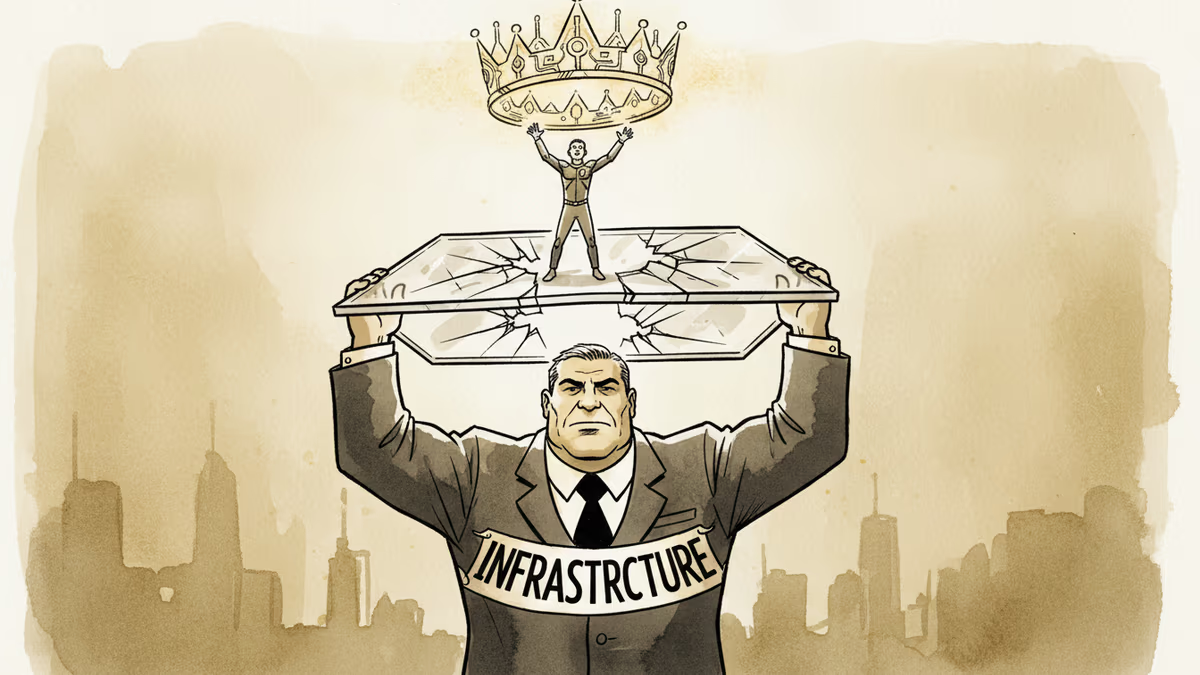

微軟花了千億美元,卻可能成為下一個IBM

馬斯克與奧特曼的法庭訴訟意外揭露微軟CEO納德拉的內心恐懼:在AI時代,基礎設施霸主能否避免淪為配角?深度分析科技巨頭的戰略困境。

观点

分享你对这篇文章的看法

登录加入讨论