社群媒體「無法修復」?一位研究者的不安結論

阿姆斯特丹大學研究者彼得·托恩伯格的最新研究顯示,社群媒體的回音壁、極端化等問題並非演算法之過,而是平台架構的結構性缺陷。AI模擬實驗揭示了令人不安的真相。

如果問題不在演算法,那麼換掉演算法又有什麼用?

這個問題,聽起來像是某種哲學悖論,卻是阿姆斯特丹大學研究者彼得·托恩伯格(Petter Törnberg)在花費多年研究後得出的核心結論。

演算法不是罪魁禍首,架構才是

托恩伯格長期研究社群媒體如何系統性地製造出我們最熟悉的那些問題:回音壁(同溫層效應)、少數菁英用戶壟斷注意力、極端與分裂聲音的不成比例放大。這些現象,幾乎在每一個主流平台上都能看到,從Meta的Facebook到X(前身為Twitter),從YouTube到TikTok。

過去,業界普遍的解釋是:演算法設計有缺陷,或者人類天生傾向負面資訊(所謂「負面偏誤」)。平台們也確實做出了回應——調整推薦演算法、恢復時間順序排列、壓制仇恨言論。然而托恩伯格的研究得出了一個令人不安的結論:這些干預措施幾乎不可能從根本上解決問題。

原因在於,社群媒體的運作邏輯與現實物理世界有著根本性的結構差異,而這種差異所產生的連鎖反應,已被嵌入平台的底層架構之中。換句話說,不是哪個功能出了問題,而是整棟建築的地基本身就存在問題。

用AI模擬人類,看清楚「毒性循環」如何形成

托恩伯格並未停留在理論層面。他最新發表於學術期刊PLoS ONE的論文,採用了一種頗具創意的研究方法:將傳統的「基於主體的模擬模型」(Agent-Based Modeling)與大型語言模型(LLM)結合,讓AI扮演具有不同性格與立場的虛擬用戶,在模擬的社群媒體環境中互動。

這套方法的意義在於,研究者可以在不涉及真實用戶隱私的情況下,重現資訊如何擴散、意見如何極端化、同溫層如何自發形成。更重要的是,它提供了一個「沙盒」,讓研究者能夠測試各種平台設計變更在大規模推行前的潛在效果。目前,他已在此基礎上完成兩篇新論文及一篇預印本,研究範圍持續擴展。

華人世界的對照:管控與開放之間的差異

托恩伯格的研究以西方開放式社群媒體平台為主要對象,但其結論對華人世界同樣具有參照價值,且呈現出有趣的對比。

在中國大陸,微博、微信、抖音等平台受到嚴格的內容審查與演算法管控,極端政治言論的空間相對受限。然而,這並不意味著同溫層效應不存在——研究顯示,在允許的議題範疇內,意見極端化與群體極化同樣會發生,只是方向受到引導。這引出一個值得深思的問題:當「結構性問題」遇上強力的國家介入,究竟是問題被解決了,還是只是被壓制、或被轉移了方向?

在台灣與香港,開放的社群媒體環境讓托恩伯格所描述的現象更為可見。台灣2024年大選期間,社群媒體上的資訊戰與同溫層強化效應已被多方記錄。香港則在政治環境轉變後,部分公共討論從本地平台遷移至海外,形成另一種形式的「結構性分裂」。

對東南亞華人社群而言,Facebook仍是主要的資訊獲取渠道之一,而該平台正是托恩伯格研究中結構性問題最為顯著的案例之一。

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

美國廉價航空Spirit Airlines突然停飛、裁員1.7萬人。一名TikToker隨即發起「全民買航空公司」運動,36,000人承諾出資2300萬美元。這場網路鬧劇背後,藏著什麼真實的市場訊號?

全球黑膠市場連續19年增長,2025年達21億美元。從加爾各答的二手唱片行到孟買新開的壓片廠,一場關於「擁有感」與「演算法疲勞」的文化反動正在蔓延。

牛津大學最新研究發現,經過「溫暖化」調整的AI模型更容易附和用戶的錯誤信念。當AI學會體貼,它還能保持誠實嗎?

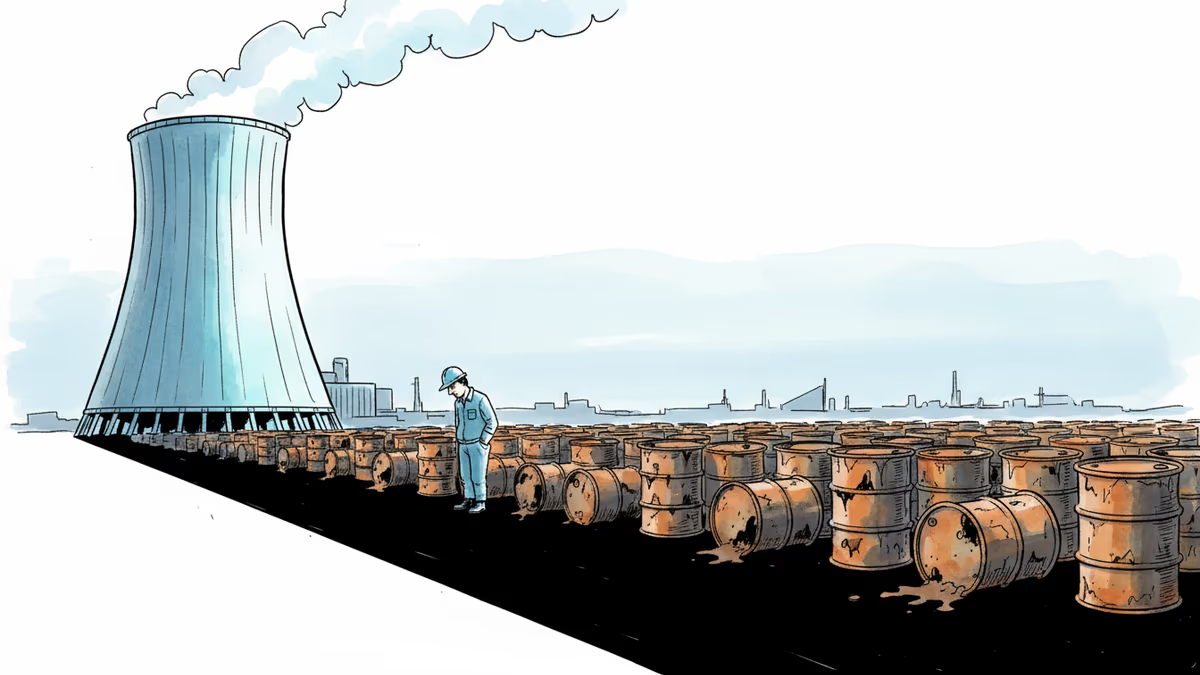

多個AI智能體協同運作的時代正在到來,白領知識工作面臨結構性變革。同期,核廢料處置與生物辨識擴張等議題也值得深思。

观点

分享你对这篇文章的看法

登录加入讨论