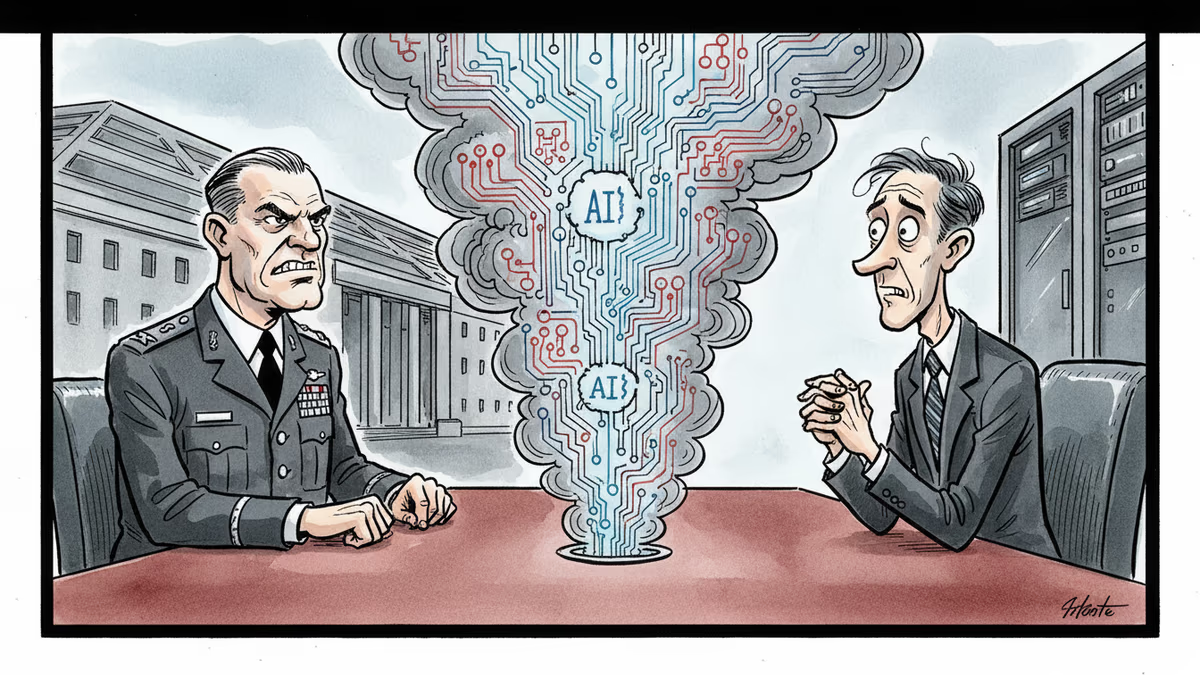

五角大廈對AI公司施壓:伊朗攻擊前的幕後角力

美國攻擊伊朗前夕,國防部與Anthropic公司就AI軍事用途展開激烈談判。探討AI時代企業倫理與國家安全的衝突。

在2026年3月對伊朗發動攻擊的週末前夕,美國國防部正與人工智慧公司Anthropic進行緊張談判,爭議焦點是五角大廈如何使用該公司的Claude AI系統。

企業原則與國家利益的碰撞

Anthropic要求保證其AI技術不會被用於國內監控等目的,但國防部以國家安全為由,要求更廣泛的使用權限。這場對峙揭示了AI時代一個核心問題:當國家安全與企業價值觀發生衝突時,誰應該讓步?

據知情人士透露,五角大廈採取了「強硬立場」,要求修改合約條款,而Anthropic則堅持其「負責任AI」的企業理念。最終雙方達成妥協,但具體條件仍屬機密。

這並非孤例。近年來,Google、Microsoft等科技巨頭都曾因軍事合約而面臨內部員工抗議和道德質疑。

華人科技界的啟示

對於華人世界的科技企業而言,這個案例格外值得深思。在台灣,台積電等企業已成為地緣政治博弈的關鍵棋子。在香港和新加坡,科技公司也面臨著不同政治體制下的複雜選擇。

特別是在兩岸關係緊張的背景下,台灣AI企業如何在美中科技競爭中定位自己?是否會面臨類似Anthropic的道德困境?這些問題沒有標準答案,但需要提前思考。

東南亞華人企業同樣面臨挑戰。馬來西亞和印尼的AI公司在與各國政府合作時,如何平衡商業利益與社會責任?

民主制度下的灰色地帶

有趣的是,這種企業與政府的角力主要發生在民主國家。在威權體制下,企業通常沒有討價還價的餘地。但在民主社會,企業的抵制權利與政府的安全需求之間存在微妙平衡。

歐盟的AI法案對軍事應用設置了限制,但美國的做法更加實用主義。中國大陸的AI企業則在不同的制度框架下運作。這種差異反映了不同政治體制對技術治理的不同理念。

技術中立性的終結?

長期以來,科技界信奉「技術中立」的理念,認為技術本身沒有道德屬性,關鍵在於如何使用。但AI的出現正在挑戰這一觀念。

當AI系統能夠自主決策、影響生死時,技術開發者還能聲稱中立嗎?Anthropic的抵制表明,越來越多的企業開始承認技術的道德責任。

但這也帶來新的問題:如果每家企業都有自己的道德標準,誰來制定統一的規則?市場機制能否確保負責任的AI發展?

相关文章

Anthropic公司抗議其AI技術被用於軍事行動的事件,揭示了AI技術軍民兩用的複雜問題和企業道德責任的界限。

印度國家級AI峰會遭遇連串爭議,從蓋茲與愛普斯坦關聯到莫迪外交政策質疑,揭示了科技活動如何成為政治博弈的舞台。

2026年1月,川普政府發布最新《國家國防戰略》(NDS),強調美國軍事將回防本土並重塑西半球霸權。報告中罕見未提及台灣,並大幅縮減對歐洲盟友的支援,標誌著美國地政戰略進入劇烈的收縮與重組期。

五角大廈發布 2026 國家國防戰略,中國不再是首要威脅。新戰略聚焦美國本土安全與現實主義,要求歐洲與南韓等盟友承擔更多國防責任,標誌著美國全球戰略的大幅轉向。

观点

分享你对这篇文章的看法

登录加入讨论