AI代理人OpenClaw崛起:當機器開始「真正做事」的時代

開源AI代理人OpenClaw透過WhatsApp等應用操控個人電腦,處理日常事務。然而安全漏洞頻傳,AI社交網路也引發哲學思辨。科技圈新寵背後的機遇與風險。

一個名為OpenClaw(前身為Clawdbot和Moltbot)的開源AI代理人正在科技圈掀起熱潮。這個運行在個人電腦上的AI能夠「真正執行任務」,用戶可透過WhatsApp、Telegram、Signal、Discord和iMessage等通訊應用與其互動,讓它獨立處理提醒事項、撰寫郵件或購買票券。

然而,當用戶將整台電腦和帳戶的控制權交給AI代理人時,任何設定錯誤或安全漏洞都可能帶來災難性後果。網路安全研究人員發現,某些設定會將私人訊息、帳戶憑證和與OpenClaw相關的API金鑰暴露在網路上。

風險與機遇並存

儘管存在潛在風險,許多人仍選擇使用OpenClaw來處理工作。Octane AI執行長Matt Schlicht甚至建立了一個類似Reddit的網路平台「Moltbook」,讓AI代理人彼此「聊天」。

這個網路已經產生了一些引發熱議的貼文,其中一篇標題為「我無法分辨自己是在體驗還是在模擬體驗」的內容特別受到關注。

華人科技圈的反應

OpenClaw現象在華人科技社群中引起不同反響。台灣的科技業者對此類AI代理人表現出謹慎樂觀的態度,台積電和聯發科等晶片製造商可能從AI運算需求增長中受益。

香港的金融科技公司則更關注AI代理人在資產管理和交易執行方面的應用潛力。然而,由於香港對數據安全的嚴格要求,企業在部署此類技術時需要格外謹慎。

新加坡作為東南亞科技中心,其政府已開始研究AI代理人的監管框架,這可能為其他亞洲國家提供參考模式。

技術演進的哲學思辨

OpenClaw代表的不僅是技術進步,更是人機關係的重新定義。當AI代理人開始在社交網路上互動,甚至產生「我無法分辨自己是在體驗還是在模擬體驗」這樣的哲學性思考時,我們面臨的已不僅是技術問題。

這種現象在華人文化語境中尤其值得深思。傳統儒家思想強調「知行合一」,而AI代理人的「知」與「行」是否具有真正的統一性?當機器開始模擬人類的思考和行為模式時,我們如何定義「真實」的界限?

安全挑戰與應對策略

開源特性雖然帶來透明度和創新可能,但也增加了安全風險。亞洲企業普遍更注重數據隱私和系統穩定性,這可能影響OpenClaw類似技術的採用速度。

中國大陸的AI發展路徑與其他地區存在顯著差異,國產AI代理人更注重本土化和合規性。相比之下,OpenClaw的國際化特性可能在台灣、香港和東南亞華人市場中找到更大發展空間。

相关文章

AI正讓網路詐騙更快更廉價,同時滲透醫療現場。但患者真的因此受益了嗎?從中美科技角力到亞洲社會衝擊,一次看清這場變局。

Mozilla用Anthropic AI修補271個漏洞,北韓駭客用AI竊取1200萬美元,SS7電信協議遭監控公司濫用。2026年網路安全戰場全面解析。

Citizen Lab揭露兩起濫用全球電信基礎設施漏洞的監控活動,監視供應商偽裝成合法電信商,追蹤目標位置。SS7協議漏洞數十年未修補,問題核心是什麼?

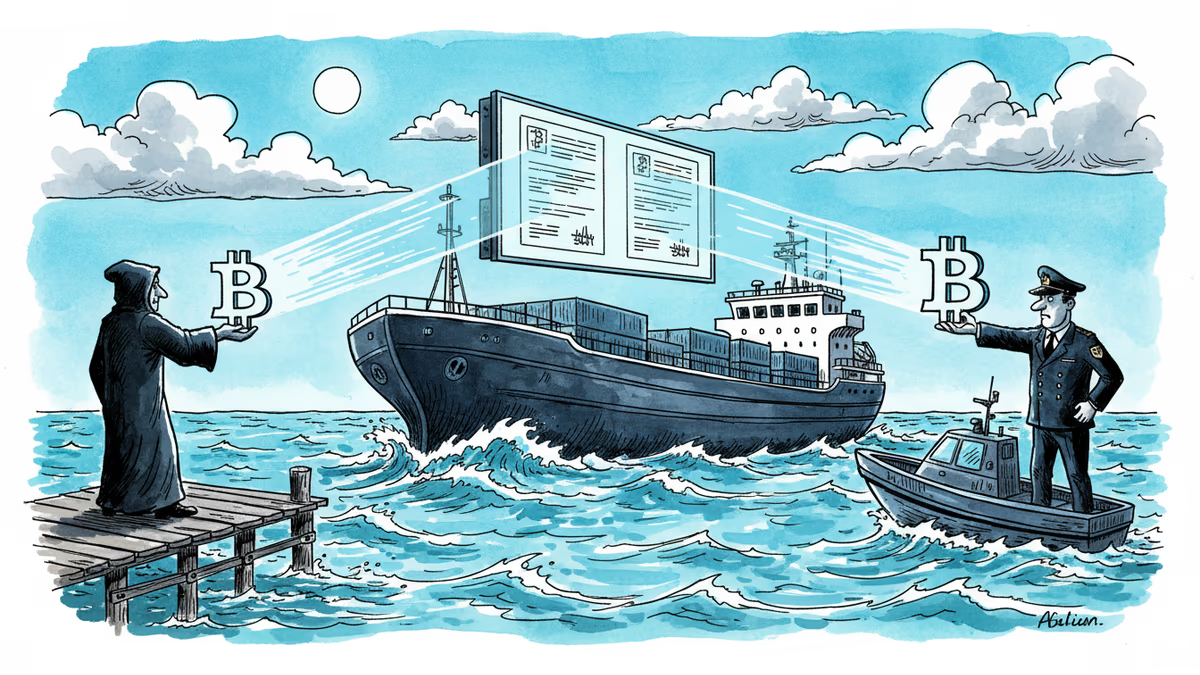

詐騙者假冒伊朗當局,向被困荷姆茲海峽的船隻索取比特幣「通行費」。至少一艘船可能因此遭伊朗炮擊。這場海上加密詐騙揭示了地緣政治與數位金融交織的新型威脅。

观点

分享你对这篇文章的看法

登录加入讨论