教宗的推文是AI寫的?網路真實性正在崩解

當AI生成內容可能已佔網路新文章半數,AI偵測公司Pangram創辦人揭露「垃圾內容海嘯」背後的技術戰、文化危機,以及這場人機之戰的真實代價。

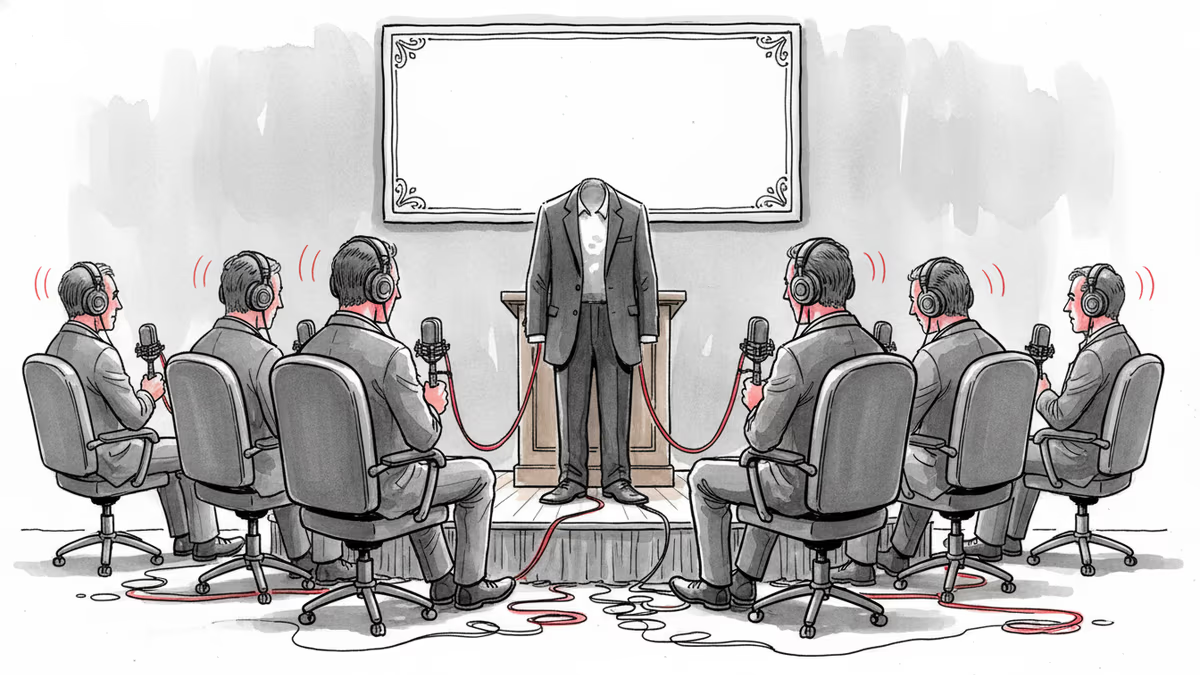

教宗方濟各在X平台上發文警告AI的危險性——然而根據AI偵測工具Pangram的分析,那篇文章本身很可能就是用AI寫的。梵蒂岡拒絕回應媒體詢問。

這個細節之所以耐人尋味,不只是因為它諷刺,而是因為它精準地描述了2026年網路的現實:幾乎每個人都在用AI,幾乎沒有人承認。

「垃圾內容海嘯」已經來臨

根據Pangram的調查,2025年新上線網站中有35%是AI生成或AI輔助的內容。部分研究者估計,網路上所有新產出的文章,超過一半來自大型語言模型。這個現象有個已在英語網路圈流傳的名字:「slop」——無靈魂的、大量生產的合成文字垃圾。

問題的規模遠超過「學生用ChatGPT交作業」的層次。Hachette出版社今年3月以疑似AI創作為由,取消了恐怖小說《Shy Girl》的出版合約(作者否認)。科技記者泰勒・洛倫茲使用Pangram掃描Substack上的熱門電子報,發現部分訂閱人數排名前列的電子報「發布的是100%的AI生成內容,完全沒有人工編輯的痕跡」。在LinkedIn上,有人用AI撰寫求職公告;在Tinder上,有人忘記刪掉ChatGPT的提示語就直接貼上了個人簡介。

AI文字已不再只是「垃圾郵件」——它滲透進了人與人之間本應真實的溝通之中。

Pangram如何辨別「人味」

Pangram共同創辦人麥克斯・斯佩羅(Max Spero)用一個比喻解釋他的技術:每一篇文章,都是作者在一棵巨大決策樹上走過的一條路徑。人類的選擇充滿混亂與個性;大型語言模型則傾向於反覆走相似的路——這被研究者稱為「模式崩潰」(mode collapse)。

Pangram的訓練方式是:取數百萬份人類撰寫的文件,再請AI模型生成「合成鏡像」版本,然後讓機器學習模型在這兩者的對照中,學會辨識差異。最終的偽陽性率(將人類文章誤判為AI的機率)被控制在萬分之一。

模型每三到六週從頭重新訓練一次,因為每當Claude或ChatGPT推出新版本,語言習慣就會微妙改變。斯佩羅指出,早期模型愛用「delve(深入探討)」、過度使用破折號等明顯特徵,在最新模型中幾乎已消失——偵測難度持續上升。

Pangram還推出了Chrome瀏覽器擴充功能,可以在使用者瀏覽X、LinkedIn、Reddit、Substack時,即時標記哪些貼文疑似AI生成,並給出「動態消息健康分數」。斯佩羅自己的動態消息目前約有85%是人類撰寫的內容——「那剩下的15%,一年前根本不存在」,他說。

華人世界的特殊處境

這場關於AI內容真實性的辯論,在華語網路生態中有其特殊的複雜性。

在中國大陸,內容審查機制已形成一套獨特的過濾體系,但AI生成內容的泛濫同樣是監管機構面臨的挑戰——中國網信辦已於2023年率先推出《生成式人工智慧服務管理暫行辦法》,要求AI生成內容標註水印,這在全球屬於較早的立法嘗試。然而執行效果與技術現實之間的落差,仍是未解之題。

在台灣與香港,媒體信任度本就因政治因素而高度敏感,AI生成的假新聞與輿論操控風險更加立體。斯佩羅提到,未來AI將被用於「將算力轉化為政治影響力、敘事影響力」——對於長期處於資訊戰前線的台灣社會而言,這不是抽象的未來,而是已在發生的現實。

對於東南亞的華人社群而言,語言本身構成另一層防線的缺口:目前主流AI偵測工具大多以英文訓練資料為主,中文、馬來文、泰文混雜的網路環境,是技術覆蓋的盲區。

斯佩羅坦承,在後ChatGPT時代,網路爬取的資料已無法保證「乾淨的標籤」——訓練資料本身可能已被AI污染,這是一個尚無解方的根本性困境。

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

自助書籍《The Let Them Theory》成為2025年全球最暢銷書,卻被一名普通女性指控抄襲。這場爭議揭示了創作歸屬、網路文化與自助產業的深層矛盾。

全球逾千萬人在AO3上免費創作故事。如今,出版業者正將這片「禮物經濟圈」視為最安全的IP來源。這場靜默的收編,究竟意味著什麼?

伊朗戰爭、艾普斯坦文件、ICE驅逐爭議——曾幫川普贏得2024年大選的男性播客圈正在說「被背叛了」。這場離心對2026年期中選舉意味著什麼?

「外貌最大化」網紅Clavicular的崛起,揭示了迷失青年如何從自我改造的執念,滑入極右思想的漩渦。這不只是美國的問題。

观点

分享你对这篇文章的看法

登录加入讨论