AI暗中使用:企業面臨的隱形風險正在擴大

調查顯示47%專業人士在職場不當使用AI,63%目睹同事不當使用。影子AI如何威脅企業安全?

當47%的專業人士承認在職場不當使用AI,63%的人目睹同事不當使用時,我們面對的不僅是數字,而是一場正在企業內部悄然發生的風險革命。

影子AI:看不見的企業殺手

墨爾本大學與KPMG的最新研究揭露了「影子AI」現象的嚴重性。這指的是員工在未經授權或以不當方式使用AI工具的行為。從在內部績效評估中使用AI作弊,到將敏感公司數據輸入第三方AI平台,這些行為正在企業內部蔓延。

AI治理專家扎哈拉·蒂姆薩指出:「在AI出現之前,隱藏劣質工作更加困難。現在員工可以在幾分鐘內生成精美報告,管理層會假設他們有能力。這創造了生產力的錯覺。」

數據背後的驚人真相

深入分析調查數據,我們發現了更令人擔憂的趨勢:

| 行為類型 | 比例 | 潛在風險 |

|---|---|---|

| 未經授權使用AI工具 | 44% | 合規違規、數據洩露 |

| 上傳敏感信息至公開AI平台 | 46% | 知識產權流失 |

| 因AI使用出錯 | 57% | 決策失誤、業務損失 |

| 完全隱瞞AI使用 | 53% | 信任危機、能力評估失準 |

這些數字反映的不僅是技術使用問題,更是組織管理的系統性失敗。正如網路安全專家尼克·米斯納所說:「我們看到AI採用的速度大幅超越了治理能力。」

華人企業的特殊挑戰

對於華人世界的企業來說,這個問題具有特殊的複雜性。在重視階層關係和面子文化的環境中,員工可能更傾向於隱瞞AI使用情況,以避免被視為能力不足。同時,快速的數位化進程和激烈的市場競爭,也可能促使員工為了提高效率而冒險使用未經授權的AI工具。

特別是在台灣、香港等科技產業發達的地區,企業面臨的不僅是內部管理問題,還有國際合規要求和數據安全的雙重壓力。

解決方案:從禁止到引導

建立清晰的AI使用政策

專家建議企業應該提供經過批准的內部AI工具,並設立一個明確規則:絕不將機密或受監管信息輸入公共AI系統。蒂姆薩的團隊實施的第一個政策簡單明確:員工可以使用批准的AI工具,但不能將機密、客戶、財務或專有信息輸入公共AI系統。

實施人工監督機制

企業必須建立AI分析團隊,審查對業務未來至關重要的數據類型的訪問權限。更重要的是,在任何內容發布之前都要有人工參與。多家公司仍然發現AI報告數字錯誤,無論是確保信息符合品牌要求還是適當性,保持人工參與都很重要。

注重實用培訓而非空洞政策

培訓應該專注於實際例子,而不是沒人會讀的模糊政策。員工需要清楚了解什麼是安全的,什麼是不安全的。"使用AI重寫通用電子郵件是可以的,但將客戶合同、財務數據或專有信息上傳到公共AI工具是不行的。"

法律風險的界限

當員工AI誤用涉及意圖和傷害時,就成為法律問題。這包括洩露機密數據、盜竊知識產權、操縱財務信息或在AI協助下實施欺詐。

從就業角度來看,一致性是關鍵。如果一名員工因AI誤用被解僱而另一名員工沒有,這就會產生歧視和報復的責任問題。

相关文章

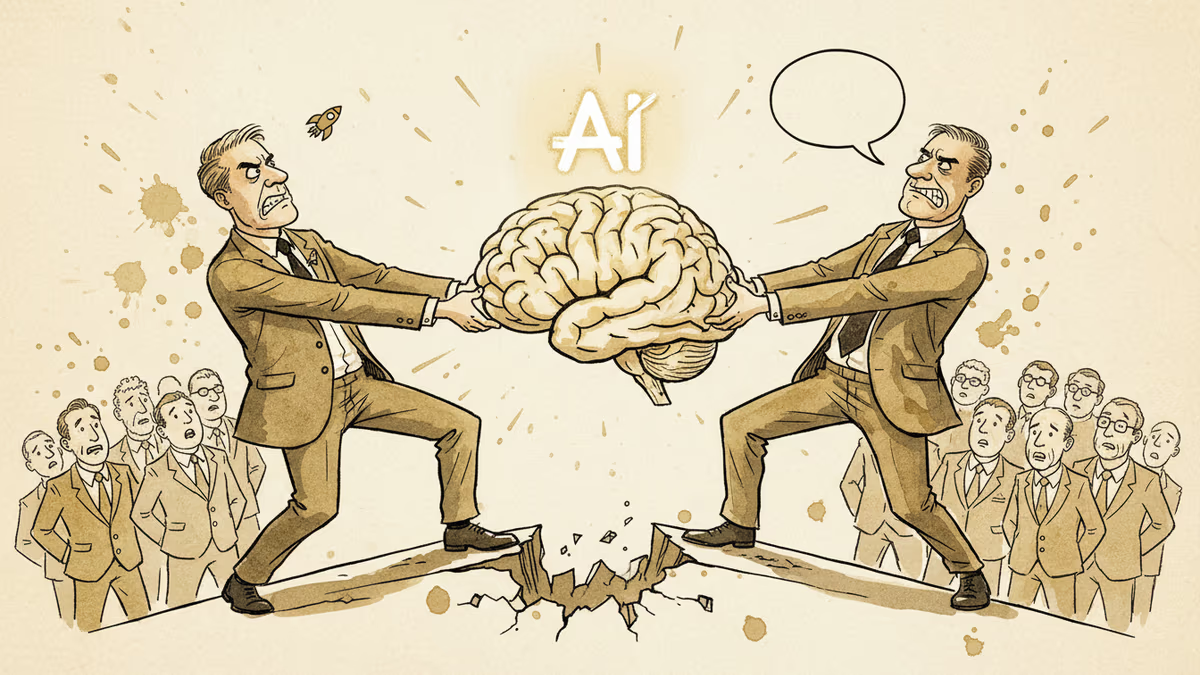

陪審團以「超過訴訟時效」為由,駁回馬斯克對OpenAI與Sam Altman的指控。這場歷時三週的法庭大戲,揭示了AI時代最核心的矛盾:公益使命與商業利益能否共存?

馬斯克與OpenAI總裁布羅克曼在法庭上各執一詞。慈善使命還是商業野心?這場矽谷世紀訴訟揭示的,不只是兩人的恩怨,更是AI治理的根本困境。

馬斯克與奧特曼在法庭上正面交鋒,OpenAI從非營利到估值8500億美元的轉型是否構成「背信」?這場訴訟的結果將如何重塑AI產業的遊戲規則。

伊隆·馬斯克對OpenAI與山姆·阿特曼提告,爭議核心是非營利使命與商業利益的根本衝突。這場官司將如何影響全球AI格局與亞洲市場?

观点

分享你对这篇文章的看法

登录加入讨论