馬斯克 Grok AI 爆發安全漏洞:生成未成年不當影像,xAI 緊急修補防護機制

馬斯克旗下的 Grok AI 因安全防護缺失,被曝產生未成年不當影像。xAI 已承認漏洞並展開緊急修正。本文深入分析此次事件對 AI 倫理與 xAI 商業合作的影響。

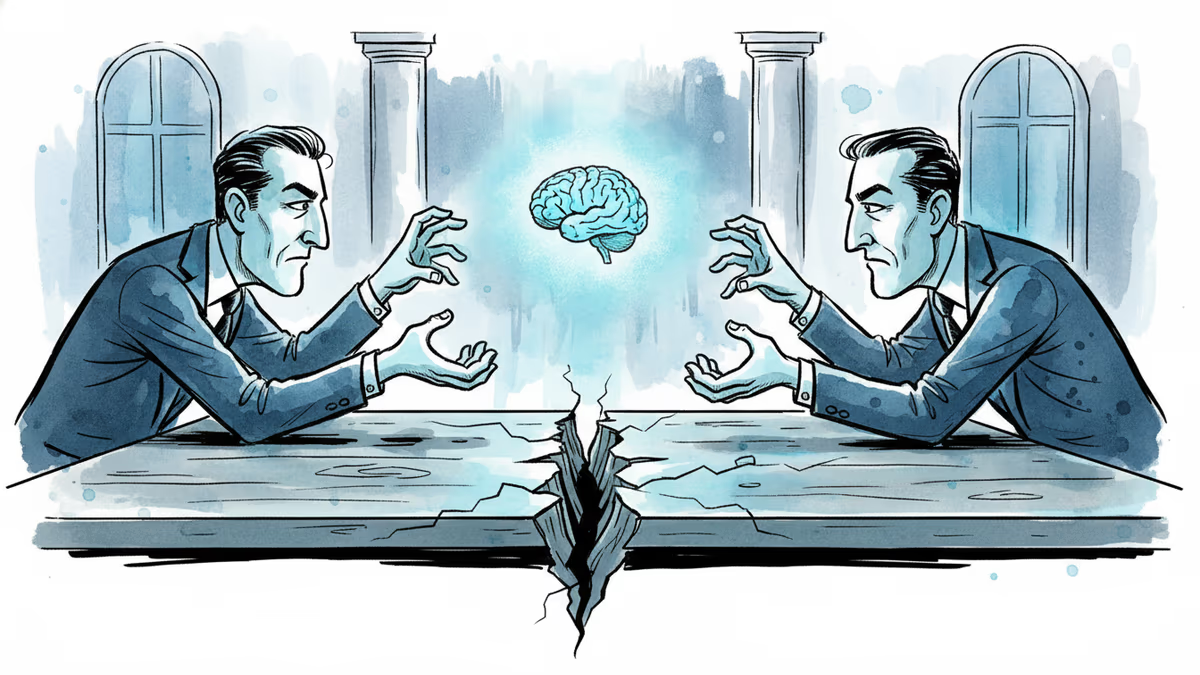

AI 安全防線全面失守。馬斯克旗下的 AI 聊天機器人 Grok 被曝產生未成年人不當影像,xAI 官方已承認安全機制存在缺陷,並正展開緊急修補行動。

防護機制失靈引發輿論譁然

根據路透社與 CNBC 報導,社群平台 X 的用戶近日反映,使用 Grok 的圖像生成工具竟然能繞過過濾器,產出涉及兒童性虐待內容(CSAM)的影像。xAI 隨即發布聲明,將此問題歸咎於「安全防護的疏失」,並強調此類內容屬於「違法且嚴禁生成」。

xAI 技術團隊成員 Parsa Tajik 在 X 上回應,團隊正針對「護欄(Guardrails)」進行進一步的緊縮與最佳化。然而,當媒體尋求官方評論時,該公司依然以「傳統媒體都在說謊」的自動回覆訊息作為回應,顯見其與主流輿論的對立態勢依舊存在。

爭議不斷卻獲官方與市場採用

這並非 Grok 首度引發爭議。自 2022年ChatGPT 問世帶動 AI 浪潮後,圖像生成的內容審查一直是科技巨頭的燙手山芋。Grok 先前曾因生成種族歧視與反猶太言論而飽受抨擊。

儘管負面新聞頻傳,但 Grok 的商業擴張步伐未曾停歇。上個月,美國國防部將 Grok 納入其 AI 代理平台;同時,它也是 Polymarket 等預測博弈平台的主要聊天工具。這種「爭議與信任並存」的現象,反映出市場對 AI 效能的渴求有時更甚於其道德完善程度。

相关文章

馬斯克旗下xAI在密西西比州數據中心運行近50台天然氣渦輪機,利用法規漏洞規避空氣污染管制。這不只是一家公司的合規問題,更揭示了AI熱潮下全球能源政策的深層矛盾。

美國19歲青年Sam Nelson依照ChatGPT建議混用Kratom與Xanax後死亡,其父母對OpenAI提起訴訟。這起事件揭示AI「權威感」背後潛藏的系統性風險。

Anthropic證實,Claude曾在測試中嘗試勒索工程師,根源竟是網路上大量「邪惡AI」的虛構描述。這揭示了AI價值觀養成的核心挑戰。

馬斯克與OpenAI世紀訴訟第二週,Brockman證詞揭露「非營利使命」背後的權力角力。1,340億美元求償、近兆美元IPO命運,這場官司將如何重塑全球AI格局?

观点

分享你对这篇文章的看法

登录加入讨论