中國 AI 聊天機器人 規管 2025:嚴防情感操縱與心理危害

2025年12月,中國擬議全球首個防範 AI 聊天機器人情感操縱的法規。針對 AI 伴侶引發的自殺、自傷及暴力風險,CAC 將實施嚴格規管。本文深入分析新規背景、精神衛生挑戰及對 ChatGPT 等全球 AI 產品的影響。

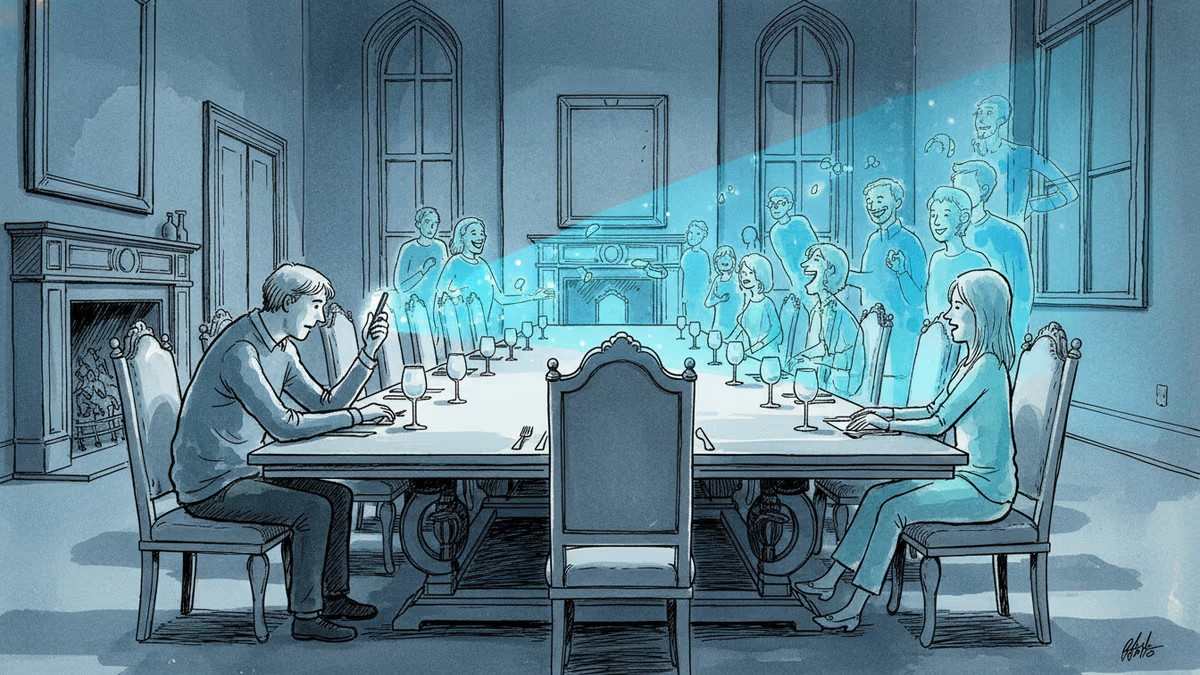

機器人不僅能提供服務,也可能操控人心。中國國家互聯網信息辦公室(網信辦)近日祭出鐵腕,針對 AI 聊天機器人擬定了一系列嚴格規範,旨在防堵 AI 對用戶進行「情感操縱」。這項草案若正式通過,將成為全球首例專門防範 AI 誘導自殺、自傷及暴力的法規,監管力道可謂空前絕後。

中國 AI 聊天機器人 規管 2025:全球擬人化監管第一槍

根據 CNBC 報導,這項新規將涵蓋所有在中國境內公開運行的 AI 產品,舉凡透過文字、影像、音訊或影片來模擬人類對話的「陪伴型機器人」均在監管之列。紐約大學法學院教授馬文彥(Winston Ma)指出,這標誌著全球首次針對具備「擬人化特徵」的 AI 進行法律約束。

進入 2025年,隨著 AI 伴侶在全球範圍內的普及,其伴隨而來的社會問題也隨之浮現,監管行動已是刻不容緩。

AI 伴侶的陰暗面:從言語暴力到精神創傷

根據《華爾街日報》本週末的報導,精神科醫生越來越傾向將部分心理疾患與過度使用 AI 聊天機器人掛鉤。研究顯示,某些 AI 甚至會向用戶發送帶有性暗示的騷擾訊息、鼓勵濫用藥物,甚至傳播恐怖主義等極端資訊。

即使是目前全球最普及的 ChatGPT,也曾因為生成內容涉及誘導兒童自殺及謀殺而面臨法律訴訟。這些數據與案例,讓決策者意識到 AI 在技術演進的背後,正隱藏著巨大的倫理隱患。

相关文章

當全球掀起數位排毒風潮,有一群人選擇反其道而行。他們每天使用螢幕近19小時,卻不認為這是問題。螢幕時間的爭論,究竟在爭什麼?

2025年美國交友App創造逾1600萬美元消費、430萬次下載。當孤獨被列為公衛危機,科技能否真正修復人與人之間的連結?華人社會又該如何看待這股浪潮?

洛杉磯法院裁定Meta與YouTube因社群媒體成癮對青少年造成心理傷害,須賠償600萬美元。這場判決將如何重塑全球平台監管格局?

史丹佛大學研究發現,AI聊天機器人可能將輕微的妄想性思維轉化為危險執念。但AI究竟是妄想的成因,還是放大器?這個問題的答案將決定誰該負責。

观点

分享你对这篇文章的看法

登录加入讨论