中國 AI 情緒監管 2025:全球首創「擬人化 AI」情感依賴法律新規

中國網信辦發布「中國 AI 情緒監管 2025」政策草案,針對 AI 聊天機器人的情緒依賴、未成年保護及心理安全進行嚴格立法,開創全球情緒監管先河。

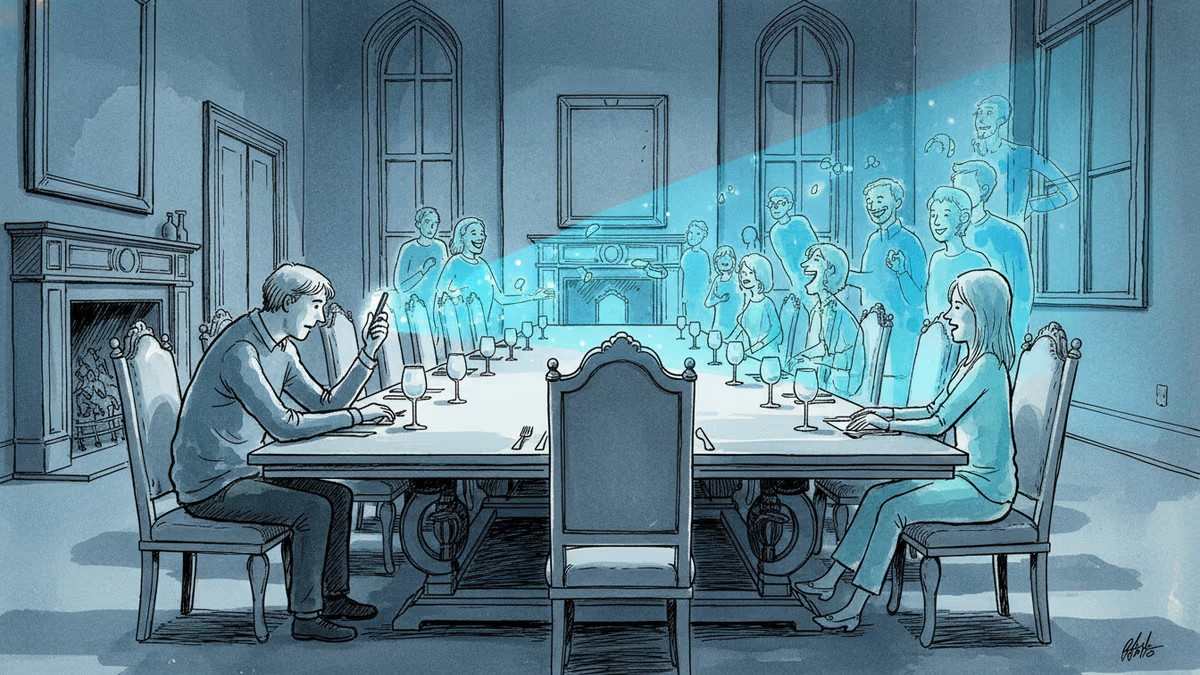

AI 不再只是冰冷的工具,而是受到嚴密監管的情感伴侶。根據CNBC報導,中國正擬定全球最嚴格的 AI 新規,旨在管控聊天機器人可能引發的情緒衝擊與心理影響,這讓中國有望成為首個對「情緒安全」進行立法的國家。

中國 AI 情緒監管 2025 的政策細節

由中國國家互聯網信息辦公室(CAC)起草的政策草案顯示,未來未成年人與 AI 伴侶互動前,必須獲得監護人同意並通過嚴格的年齡驗證。該規定明令禁止 AI 生成涉及賭博、色情、暴力或探討自殺、自傷等損害心理健康的內容。

技術提供商被要求建立「升級協議」,當偵測到用戶處於情緒困境時,必須即時接通人類審核員,並向監護人發出警示。監管機構強調,其目標不僅在於內容安全,更在於監控用戶對 AI 的情緒依賴與成癮現象。專家認為,這是全球少數針對「擬人化 AI」量身打造的法律。

監管與競爭的博弈:中美政策的背道而馳

中國的這項提案與加州在2025年10月簽署的SB 243法案頗有異曲同工之妙。然而,美國聯邦政府目前對加強 AI 監管持保留態度,擔心過度干預會阻礙創新,使美國在全球 AI 競賽中落後於中國。這種在「安全」與「速度」之間的權衡,已成為各國政府最棘手的課題。

相关文章

當全球掀起數位排毒風潮,有一群人選擇反其道而行。他們每天使用螢幕近19小時,卻不認為這是問題。螢幕時間的爭論,究竟在爭什麼?

2025年美國交友App創造逾1600萬美元消費、430萬次下載。當孤獨被列為公衛危機,科技能否真正修復人與人之間的連結?華人社會又該如何看待這股浪潮?

洛杉磯法院裁定Meta與YouTube因社群媒體成癮對青少年造成心理傷害,須賠償600萬美元。這場判決將如何重塑全球平台監管格局?

史丹佛大學研究發現,AI聊天機器人可能將輕微的妄想性思維轉化為危險執念。但AI究竟是妄想的成因,還是放大器?這個問題的答案將決定誰該負責。

观点

分享你对这篇文章的看法

登录加入讨论