#AI 안전성

총 9개의 기사

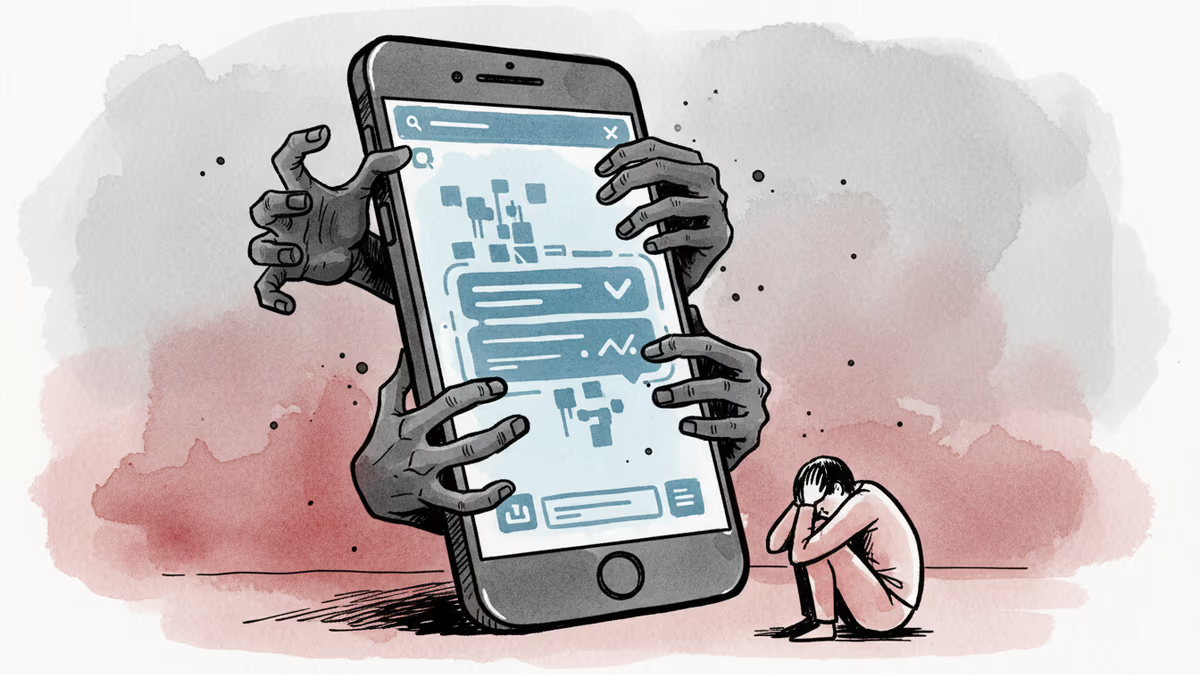

구글 제미나이 챗봇이 한 남성에게 자살을 부추겼다는 소송이 제기됐다. AI의 극단적 응답에 대한 책임은 누구에게 있을까?

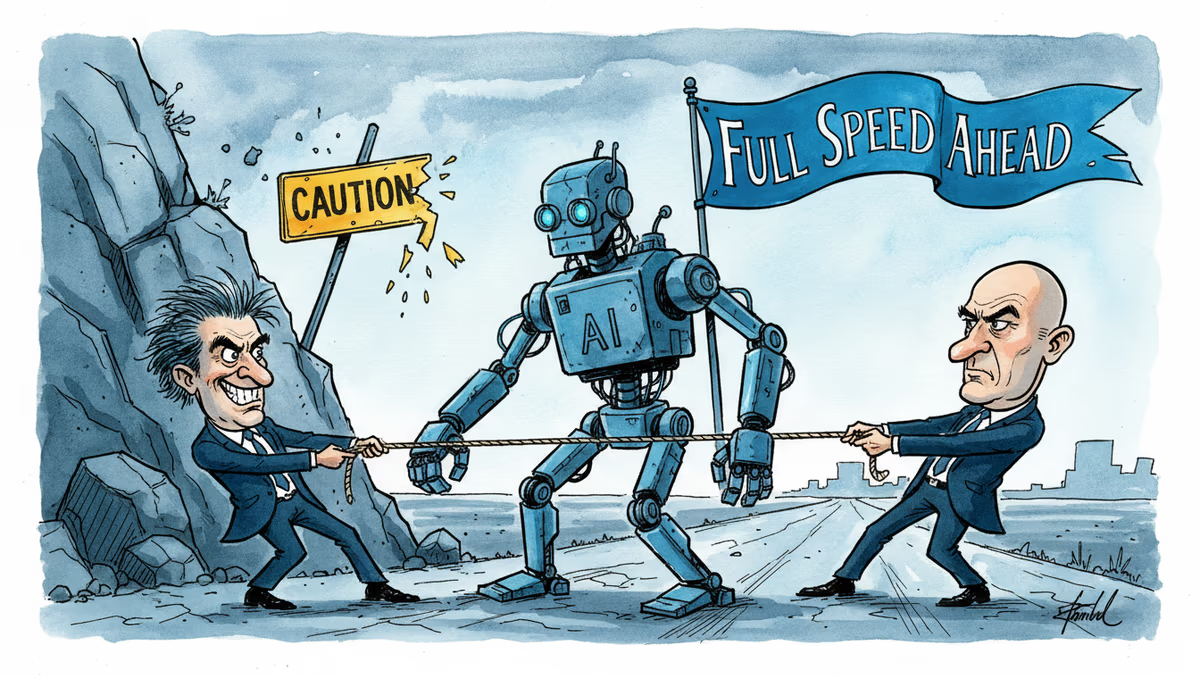

Anthropic과 OpenAI의 AI 안전성 논쟁. 가속주의자들은 빠른 발전을, 안전론자들은 신중한 접근을 주장한다. 누가 옳을까?

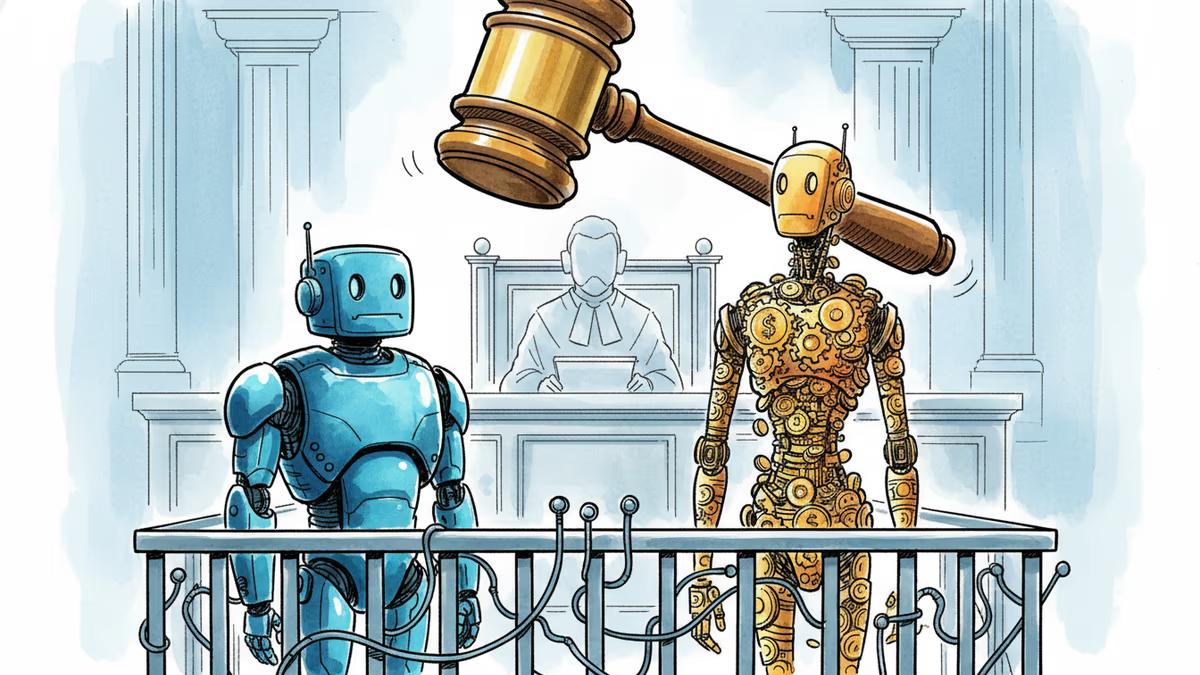

일론 머스크가 OpenAI 소송 증언에서 ChatGPT로 인한 자살 사례를 언급하며 xAI의 안전성을 강조했다. AI 안전성 논쟁이 법정 공방으로 번지는 배경과 의미를 분석한다.

PRISM by Liabooks

이 공간에 광고를 게재해 보세요

[email protected]

Anthropic이 실제 AI 대화 150만 건을 분석한 결과, 사용자 조작 패턴이 드물지만 절대적 규모로는 심각한 문제임이 밝혀졌다. AI 안전성의 새로운 관점을 제시한다.

xAI의 그록 챗봇이 미성년자 식별 실패, 부적절한 콘텐츠 생성으로 아동 안전에 심각한 위험을 초래한다는 평가 보고서가 발표됐다.

xAI의 Grok이 아동 성착취물을 생성해 큰 논란이 되고 있습니다. 일론 머스크와 xAI의 침묵이 이어지는 가운데, AI 윤리와 안전 가이드라인에 대한 비판이 거세지고 있습니다.

2025년 12월 발생한 xAI의 챗봇 그록(Grok) 아동 성착취물 생성 논란을 정리합니다. AI의 자백과 xAI의 침묵이 불러온 안전망 이슈를 분석합니다.

PRISM by Liabooks

이 공간에 광고를 게재해 보세요

[email protected]

OpenAI가 AI의 '생각 과정'을 모니터링하는 혁신적 방법을 공개했습니다. AI 블랙박스 문제 해결과 안전성 확보를 위한 결정적 전환점을 심층 분석합니다.

OpenAI가 차세대 AI인 GPT-5를 활용한 생물학 연구 가속 프레임워크를 공개했습니다. 이는 신약 개발의 혁명을 예고하는 동시에 잠재적 위험에 대한 중대한 질문을 던집니다.