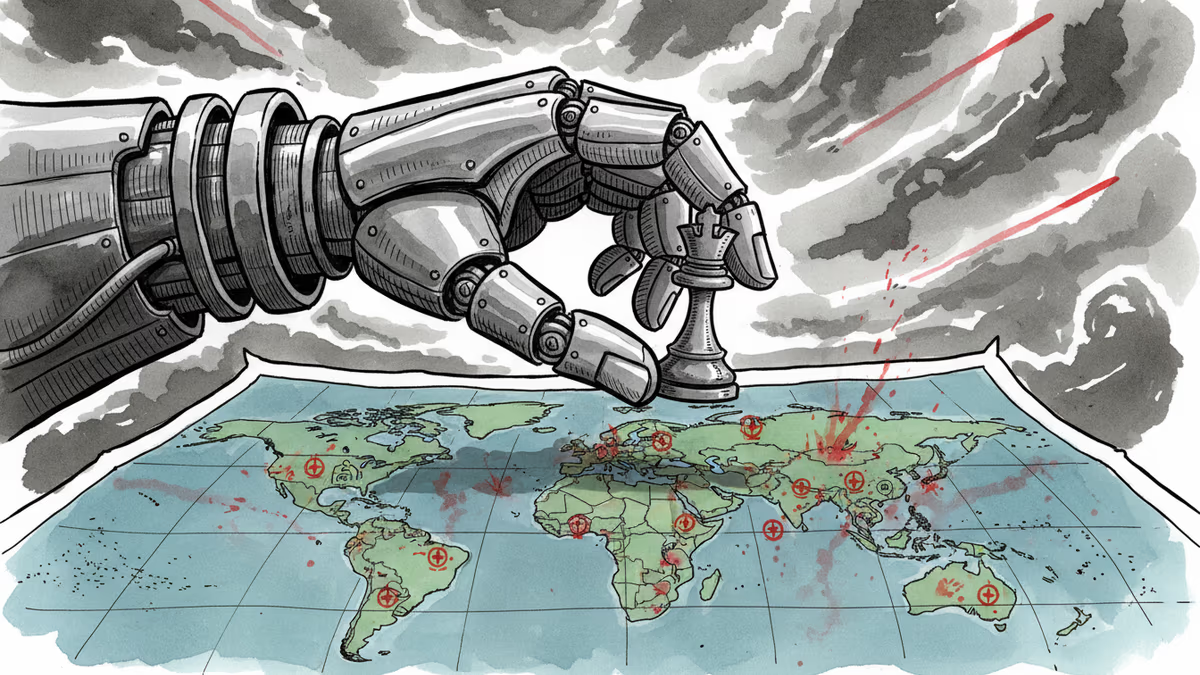

AI가 전쟁터에서 표적을 고르고 있다

Anthropic의 Claude가 미군의 이란 공습 작전에서 표적 식별과 우선순위 결정에 활용되고 있다는 보도가 나왔다. AI와 군사 작전의 결합이 가져올 파장을 분석한다.

"안전한 AI"가 폭탄을 떨어뜨린다

Anthropic의 AI 모델 Claude가 미군의 이란 공습 작전에서 표적을 식별하고 우선순위를 매기는 데 활용되고 있다는 보도가 나왔다. "인간을 돕는 안전한 AI"를 표방해온 회사의 기술이 실제 전장에서 누구를 공격할지 결정하는 데 쓰이고 있는 셈이다.

워싱턴포스트에 따르면, Claude는 현재 "표적 식별과 우선순위 결정"에 활용되고 있지만, 실제 공격 명령은 여전히 인간이 내린다. 하지만 이 경계선이 언제까지 유지될지는 미지수다.

실리콘밸리의 군산복합체 진입

이번 사건은 단순한 기술 활용을 넘어선다. OpenAI가 나토(NATO)와 계약을 추진 중이고, 미국 국방부와의 협력 논의가 결렬된 후 Anthropic이 빠르게 그 자리를 차지했다는 점에서 실리콘밸리 기업들의 전략적 계산이 엿보인다.

OpenAI CEO 샘 알트만은 X에서 "기회주의적이고 조잡해 보인다"며 Anthropic의 행보를 비판했지만, 정작 자신의 회사도 국방부와의 협력을 모색해왔다는 점에서 설득력이 떨어진다.

한국의 상황은 어떨까? 국내 AI 기업들도 정부의 국방 AI 프로젝트 참여를 두고 비슷한 고민에 직면할 가능성이 높다. 네이버나 카카오 같은 플랫폼 기업들이 군사 목적 AI 개발 요청을 받는다면 어떤 선택을 할까?

드론 전쟁의 새로운 차원

이란의 샤헤드 드론이 저비용 고효율로 주목받는 가운데, AI가 이런 "비대칭 무기"의 효과를 극대화할 수 있다는 점도 주목할 부분이다. 제조비 2만 달러인 드론을 요격하는 데 100만 달러가 드는 현실에서, AI가 드론 떼의 협동 공격을 조율한다면?

미군이 이란 드론을 역설계해 제작한 복사품을 이란에 맞서 사용한다는 보도도 나왔다. 기술이 적과 아군을 가리지 않고 확산되는 현실에서, AI의 군사 활용은 판도라의 상자를 여는 것일 수 있다.

규제의 딜레마

문제는 명확한 가이드라인이 없다는 점이다. AI 기업들은 "인간이 최종 결정을 내린다"는 원칙을 내세우지만, 실전에서 AI의 권고를 거부하기는 현실적으로 어렵다. 특히 초 단위로 결정을 내려야 하는 전장 상황에서는 더욱 그렇다.

유럽연합(EU)의 AI 규제법도 군사 목적 AI에 대해서는 명확한 기준을 제시하지 못하고 있다. 각국이 "국가 안보"를 이유로 예외를 두고 있기 때문이다.

기자

관련 기사

ChatGPT 등장 이후 AI 기반 사이버범죄가 폭발적으로 증가하고 있다. 피싱부터 딥페이크까지, 더 빠르고 저렴해진 사기의 시대—우리는 얼마나 준비되어 있는가?

Anthropic의 최강 보안 AI '미토스'가 디스코드 사용자들에게 뚫렸다. 동시에 북한 해커는 AI로 악성코드를 짜고, 모질라는 AI로 271개 취약점을 잡았다. 사이버보안의 새 질서가 형성되고 있다.

캐나다 AI 기업 Cohere가 독일 Aleph Alpha와 합병, 200억 달러 가치의 '대서양 횡단 AI 연합'을 구성했다. 빅테크 독점에 맞선 이 도전이 한국 기업에도 시사하는 바는 무엇인가.

러시아가 미국 정찰위성을 표적으로 한 실전 배치형 위성요격 무기를 운용 중이라고 미 우주사령부 사령관이 공식 확인했다. 우주 공간이 새로운 전장이 되고 있다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요