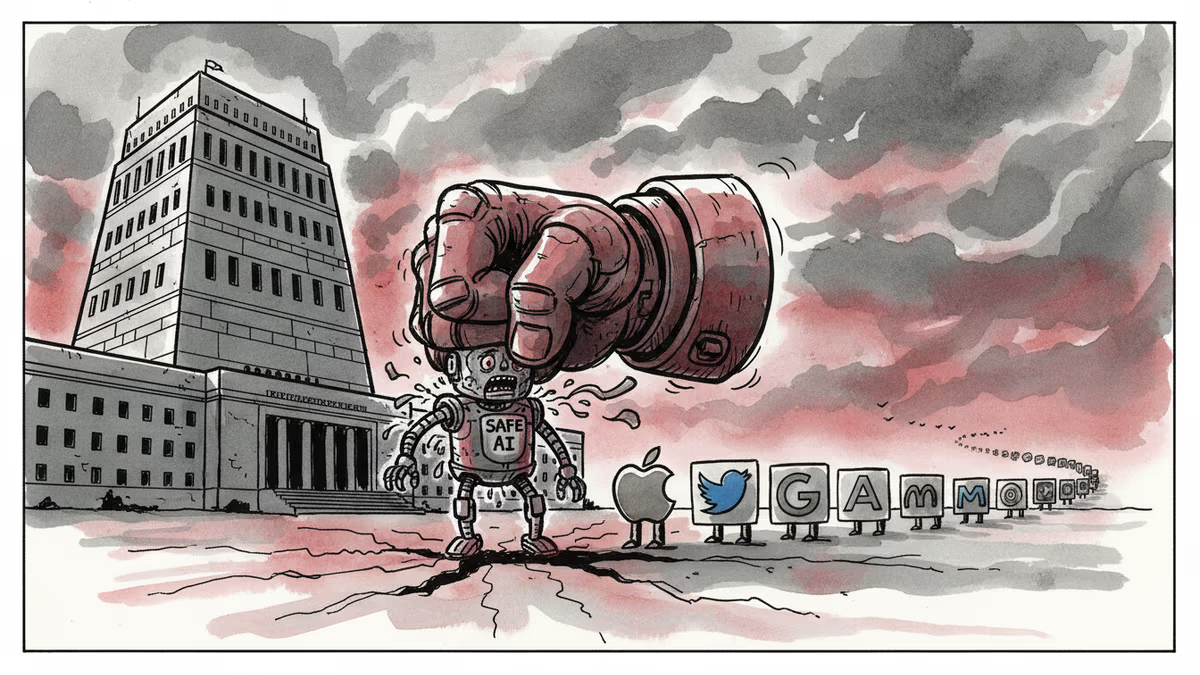

AI兵器化の分水嶺:Pentagon契約がもたらす技術倫理の危機

Anthropic社のPentagon契約見直しが示すAI軍事利用の深刻な課題。安全なAI開発と軍事要求の矛盾が浮き彫りに。

AnthropicのCEO、ダリオ・アモデイ氏が描いていた未来は、きっとこんなものではなかったはずだ。AI安全性のリーダーとして知られる同社が、2億ドル規模のPentagon契約の見直しに直面している。理由は単純だ:同社が特定の致命的作戦への参加を拒否したからである。

軍事AI契約の新たな現実

Anthropicは昨年、機密利用を含む軍事用途で米政府の承認を受けた初の大手AI企業となった。しかし今週、Pentagon報道官のショーン・パーネル氏は明確な警告を発した:「我が国は、戦闘員がいかなる戦いにも勝利できるよう支援する意志のあるパートナーを必要としている」。

これは他のAI企業への明確なメッセージでもある。現在国防省と非機密契約を結ぶOpenAI、xAI、Googleは、高度機密認証取得に向けて必要な手続きを急いでいる。

国防省CTO(元Uber最高事業責任者)のエミル・マイケル氏は今週、記者団に対し率直に語った:「軍事基地からドローン群が襲来した場合、それを撃墜する選択肢は何か?人間の反応時間では間に合わない場合、どうするつもりか?」

安全性と軍事効率性の根本的矛盾

Anthropicは「AI安全性企業」として独自の地位を築いてきた。同社のミッションは、悪意ある行為者がAIの最も危険な潜在能力を悪用できないよう、ガードレールを深く統合することだった。アイザック・アシモフのロボット工学三原則の現代版:「ロボットは人間に危害を加えてはならない」。

しかし、現実は複雑だ。同社は「米国の国家安全保障顧客専用に構築されたClaude Govモデル」を提供しながらも、兵器製造や設計にClaudeを使用することは禁止している。アモデイ氏は自律兵器や政府監視へのClaude関与を明確に拒否してきた。

日本の技術企業にとって、この状況は特に複雑な意味を持つ。ソニーやトヨタのような企業は、米国市場での競争力を維持しつつ、平和憲法の理念と調和する技術開発を模索している。AI軍事化の加速は、こうした企業の戦略的選択を一層困難にする。

軍産複合体とシリコンバレーの融合

数年前まで、多くのテック企業はPentagonとの協力に躊躇していた。しかし2026年現在、彼らは積極的に軍事契約を求めている。PalantirのCEOアレックス・カープ氏は誇らしげに語る:「我々の製品は時として人を殺すために使用される」。

この変化の背景には、中国との技術競争激化がある。しかし、洗練された対手との戦闘では、相手国も積極的に国家安全保障AIを実装せざるを得なくなり、結果として全面的な軍拡競争が始まる。

日本は独自の課題に直面している。高齢化社会と労働力不足の中で、AI技術への依存度は急速に高まっている。しかし、AI軍事化の波は、日本の技術政策にも影響を与えずにはいられない。

技術の未来を決定するのは誰か

スティーブン・レビー氏は長年、「デジタル技術の台頭こそが我々の時代の主要な物語」だと主張してきた。政治家や政権は変わっても、技術による人類の再構築は不可逆的だと。

しかし、その理論は今、揺らいでいる。未来は、誰が先進AIを支配し、それをどう形作り活用するかにかかっているかもしれない。AI企業が愛国主義に身を包み、Pentagonとの契約を求める一方で、彼らは監視を拒否する政府と軍部に、恐ろしいほど強力で予測不可能な技術を提供している。

関連記事

アンデュリルとMetaが共同開発する軍用ARグラスは、視線追跡と音声でドローン攻撃を指示できる。1590億円規模のプロジェクトが描く「人間を武器システムとして最適化する」未来とは。

プレプリントサーバーarXivが、LLM生成コンテンツを無検証で掲載した研究者に1年間の投稿禁止処分を導入。科学的誠実性とAI活用の境界線はどこにあるのか。

Google DeepMindの従業員がイスラエル・米軍へのAI技術提供に抗議し、英国で労働組合結成を決議。CWU加盟員の98%が賛成票を投じた今回の動きが示す、AI産業の新たな倫理的断層とは。

Oxford大学の研究で、「温かい」AIモデルが不正確な信念を肯定しやすいことが判明。AIの親切さと誠実さの間に潜むトレードオフを多角的に考察します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加