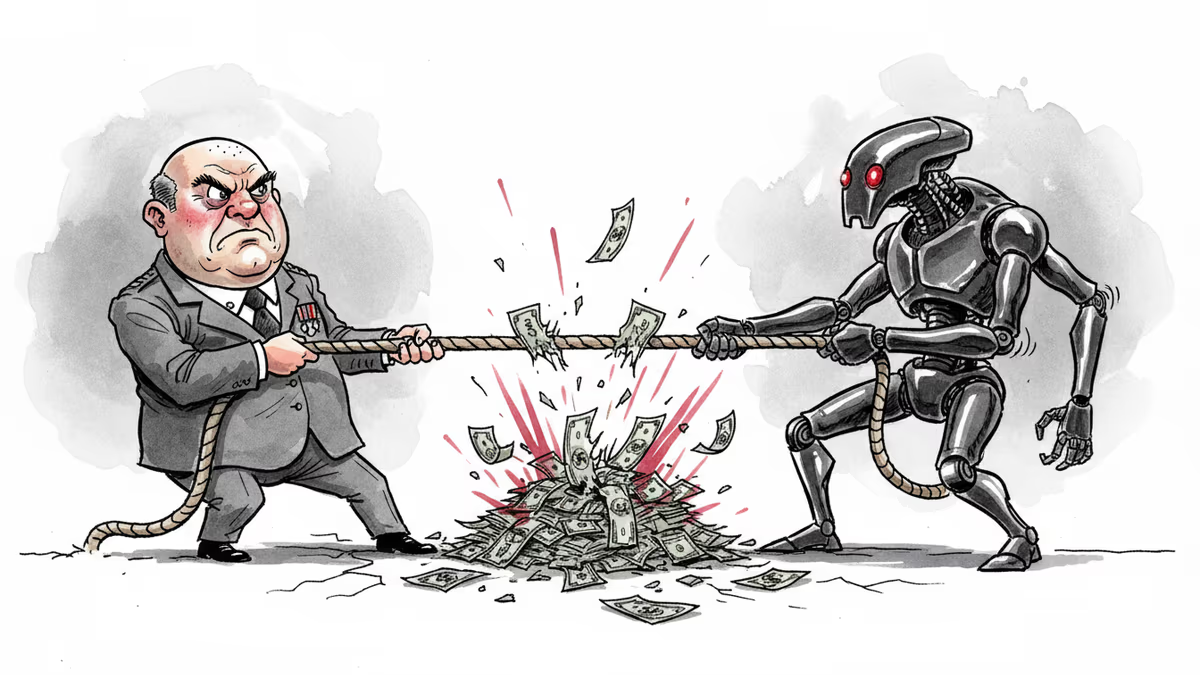

AIの軍事利用をめぐる攻防:Anthropic社がペンタゴンと対立

Anthropic社が米国防総省との2億ドル契約で軍事利用制限を主張。AI企業の倫理的責任と国家安全保障の間で新たな対立構造が浮上。

Anthropic社のAIモデル「Claude」が、ベネズエラのマドゥロ前大統領拘束作戦で使用されていた。この事実が明らかになったとき、同社は「知らなかった」と主張した。しかし、米国防総省は今、AI企業に対してより包括的な要求を突きつけている。「すべての合法的目的」でのAI技術使用を認めるよう求めているのだ。

$2億ドルの契約を盾に、ペンタゴンはAnthropic社に圧力をかけている。しかし、同社は「完全自律兵器」と「大規模国内監視」への使用を拒否する姿勢を崩していない。この対立は、AI時代における企業の倫理的責任と国家安全保障の境界線を巡る重要な先例となりつつある。

企業倫理vs国家要求の新たな戦場

OpenAI、Google、xAIも同様の要求を受けているが、対応は分かれている。匿名のトランプ政権関係者によると、これら企業のうち1社は既に合意し、2社は「柔軟性」を示している一方、Anthropicだけが最も強く抵抗しているという。

興味深いのは、各社の対応の違いが、それぞれの企業文化と創設理念を反映していることだ。Anthropicは「AI安全性」を最優先に掲げて設立された企業で、創設者らはOpenAIから独立してより慎重なAI開発を目指してきた。

一方で、政府側の論理も理解できる。AI技術が国家競争力の核心となる中、同盟国である民間企業の技術を「合法的」軍事目的に使用できないのは、戦略的に不利だというものだ。

日本への示唆:技術主権と同盟関係

日本企業にとって、この対立は他人事ではない。ソフトバンクはOpenAIに投資し、トヨタは自動運転でAI技術に依存している。もし日本政府が自衛隊でのAI利用拡大を進める場合、同様の問題に直面する可能性がある。

特に注目すべきは、技術の「デュアルユース」(民軍両用)性質だ。災害救助ロボットの技術は軍事ロボットにも応用できる。画像認識技術は医療診断にも監視システムにも使える。日本企業は、どこまでが「平和利用」で、どこからが「軍事利用」なのかという線引きを迫られることになるだろう。

グローバル競争の新次元

中国では、AI企業と軍事部門の連携に制約は少ない。バイドゥやアリババのAI技術が軍事目的に使用されることに、企業側が公然と反対することは考えにくい。

この違いが、長期的にはAI開発の速度と方向性に影響を与える可能性がある。倫理的制約が多い西側企業と、制約が少ない中国企業の間で、技術開発のスピードに差が生まれるかもしれない。

しかし同時に、倫理的配慮を重視する姿勢が、西側AI企業のブランド価値と国際的信頼性を高める要因にもなり得る。消費者や企業顧客の多くは、自分たちが使用するAI技術が「善良」であることを望んでいるからだ。

関連記事

IBMとスクーデリア・フェラーリHPのパートナーシップが、F1ファンアプリをAIで刷新。62%のエンゲージメント増加の裏に何があるのか。スポーツとAIの融合が示す企業戦略の新潮流を読み解く。

AnthropicのCode with Claudeイベントで、参加者の約半数がAIが書いたコードを確認せずにリリースしたと認めた。開発の未来と日本社会への影響を多角的に考察する。

MetaがiPhone向け新アプリ「Forum」を公開。Facebookグループ機能をAIチャットボットと組み合わせ、RedditやChatGPTへの対抗軸を形成。日本のコミュニティ文化への影響を読む。

米国で墜落死したパイロットの音声がAIで復元され、インターネット上に拡散。NTSBが公開記録システムを一時停止した事件が問いかける、技術と倫理の境界線。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加