AIは誰の「価値観」で戦場を判断するのか

ペンタゴンとシリコンバレーの蜜月と亀裂。AnthropicとDODの契約破棄が問いかける、自律型兵器時代における「AIの良心」とは何かを多角的に考察します。

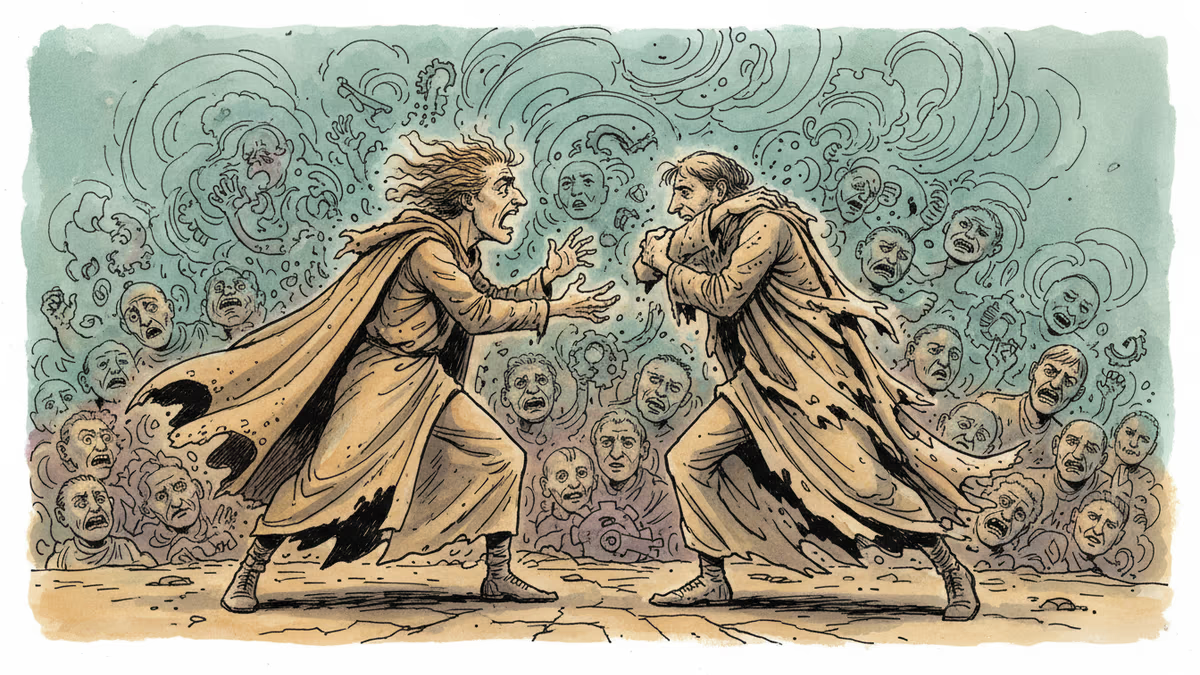

AIに「良心」を持たせた会社が、軍から契約を打ち切られた。

2026年3月、米国防総省(DOD)とAI企業Anthropicの間で起きた契約破棄は、単なるビジネス上のトラブルではありませんでした。その亀裂の中心にあったのは、「AIは大量監視や自律型兵器に使われるべきか」という、一行の文言をめぐる根本的な価値観の衝突でした。

ペンタゴンとシリコンバレー:蜜月の歴史

そもそも、軍とテクノロジー企業の協力関係は今に始まったことではありません。レーダー、GPS、インターネット——現代社会を支えるインフラの多くは、軍の研究開発から生まれました。2017年に始まったプロジェクト・マーヴンも、その流れの一つです。ドローン映像をコンピュータビジョンで解析し、「データを行動可能な情報へ、速やかに変換する」ことを目的としたこのプロジェクトは、当時Googleが契約を受注したことで大きな議論を呼びました。社内エンジニアたちが署名運動を起こし、最終的にGoogleは撤退。しかし、あれから約9年が経ちます。

Wiredのシニアライター、Will Knight氏が指摘するように、「AIを防衛に使わない」という選択肢は、今やソフトウェアを使わないと言うに等しい、非現実的なものになっています。ウクライナの戦場では市販のドローンが兵器化され、AIによる自律制御が実装されています。大規模な「スウォーム(群れ)」攻撃——20機以上のドローンが連携して一つの目標を攻撃する戦術——に対しては、もはや人間が一対一で対応することは物理的に不可能です。自律化の波は、純粋な防衛用途を超えて広がりつつあります。

「Claude Gov」という問い:ガードレールを外すとき、何が残るか

Anthropicが国防総省に提供したのは、「Claude Gov」と呼ばれる特別バージョンでした。通常のClaudeは、兵器や軍事行動に関連する質問に対して「お手伝いできません」と答えます。しかし軍事用途では、そのガードレールの一部を取り外す必要があります。

ここで浮かぶ問いは単純ではありません。Knight氏は言います。「ガードレールを外したモデルがどう振る舞うか、私は非常に興味があります。それでも何かを拒否することがあるのでしょうか?」

実際の運用について、Knight氏の理解では、AIは現時点では「攻撃せよ」と直接命令を下すのではなく、膨大な情報の中からパターンを見つけ、人間の判断を補助する役割を担っています。地図上の資産配置を確認したり、特定地域の信号情報に関する質問に答えたりする——いわば、軍事版の「調査補助ツール」です。ちょうど記者がデータの海からインサイトを引き出すようにAIを使うのと、構造的には似ています。

しかし、問題はその先にあります。人間がAIの出力を過信した場合、あるいはAIが「それらしく」誤った情報を提示した場合、その誤りはどこで止まるのでしょうか。Knight氏は警告します。「このモデルは、まるで人間のように振る舞い、正しい答えを繰り返します。そして突然、まったく予想外の誤りを犯す。その予測不可能な失敗こそが、最も懸念すべき点です。」

価値観をめぐる衝突:誰がAIの「良心」を決めるのか

今回の破棄の直接的な引き金は、DODが求めた契約変更でした。前年の契約に含まれていた「米国市民の大量監視への不使用」と「自律型兵器への不使用」という条項を削除するよう、国防総省が要求したのです。Anthropicはこれを拒否し、契約は破棄されました。

代わりにOpenAIが契約を引き受けましたが、「いくつかのガードレールは維持する」としています。しかし、そのガードレールの中身は公開されていません。

さらに事態を複雑にしたのは、国防長官Pete Hegseth氏の反応でした。同氏はAnthropicを「サプライチェーンリスク」に指定。Knight氏はこれを「驚くほど破壊的な行為」と評します。これまでこの指定は、中国政府のために活動していると非難されたHuaweiのような中国企業にのみ適用されてきたからです。米国を代表するAI企業の一つに同じ措置を取ることは、国際社会から見ても異例の強硬策と映ります。

ここに、より深い問いが浮かび上がります。AIには「価値観」が組み込まれています。AnthropicはClaudeに「憲法(Constitution)」を持たせ、Elon MuskはxAIに「反ウォーク」の価値観を標榜します。米国政府は「AIはアメリカの価値観を反映すべき」と繰り返し語ります。しかし——その「アメリカの価値観」とは、具体的に何を指すのでしょうか。それを決めるのは、大統領なのか、AI企業のCEOなのか、それとも市民全員なのか。

日本への問い:「他人事」ではない理由

この問題は、太平洋を隔てた日本にとっても無縁ではありません。

まず、地政学的文脈があります。Bloombergが伝えるように、米国防総省内では「イランは中国・台湾有事の前哨戦」という見方が広まっています。日本の安全保障は米国との同盟に基づいており、米軍がAIをどう使うかは、日本の防衛政策とも直結します。

次に、産業的文脈があります。ソニー、富士通、NECといった日本企業も、防衛・セキュリティ分野でのAI活用を模索しています。米国での「AI倫理と軍事利用の衝突」は、日本企業が同様の選択を迫られる日の予告編かもしれません。

さらに、社会的文脈として、日本は世界有数の高齢化社会であり、労働力不足の解消策としてAIへの期待が高まっています。しかし、「便利なAI」と「戦場のAI」は同じ技術基盤の上にあります。一方の発展がもう一方に影響を与えることは避けられません。

自律型兵器の規制をめぐる国際的な議論——国連での「致死的自律型兵器システム(LAWS)」に関する条約交渉——においても、日本はどのような立場を取るべきか、問われています。

記者

関連記事

週10億人が使うチャットボット。しかし権威主義国家の言語で質問すると、AIは親政府的な回答を返す傾向があることが、Nature誌掲載の研究で明らかになった。意図せざるプロパガンダの拡散とは何を意味するか。

トランプ大統領が中国・ロシアの独裁者たちに対して繰り返す「道徳的同等論」。その背景にあるのは外交戦略なのか、それとも強者への服従なのか。日本の安全保障にも直結する問いを読み解く。

トランプ大統領が北京で習近平と首脳外交を演出。しかしその中身は、米国が20年かけて築いた対中戦略の解体に等しいと専門家は警告する。日本企業と同盟関係への影響を読む。

AIエージェントの台頭、サイバー攻撃の脅威、雇用喪失への不安——2026年、AIは米中関係から家庭の電気代まで、あらゆる問題に絡みついている。日本社会にとっての意味を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加