AI論文の急増が学術界に潜む新たなリスク

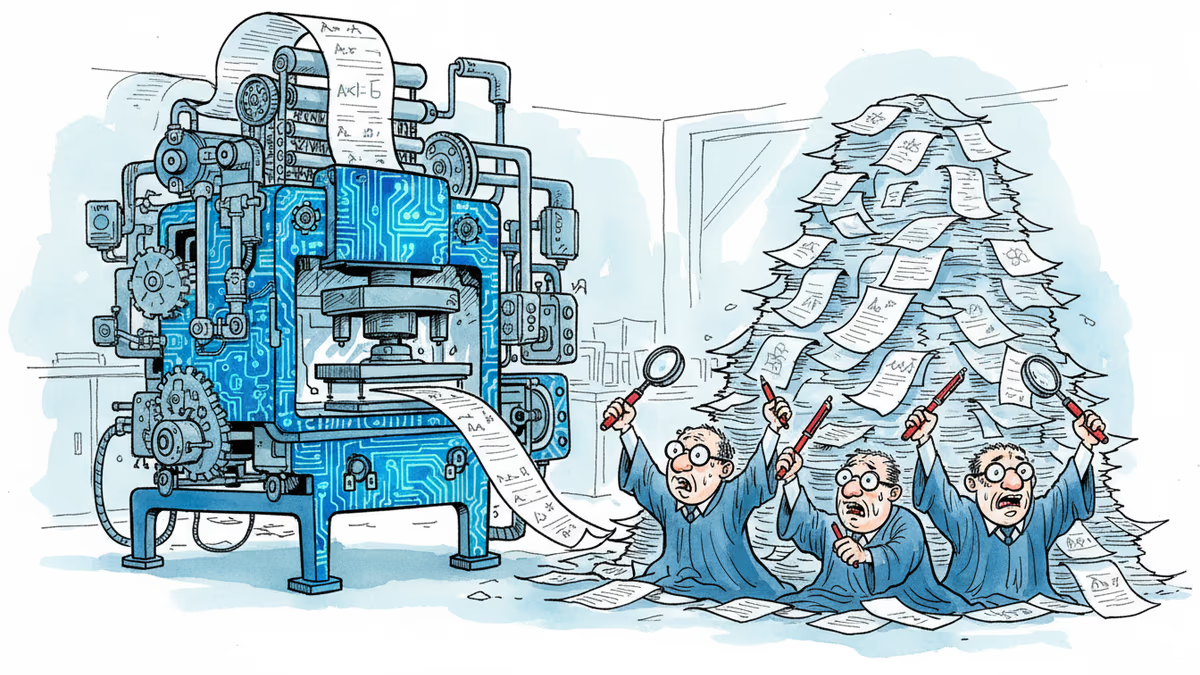

生成AIの普及で論文投稿数が急増する中、査読システムの限界と偽情報拡散のリスクが浮き彫りに。学術界が直面する品質管理の課題を探る。

ChatGPTが登場してから2年。ある医学研究者は論文の執筆時間を半分に短縮できたと喜んでいた。しかし、その代償として学術界全体が予想外の問題に直面している。2024年には世界の生医学論文の13%以上でAI生成の痕跡が発見され、論文投稿数の急増が査読システムを圧迫しているのだ。

数字が物語る変化の規模

最新の研究によると、2024年に投稿された生医学論文の抄録のうち、13%を超える論文でAIによる執筆支援の痕跡が確認された。これは前年比で大幅な増加を示している。

問題は単純な数字以上に深刻だ。AI支援により論文執筆のハードルが下がった結果、研究の質を十分に検証しないまま投稿される論文が増加している。査読者たちは従来の2倍以上の論文を処理しなければならない状況に陥っており、一本一本の論文に割ける時間が大幅に減少している。

NatureやScienceといった権威ある学術誌でも、査読期間の延長や追加査読者の確保に苦慮している。ある査読者は「以前なら一週間で判断できた論文が、今は同じ時間で3本処理しなければならない」と匿名で証言している。

偽情報拡散の新たな経路

AI生成論文の急増が生み出すもう一つの深刻な問題は、偽情報の学術的「正当化」である。AIは既存の文献を巧妙に組み合わせて、一見もっともらしい論文を生成できるが、その内容の科学的妥当性は保証されない。

特に医療分野では、査読を通過した偽情報が治療方針に影響を与えるリスクが指摘されている。米国医師会の調査では、AI生成の疑いがある論文の約30%で統計的手法に問題があることが判明している。

研究者たちは「論文工場」と呼ばれる組織的な偽論文生産の存在も警告している。これらの組織はAIを活用して大量の論文を生産し、査読システムの隙を突いて学術誌に掲載させようとしている。

日本の学術界への影響

日本の研究機関も例外ではない。東京大学や京都大学などの主要大学では、AI利用ガイドラインの策定を急いでいる。理化学研究所は研究者向けのAI倫理研修を2024年から必修化した。

日本の特徴的な課題として、研究者の高齢化と人手不足がある。若手研究者が減少する中、AIによる効率化への期待は高いが、同時に品質管理の重要性も増している。文部科学省は2026年から研究助成の審査にAI検出ツールの導入を検討している。

日本学術会議の委員は「AIは研究の民主化をもたらす可能性がある一方で、学術の権威性を損なうリスクもある」と複雑な心境を吐露している。

解決策を模索する動き

学術界では対策も始まっている。IEEEやACMなどの学会は、AI利用の透明性を高めるガイドラインを策定。論文投稿時にAI使用の有無と範囲の明記を義務付ける動きが広がっている。

また、AI検出技術の開発も進んでいる。MIT発のスタートアップ企業は95%の精度でAI生成テキストを識別できるツールを開発し、複数の学術誌が導入を検討している。

しかし、技術的対策だけでは限界がある。根本的な解決には、研究者のモラルと学術界全体の意識改革が不可欠だという声が強まっている。

関連記事

GoogleのGTIGがAIを使ったゼロデイ脆弱性の大規模悪用計画を阻止。OpenClawやAnthropicのMythosモデルなど、AIがサイバー攻撃の新たな武器となりつつある現状を多角的に解説。

Anthropicの最新AIモデル「Mythos」が発見したサイバー脆弱性は、既存モデルでも再現可能だと専門家が警告。攻撃側が優位な現状と、日本企業が直面するリスクを読み解く。

OpenAIのサム・アルトマンCEOの自宅に火炎瓶が投げ込まれた事件。AIへの熱狂と反発が交錯する時代に、この事件が私たちに問いかけるものとは何か。日本社会への影響も含めて考察します。

プライバシーを武器に成長したAppleが、GoogleのGemini AIを採用。創業50年の節目に直面する最大の試練と、日本市場への影響を多角的に分析します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加