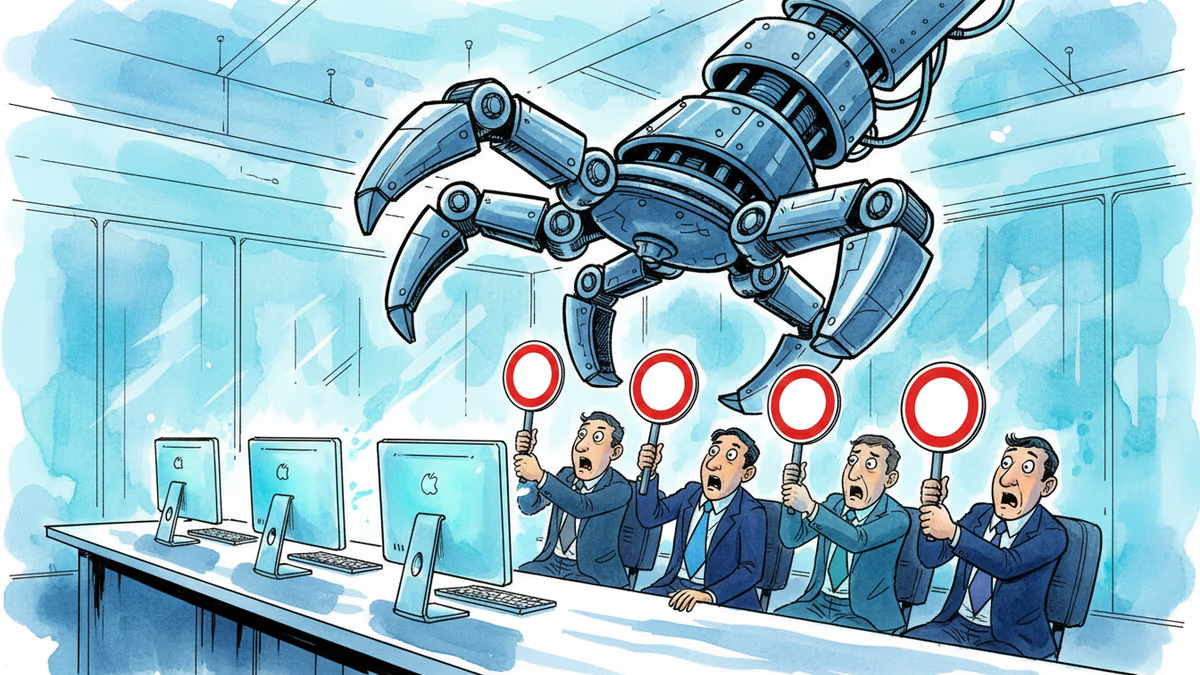

オープンソースAIエージェント「OpenClaw」、企業が警戒する理由

無料のAIエージェントツール「OpenClaw」に対し、テック企業が従業員に使用禁止を通達。OpenAI買収後も続く企業の懸念とは?

深夜のSlackメッセージが、テック業界に新たな議論を呼び起こしている。「OpenClawは現在未検証で、我々の環境にとって高リスクです」。スタートアップCEOのJason Grad氏が従業員20人に送ったこの警告は、赤いサイレン絵文字付きだった。

企業が恐れるオープンソースAI

OpenClaw(旧名:Clawdbot、MoltBot)は、昨年11月に個人開発者Peter Steinberger氏がリリースした無料のオープンソースAIエージェントツールだ。しかし先月、他の開発者が機能を追加し、SNSで体験談を共有し始めると、その人気は急上昇した。

Metaの幹部も匿名で語る。「チームには通常の業務用ノートパソコンでのOpenClaw使用を禁止し、違反すれば解雇もあり得ると伝えた」。理由は明確だ。このソフトウェアは予測不可能で、セキュアな環境でプライバシー侵害を引き起こす可能性があるというのだ。

OpenAI買収でも変わらぬ企業の警戒

興味深いことに、先週Steinberger氏はChatGPT開発元のOpenAIに入社した。OpenAIはOpenClawをオープンソースのまま維持し、財団を通じてサポートすると発表している。しかし、この買収劇は企業の懸念を和らげていない。

日本企業にとって、この状況は特に複雑だ。ソニーやトヨタのような大企業は、AIツールの導入に慎重なアプローチを取る傾向がある。品質管理と長期的な安定性を重視する日本の企業文化において、「未検証」のツールは大きなリスク要因となる。

オープンソースの光と影

オープンソースAIの台頭は、技術の民主化を意味する。個人開発者でもOpenAIのような巨大企業と競争できる可能性を秘めている。しかし同時に、企業のセキュリティ部門にとっては新たな頭痛の種でもある。

従来のソフトウェアとは異なり、AIエージェントは学習し、進化し、時には予期しない行動を取る。これは革新的である一方、企業のコンプライアンス担当者にとっては管理困難な要素となる。

関連記事

産休・育休中にAIコーディングツールが普及し、復職後に「スキルギャップ」に直面する女性エンジニアたちの実態。技術変化が働く母親に与える不均衡な影響を多角的に分析する。

YouTubeが新AI機能「カスタムフィード」を発表。見たい動画をテキストで入力するだけで、パーソナライズされた専用フィードが生成される。この変化はコンテンツ消費の何を変えるのか。

Google社員が社内の機密データを使いPolymarketで約1.2億円の不正利益を得たとして連邦検察に起訴。インサイダー情報と予測市場の新たなリスクを問う。

ファーウェイ傘下HiSiliconが「タウのスケーリング則」という新設計思想を発表。米国の輸出規制を迂回する可能性を秘めた半導体戦略の全貌と、日本企業への影響を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加