OpenAI、サイバーセキュリティ企業を買収――AIエージェント時代の「安全」とは何か

OpenAIがサイバーセキュリティスタートアップのPromptfooを買収。AIエージェントが現実のデータやシステムと接続する時代に、セキュリティと安全性の確保がなぜ急務なのかを多角的に分析します。

AIが「考える」だけでなく、「行動する」時代が来たとき、誰がその行動を監視するのか。

OpenAIは2026年3月9日、AIシステムのテストとセキュリティ検証を専門とするスタートアップPromptfooの買収を発表しました。買収金額は非公開ですが、Promptfooの11名のチームは全員OpenAIに合流し、同社の技術はAIエージェント向けプラットフォーム「Frontier」に統合される予定です。

一見、小さなスタートアップの買収に見えるかもしれません。しかし、この動きが示す意味は、AIの競争構造そのものの変化を映し出しています。

Promptfooとは何者か――開発者が頼りにしたツール

Promptfooは、AIシステムの「脆弱性テスト」を可能にするツールを提供するスタートアップです。具体的には、開発者がAIへの入力(プロンプト)やエージェントの動作をテストし、GPT、Claude、Geminiといった異なる大規模言語モデルのパフォーマンスを比較できるオープンソースプロジェクトを運営してきました。

このオープンソースプロジェクトは、AI開発コミュニティで広く使われており、OpenAIは買収後もこのプロジェクトを継続して開発すると明言しています。2025年7月に発表されたシリーズAラウンドでは1,840万ドルを調達。Insight Partnersが主導し、Andreessen Horowitzも参加。累計調達額は2,268万ドル、企業評価額は8,550万ドルでした。

PromptfooのCEO、Ian Webster氏はこう述べています。「AIエージェントが現実のデータやシステムとより深く接続されるにつれ、それらを安全に検証することは、かつてないほど難しく、かつ重要になっています。」

なぜ今なのか――AIエージェント時代の「見えないリスク」

OpenAIがこの買収を急ぐ理由は、AIの進化の方向性と深く関係しています。これまでのAIは主に「質問に答える」存在でした。しかし現在、AIエージェントは自律的にウェブを検索し、コードを実行し、外部サービスと連携して「タスクを完了する」存在へと変わりつつあります。

この変化は利便性をもたらす一方で、新たなリスクを生み出します。悪意ある入力によってAIエージェントが意図しない行動を取る「プロンプトインジェクション攻撃」、エージェントが外部システムに不正アクセスする可能性、そして企業の機密データが意図せず漏洩するリスクなどです。

OpenAIはこうしたリスクに対応するため、Promptfooの技術をFrontierプラットフォームに組み込み、AIエージェントのセキュリティと安全性の検証を内製化しようとしています。

近年の買収の流れを見ると、この戦略はより明確になります。2025年10月にはMac向けAIインターフェース「Sky」を開発したSoftware Applicationsを買収。2026年1月にはヘルスケアテック企業Torchを約6,000万ドルで買収。さらに2月には、AIエージェント開発ツール「OpenClaw」の作者Peter Steinberger氏を採用しました。Sam Altman氏はX(旧Twitter)でこう述べています。「彼は天才であり、非常に賢いエージェントが互いに連携して人々に役立つことについて、多くの素晴らしいアイデアを持っている。」

日本企業への影響――セキュリティは「後回し」にできない

日本の視点から見ると、この動きはいくつかの重要な示唆を持ちます。

ソニー、トヨタ、NTTなど、AIエージェントの業務導入を進める日本企業にとって、AIシステムのセキュリティ検証は今後避けられない課題になります。これまでAIの「性能」ばかりが注目されてきましたが、「安全に使えるか」という検証コストが新たに発生することを意味します。

一方で、日本のサイバーセキュリティ市場にとってはビジネス機会でもあります。IPA(情報処理推進機構)が毎年発表する「情報セキュリティ10大脅威」でも、AIを悪用した攻撃は年々上位に入ってきており、AIセキュリティ専門人材の需要は今後急増すると見られています。

ただし、懸念もあります。PromptfooのようなオープンソースツールがOpenAIに取り込まれることで、これまで中立的な立場で複数のAIモデルを比較評価できたツールが、OpenAI寄りの評価基準に変わる可能性は否定できません。開発者コミュニティからは、オープンソースとしての独立性が維持されるかどうかを注視する声も上がっています。

投資家の視点――セキュリティは「コスト」か「価値」か

Andreessen HorowitzはPromptfooへの投資に続き、2026年1月には「American Dynamism」関連の資金調達として150億ドルを調達。インフラとディフェンス市場への傾注を明確にしています。このうち67億5,000万ドルはグロースファンド、各17億ドルがアプリとインフラに充てられます。

AIセキュリティへの投資が加速している背景には、企業がAIを本格導入するにあたって、セキュリティ検証が「あれば良い」から「なければ使えない」へと変わりつつあるという現実があります。特に金融、医療、インフラなど規制の厳しい分野では、AIシステムの安全性証明が法的要件になりつつあります。

関連記事

元CIA長官ペトレイアス氏が警告——自律型ドローン群は既存の防衛システムを無力化する。ウクライナとイランの戦場が示す無人兵器の未来と、日本企業・投資家が注目すべき構造的変化を読み解く。

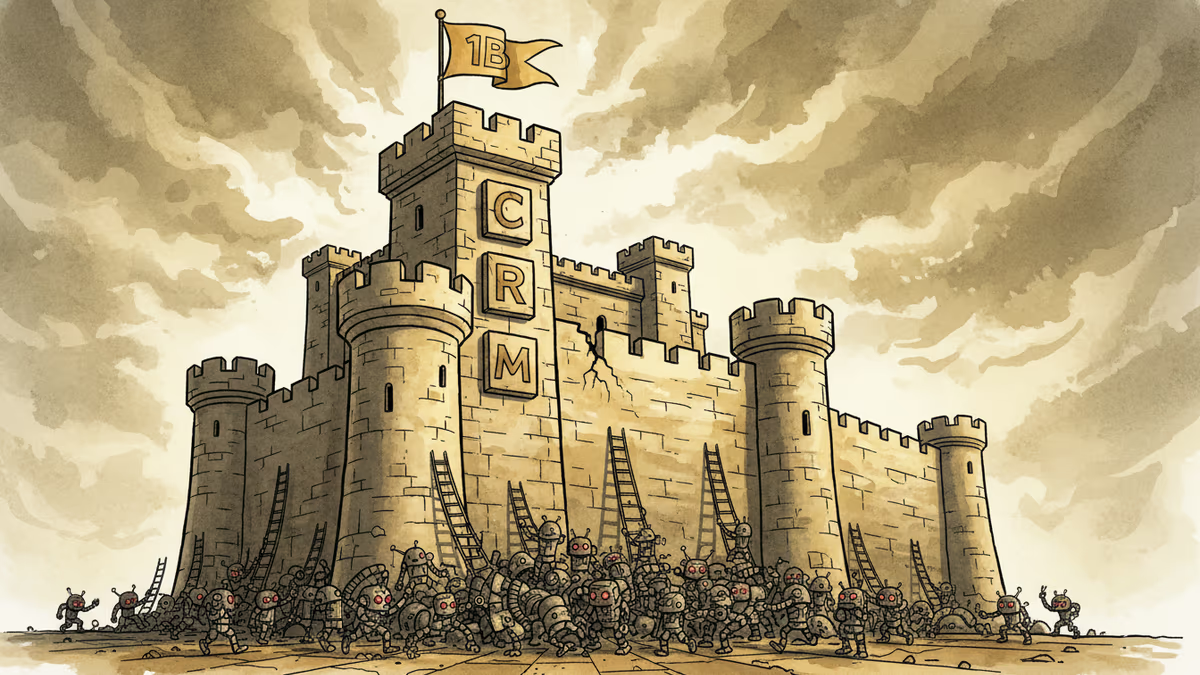

SalesforceのAgentforce年間収益が初めて12億ドルを突破。好決算の裏で株価は年初来33%下落。AIエージェント時代に企業ソフトウェアの価値はどこへ向かうのか、日本企業への示唆を読み解く。

OpenAIが初の海外AIラボをシンガポールに開設、Googleも国家AIパートナーシップを締結。なぜ今、なぜシンガポールなのか。日本企業への示唆も含めて読み解く。

マスク対オルトマン裁判が終結。SpaceXとOpenAIのIPOレースが本格化する中、AI覇権をめぐる真の競争が幕を開ける。日本市場への影響と投資家が知るべき論点を解説。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加